02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

Страница 1 из 5

Страница 1 из 5 • 1, 2, 3, 4, 5

02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

НЕДОСТАТОК ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

Придется начать конец второго тома заметок раньше середины. Уж слишком религиозным стало движение за внедрение того, что в 20-х годах XXI века начали вдруг называть "Искусственным Интеллектом". И, как всякая религия, оно базируется на вере, в ущерб пониманию.

Для запутывания вопроса были совмещены вместе две "технологии": "нейросетей" и "бредогенерации", что совершенно не обязательно. Зато, позволяет менять тему разговора и надувать щеки.

Попробуем разобраться.

Вопрос "нейросетей" - это вопрос теории вычислений, только там они называются конечными автоматами. Помните, как Бир встраивал их в цепочки управления - ТЕМА #112, АБЗАЦ #1634

ТЕМА #112, АБЗАЦ #1634 ? Как мы их обучали для имитации поведения игрока -

? Как мы их обучали для имитации поведения игрока -  ТЕМА #63, АБЗАЦ #696

ТЕМА #63, АБЗАЦ #696 ? Как они разбирали регулярные выражения -

? Как они разбирали регулярные выражения -  ТЕМА #74

ТЕМА #74 ?

?

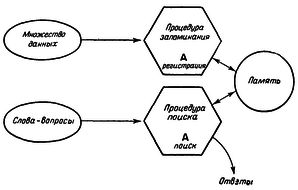

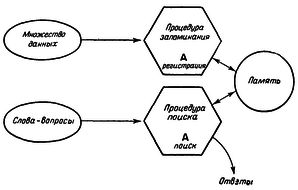

Вопрос же бредогенерации - т.е. игры в тест Тьюринга - скорее, психологический - ТЕМА #63, АБЗАЦ #695

ТЕМА #63, АБЗАЦ #695 . Помните, как Растригин и Чачко (

. Помните, как Растригин и Чачко ( ТЕМА #144, АБЗАЦ #3233

ТЕМА #144, АБЗАЦ #3233 ) подбирали инструмент для диалога человек-машина? Не говоря уже о многочисленных игрушках, встреченных на страницах "В мире науки", или, даже, в виде простеньких примеров (

) подбирали инструмент для диалога человек-машина? Не говоря уже о многочисленных игрушках, встреченных на страницах "В мире науки", или, даже, в виде простеньких примеров ( ТЕМА #122, АБЗАЦ #2121

ТЕМА #122, АБЗАЦ #2121 ).

).

Начнем с теории "сетей". Обратите внимание на годы выхода этих работ.

Из книги "О чем размышляют роботы?" Жан-Пьера Пети

Придется начать конец второго тома заметок раньше середины. Уж слишком религиозным стало движение за внедрение того, что в 20-х годах XXI века начали вдруг называть "Искусственным Интеллектом". И, как всякая религия, оно базируется на вере, в ущерб пониманию.

Для запутывания вопроса были совмещены вместе две "технологии": "нейросетей" и "бредогенерации", что совершенно не обязательно. Зато, позволяет менять тему разговора и надувать щеки.

Попробуем разобраться.

Вопрос "нейросетей" - это вопрос теории вычислений, только там они называются конечными автоматами. Помните, как Бир встраивал их в цепочки управления -

ТЕМА #112, АБЗАЦ #1634

ТЕМА #112, АБЗАЦ #1634 ? Как мы их обучали для имитации поведения игрока -

? Как мы их обучали для имитации поведения игрока -  ТЕМА #63, АБЗАЦ #696

ТЕМА #63, АБЗАЦ #696 ? Как они разбирали регулярные выражения -

? Как они разбирали регулярные выражения -  ТЕМА #74

ТЕМА #74 ?

? Вопрос же бредогенерации - т.е. игры в тест Тьюринга - скорее, психологический -

ТЕМА #63, АБЗАЦ #695

ТЕМА #63, АБЗАЦ #695 . Помните, как Растригин и Чачко (

. Помните, как Растригин и Чачко ( ТЕМА #144, АБЗАЦ #3233

ТЕМА #144, АБЗАЦ #3233 ) подбирали инструмент для диалога человек-машина? Не говоря уже о многочисленных игрушках, встреченных на страницах "В мире науки", или, даже, в виде простеньких примеров (

) подбирали инструмент для диалога человек-машина? Не говоря уже о многочисленных игрушках, встреченных на страницах "В мире науки", или, даже, в виде простеньких примеров ( ТЕМА #122, АБЗАЦ #2121

ТЕМА #122, АБЗАЦ #2121 ).

).Начнем с теории "сетей". Обратите внимание на годы выхода этих работ.

Из книги "О чем размышляют роботы?" Жан-Пьера Пети

Последний раз редактировалось: Gudleifr (Ср Апр 03, 2024 12:45 am), всего редактировалось 1 раз(а)

Gudleifr- Admin

- Сообщения : 3402

Дата регистрации : 2017-03-29

Re: 02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

Re: 02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

Из сб. АВТОМАТЫ, 1956  ТЕМА #135, АБЗАЦ #2819

ТЕМА #135, АБЗАЦ #2819

Сразу два замечания. Первое:

Как видно, эта статья вышла еще до того, как научились делать "настоящие ЭВМ". Позднее Н.Винер писал в своей "Кибернетике":

Т.е. это ЭВМ стали средством реализации сетевой модели, а не "сети отменили ЭВМ".

Второе замечание:

Конечно, тут не без некоторого жульничества. На протяжении всей этой темы под сетью подразумевается не честный кусок добытого из живого организма мыслящего вещества, а всего лишь некоторая математическая/электронная модель, "достаточная для имитации мыслепроцесса". Т.е. мы не гарантируем, что мозг работает именно так, но не можем найти разницы в работе мозга и машины.

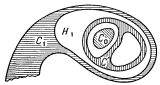

Начало рассматриваемой статьи, как раз, посвящено выделению в нейронах разумного начала.

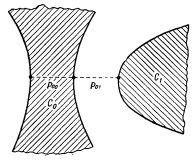

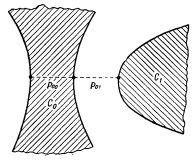

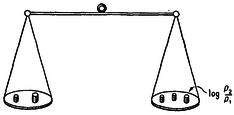

Т.о. авторы видят возможность упростить модель нейронной сети, отказавшись от рассмотрения сложных электрических переходных процессов. Впрочем, я знаю модель, в которой возбуждение "нейронов" было более "частотно-чувствительным" - ТЕМА #98, АБЗАЦ #1295

ТЕМА #98, АБЗАЦ #1295 .

.

Что дает нам способ расчета нервной активности по правилам обычной математической логики.

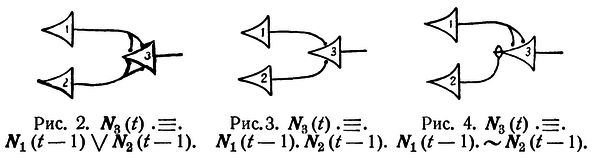

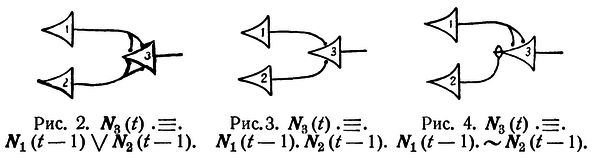

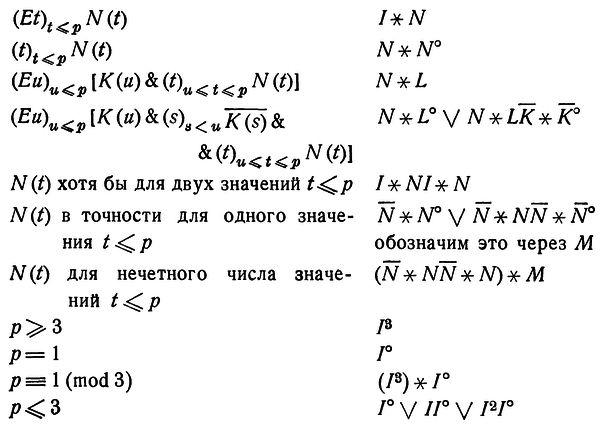

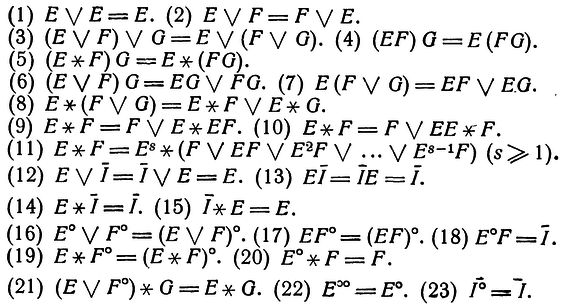

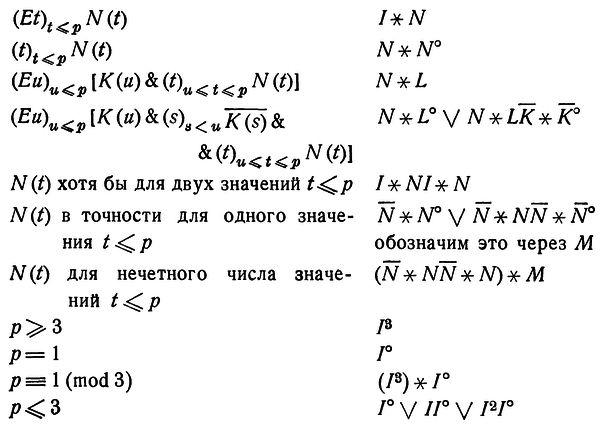

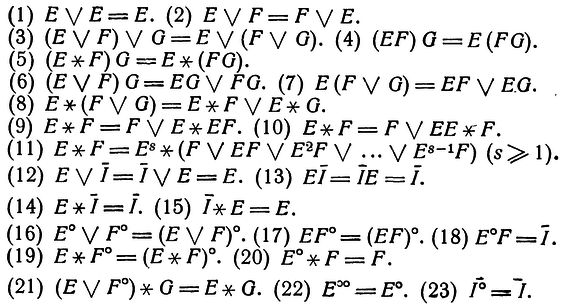

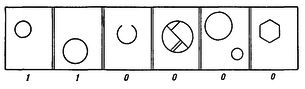

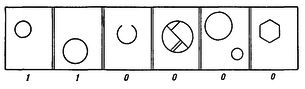

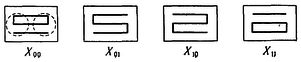

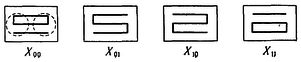

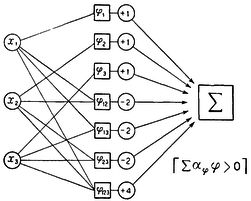

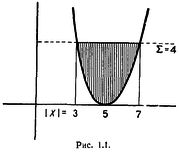

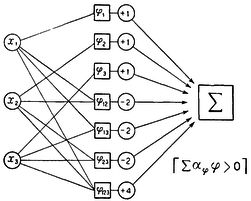

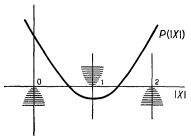

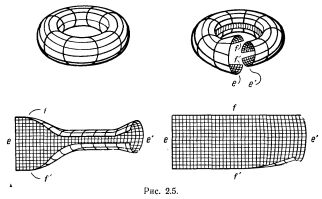

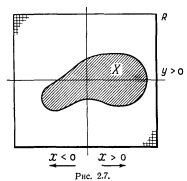

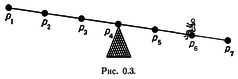

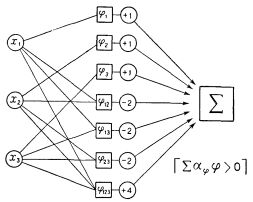

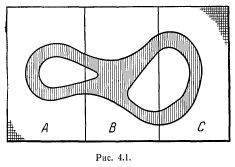

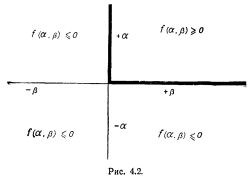

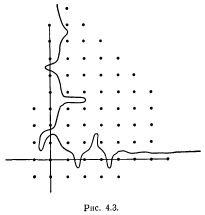

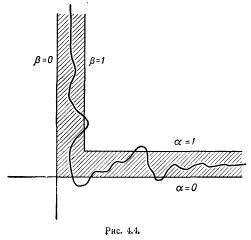

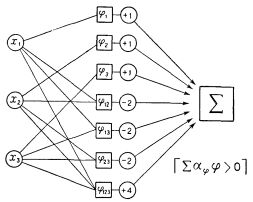

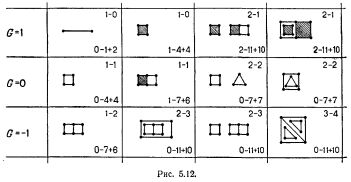

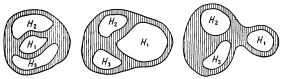

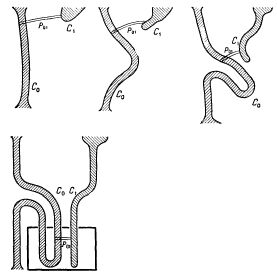

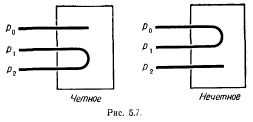

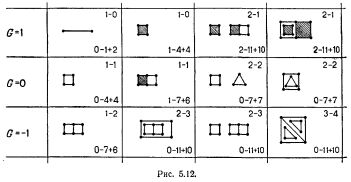

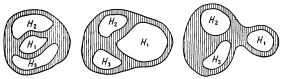

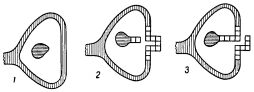

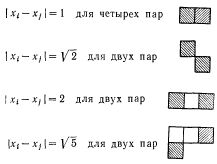

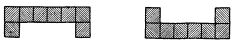

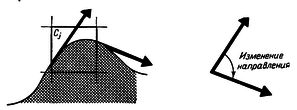

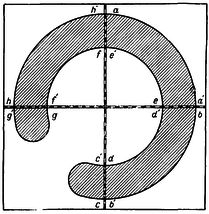

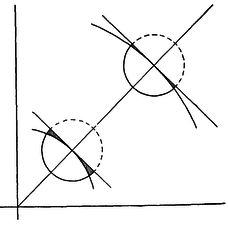

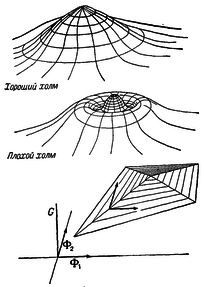

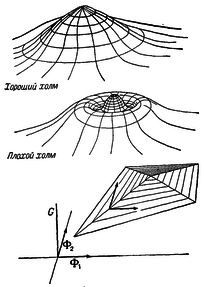

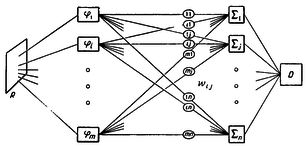

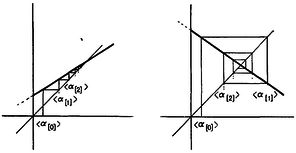

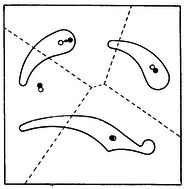

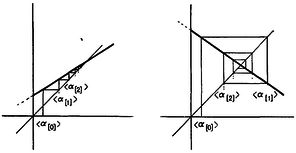

Большую часть формализмов я опускаю. Публикация 1956 года явно требует перевода на язык современной школьной мат.логики. Суть описываемых изысканий достаточно проста и интуитивно понятна из приведенных иллюстраций.

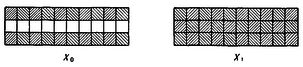

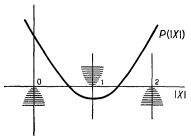

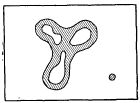

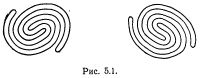

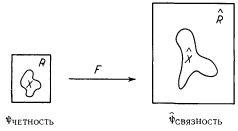

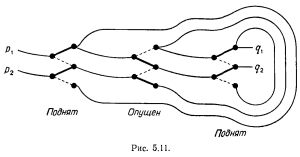

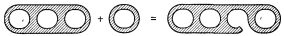

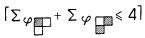

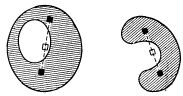

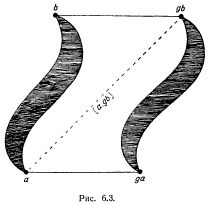

Первые две теоремы посвящены эквивалентности логических выражений и сетей. Для всякой сети найдется предикат и почти для каждого выражения - сеть без петель.

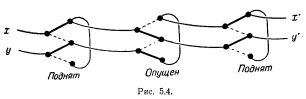

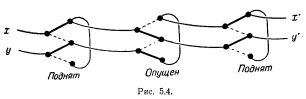

Выражения отличаются от обычных в двух отношениях. Во-первых, как отдельная операция (и как свойство других единичных операций) вводится задержка (синаптическая), позволяющая рассматривать вычисление в сети "пошагово" - от нейрона к нейрону. Понятие эквивалентности (реализуемости) т.о. становится вневременным - нам становится неважным, сколько шагов заняли два вычисления, важно, чтобы их результаты совпали.

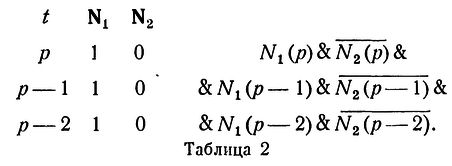

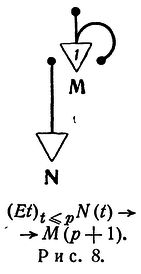

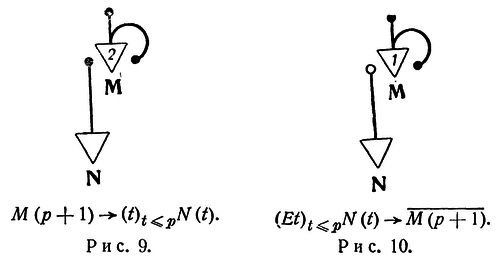

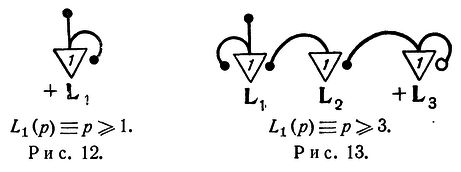

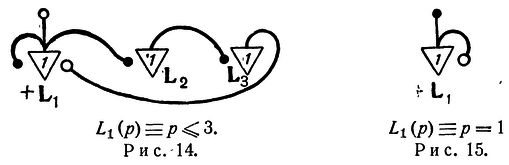

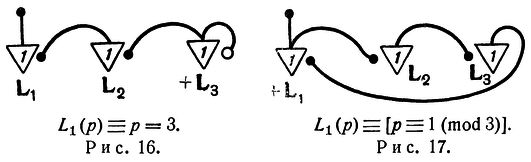

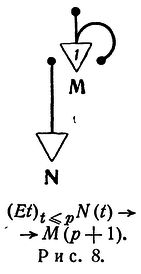

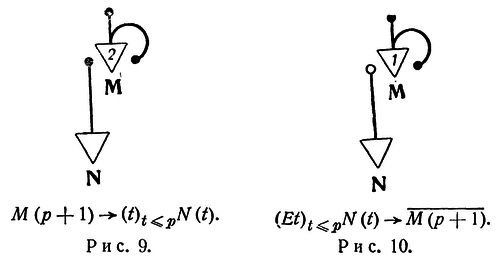

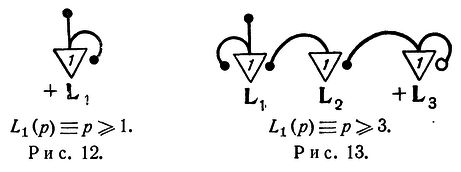

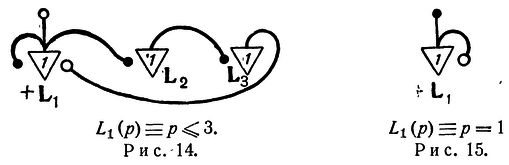

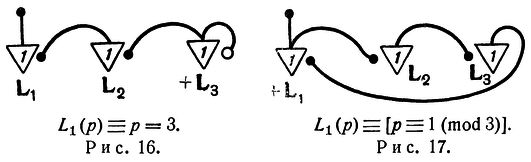

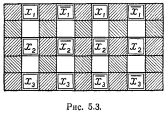

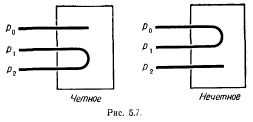

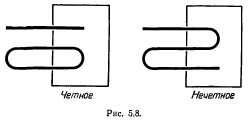

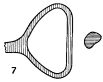

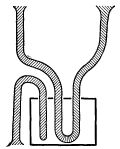

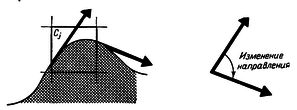

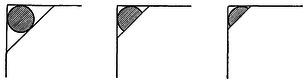

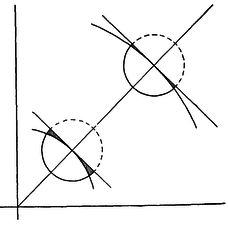

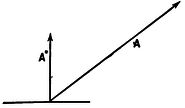

Просто задержка. В статье порог нейрона обычно считается равным 2.

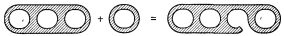

Простые логические операции с единичной задержкой.

Вторая тонкость - исключение из рассмотрения выражений являющихся истинными при отсутствии в их обозримом прошлом истинных входных значений (рецепторов, peripheral afferents). (Т.е. самовозбуждающихся сетей и сетей с бесконечной памятью).

Этому ограничению посвящена третья теорема.

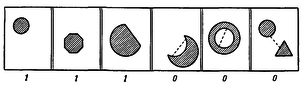

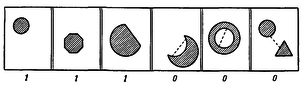

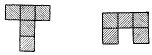

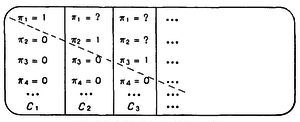

Следующие четыре теоремы посвящены доказательству того, что дальнейшее "биологическое" усложнение сетей не дает новых вычислительных возможностей:

Т.е. относительное торможение - временное повышение порога чувствительности нейрона до его полной невозбудимости - вводить не нужно.

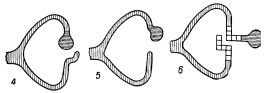

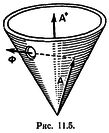

Т.е. обратная цепочка вполне позволяет нейрону "утомиться" - самому себя затормозить.

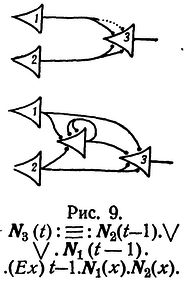

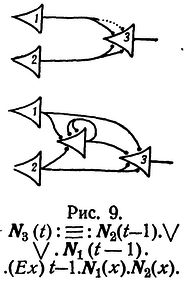

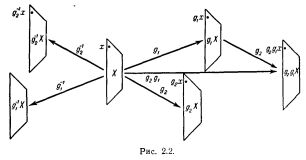

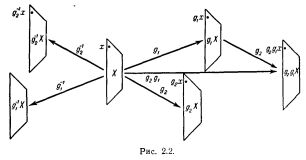

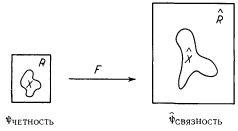

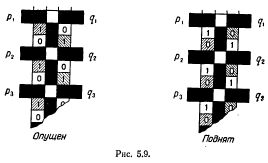

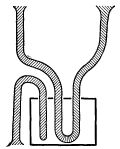

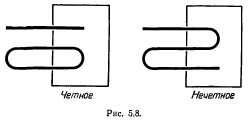

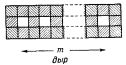

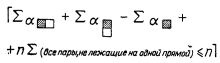

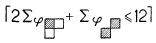

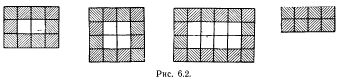

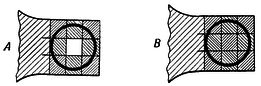

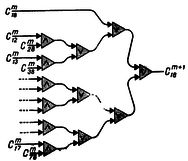

Т.е. вводить нейроны "переменных" свойств для изменения состояния сети нет никакой необходимости. Можно просто добавить нужные цепочки нейронов.

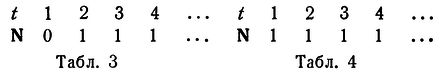

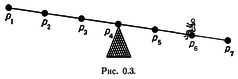

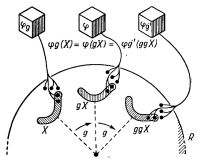

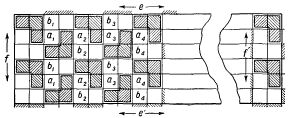

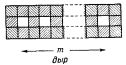

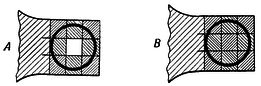

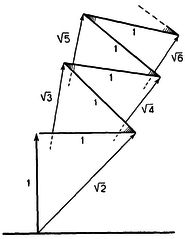

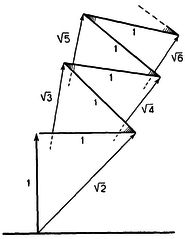

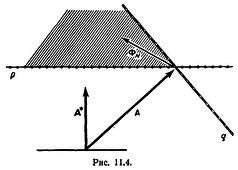

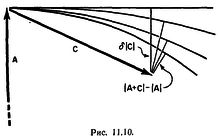

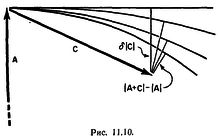

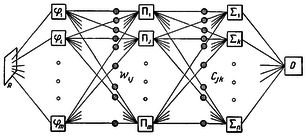

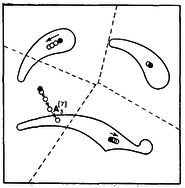

Замена изменяемого синапса петлей.

Последнее особенно печально для современных верующих в Исусственый Интеллект - обучение не может сделать сеть "умнее" сети, правильно запрограммированной изначально.

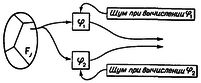

Формулы этой главы еще сложнее, но суть проста:

Проще говоря - ТЕМА #98, АБЗАЦ #1244

ТЕМА #98, АБЗАЦ #1244 .

.

Тут уж решайте сами, достаточно ли вам столь простых моделей, или вы считаете, что "настоящие мозги" устроены намного сложнее, а "современный искусственный интеллект" - и подавно.

ТЕМА #135, АБЗАЦ #2819

ТЕМА #135, АБЗАЦ #2819

ЛОГИЧЕСКОЕ ИСЧИСЛЕНИЕ ИДЕЙ, ОТНОСЯЩИХСЯ К НЕРВНОЙ АКТИВНОСТИ

УОРРЕН С.МАК-КАЛЛОК И ВАЛЬТЕР ПИТТС

A logical calculus of the ideas immanent in nervous activity, W.S.McCulloch and W.Pitts, Bull. Math. Biophys., 5, 115-133 (1943)

Поскольку нервная активность подчиняется закону "все или ничего", то нейронные события и соотношения между ними можно изучать средствами логики предложений. Оказывается, что поведение любой сети может быть описано в этих терминах с привлечением более сложных логических средств для сетей, содержащих петли. Для всякого логического выражения, удовлетворяющего некоторым условиям, можно найти сеть, имеющую описываемое этим выражением поведение. Показывается, что различные выборы возможных нейрофизиологических предпосылок эквивалентны в том смысле, что для сети, действующей согласно одной предпосылке, существует другая сеть, действующая согласно другой и дающая те же результаты, хотя, быть может, не за то же самое время. Обсуждаются различные приложения исчисления.

Сразу два замечания. Первое:

Как видно, эта статья вышла еще до того, как научились делать "настоящие ЭВМ". Позднее Н.Винер писал в своей "Кибернетике":

Г-н Питтс был тогда основательно знаком с математической логикой и нейрофизиологией, но не имел случая сколько-нибудь близко соприкасаться с техникой. В частности, он не был знаком с работой д-ра Шеннона и недостаточно ясно представлял себе возможности электроники. Он очень заинтересовался, когда я показал ему образцы современных вакуумных ламп и объяснил, что они являются идеальным средством для реализации в металле эквивалентов рассматриваемых им нейронных сетей и систем. С этого времени нам стало ясно, что сверхбыстрая вычислительная машина, поскольку вся она строится на последовательном соединении переключательных устройств, является идеальной моделью для решения задач, возникающих при изучении нервной системы. Возбуждение нейронов по принципу "все или ничего" в точности подобно однократному выбору, производимому при определении разряда двоичного числа; а двоичная система счисления уже признавалась не одним из нас за наиболее удовлетворительную основу для проектирования вычислительных машин. Синапс есть не что иное, как механизм, определяющий, будет ли некоторая комбинация выходных сигналов от данных предыдущих элементов служить подходящим стимулом для возбуждения следующего элемента или нет; тем самым синапс в точности подобен устройствам вычислительной машины. Наконец, проблема объяснения природы и разновидностей памяти у животных находит параллель в задаче создания искусственных органов памяти для машин.

Т.е. это ЭВМ стали средством реализации сетевой модели, а не "сети отменили ЭВМ".

Второе замечание:

Конечно, тут не без некоторого жульничества. На протяжении всей этой темы под сетью подразумевается не честный кусок добытого из живого организма мыслящего вещества, а всего лишь некоторая математическая/электронная модель, "достаточная для имитации мыслепроцесса". Т.е. мы не гарантируем, что мозг работает именно так, но не можем найти разницы в работе мозга и машины.

Начало рассматриваемой статьи, как раз, посвящено выделению в нейронах разумного начала.

I. ВВЕДЕНИЕ

Теоретическая нейрофизиология базируется на нескольких основных предпосылках. Нервная система является сетью нейронов, каждый из которых имеет тело и аксон. Места контакта нейронов, или синапсы, находятся всегда между аксоном одного и телом другого нейрона. В каждый момент нейрон имеет известный порог, который должно превзойти раздражение, чтобы вызвать нервный импульс. Все это, если не считать самого факта и момента появления импульса, определено нейроном, а не раздражением. От точки раздражения импульс распространяется по всему нейрону. Скорость распространения импульса по аксону пропорциональна диаметру аксона и варьируется от менее 1м/сек в тонких аксонах, которые бывают обычно короткими, до более чем 150м/сек в толстых аксонах, обычно длинных. Время распространения импульса по аксону не играет, следовательно, большой роли при определении времени прибытия импульсов в точки, удаленные от одного и того же источника на разные расстояния. Возбуждение передается через синапсы преимущественно от окончания аксона к телу. Остается спорным вопрос, обусловлено ли это необратимостью отдельных синапсов или же преобладанием некоторых анатомических конфигураций. Последнее предположение не требует гипотез ad hoc и объясняет известные исключения; однако любое предположение о причине такого явления совместимо с нижеследующим исчислением. Не известно ни одного случая, когда возбуждение, приходящее через один синапс, вызвало бы импульс в каком-либо нейроне, тогда как любой нейрон может быть возбужден импульсами, приходящими через достаточное число соседних синапсов в течение латентного периода, который продолжается менее четверти миллисекунды. Наблюдаемая временная суммация импульсов в более длительных интервалах времени для отдельных нейронов невозможна и эмпирически зависит от структурных свойств сети. Между прибытием импульсов к нейрону и распространением собственного импульса нейрона имеется синаптическая задержка, большая половины миллисекунды. В начале нервного импульса нейрон абсолютно невозбудим. Затем его возбудимость быстро восстанавливается, достигая в некоторых случаях сверхнормального уровня, после чего она снова становится несколько ниже нормальной, а затем медленно возвращается к нормальному уровню. Частые возбуждения увеличивают понижение порога возбудимости ниже нормального уровня. Эти особенности связаны со временем и местом появления нервных импульсов и не связаны ни с какими другими особенностями действий нейронов. Из последних одно лишь явление торможения приводилось в качестве серьезного довода против этого тезиса. Торможение есть прекращение или предотвращение активности одной группы нейронов посредством одновременной или предшествующей активности другой группы. До последнего времени это могло быть объяснено предположением, что предшествующая активность нейронов второй группы может настолько повысить пороги вставочных нейронов (internuncial neurons), что последние будут не в состоянии возбудиться от нейронов первой группы, тогда как импульсы нейронов первой группы должны складываться с импульсами вставочных нейронов для возбуждения нейронов, теперь тормозимых.

В настоящее время показано, что в некоторых случаях, торможение происходит менее чем в одну миллисекунду. Это исключает участие вставочных нейронов и требует существования синапсов, импульсы через которые тормозят нейрон, возбуждаемый импульсами через другие синапсы. До сих пор эксперимент не обнаружил, является ли эта невозбудимость относительной или абсолютной. Мы предположим последнее и покажем, что разница несущественна для наших рассуждений. Каждый из видов невозбудимости может быть объяснен любым из двух способов: "тормозящий синапс" может обладать способностью вырабатывать вещество, повышающее порог нейрона, или же этот синапс может быть расположен таким образом, что локальное нарушение, производимое его возбуждением, препятствует изменению, вызываемому синапсами, которые в противном случае возбуждали бы нейрон. Поскольку в случае электрического раздражения уже известны условия, при которых подобный эффект имеет место, то первая гипотеза должна быть исключена, если и до тех пор пока она не будет подтверждена, ибо вторая не включает в себя никаких новых гипотез. Мы имеем тогда два объяснения торможения, основанных на одной и той же общей предпосылке и отличающихся только в отношении рассматриваемых нервных сетей и, следовательно, в отношении времени, потребного на торможение. В дальнейшем мы будем говорить о таких нервных сетях как об ЭКВИВАЛЕНТНЫХ В ШИРОКОМ СМЫСЛЕ. Поскольку мы рассматриваем свойства сетей, инвариантные по отношению к этой эквивалентности, мы можем делать физические допущения, наиболее удобные для нашего исчисления.

Т.о. авторы видят возможность упростить модель нейронной сети, отказавшись от рассмотрения сложных электрических переходных процессов. Впрочем, я знаю модель, в которой возбуждение "нейронов" было более "частотно-чувствительным" -

ТЕМА #98, АБЗАЦ #1295

ТЕМА #98, АБЗАЦ #1295 .

.Много лет назад один из нас, путем смелого рассмотрения этой аргументации, пришел к пониманию реакции любого нейрона как фактического эквивалента предложения, изображающего соответствующее возбуждение. Вследствие этого он попытался описать поведение сложных сетей в терминах символической логики предложений. Закон нервной активности "все или ничего" достаточен для того, чтобы возбуждение любого нейрона могло быть представлено как некоторое предложение. Физиологические соотношения, существующие при нервной активности, соответствуют, конечно, соотношениям этих предложений. Полезность такого представления зависит от тождественности физиологических соотношений с соотношениями логики предложений. Для каждой реакции любого нейрона имеется соответствующее утверждение некоторого простого предложения. В свою очередь оно влечет или некоторое другое простое предложение, или дизъюнкцию, или конъюнкцию, с отрицанием или без отрицания, аналогичных предложений, согласно с конфигурацией синапсов и порогом данного нейрона.

Что дает нам способ расчета нервной активности по правилам обычной математической логики.

Появляются две трудности. Первая относится к явлениям облегчения и утомления (facilitation и extinction), при которых предшествующая активность временно изменяет реакцию одной и той же части сети на последующий стимул. Вторая трудность касается явления обучения, при котором одновременные активности в предшествующее время изменили сеть так, что стимул, прежде бывший недостаточным, становится теперь достаточным. Однако мы можем сети, подверженные обоим изменениям, заменить эквивалентными фиктивными сетями, составленными из нейронов с неизменяемыми связями и порогами. Однако один пункт должен быть сделан ясным: никто из нас не смешивает формальной эквивалентности с фактическим истолкованием. Per contra!- Мы рассматриваем облегчение и утомление как зависящие от непрерывных изменений порога, связанных с электрическими и химическими переменными, такими, как остаточные потенциалы (after potentials) и концентрации ионов; обучение же мы рассматриваем как длительное изменение, могущее перенести сон, анестезию, конвульсии и кому. Значение формальной эквивалентности состоит в следующем: изменения, фактически лежащие в основе облегчения, утомления и обучения, никоим образом не затрагивают выводов, следующих из формальной трактовки активности нервных сетей, и соотношения соответствующих предложений остаются соотношениями логики предложений.

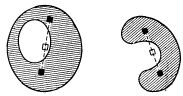

Нервная система содержит много циклических путей. Их активность так регенерирует возбуждение всех участвующих в них нейронов, что связь с прошлым становится неопределенной, хотя при этом все же предполагается, что афферентная активность реализовала один из некоторого числа классов конфигураций во времени. Точная спецификация этих зависимостей посредством рекурсивных функций и определение тех из них, которые могут быть воплощены в активности нервных сетей, завершают теорию.

II. ТЕОРИЯ: СЕТИ БЕЗ ПЕТЕЛЬ

Примем следующие физические допущения для нашего исчисления.

1. Активность нейрона удовлетворяет принципу "все или ничего".

2. Возбуждению нейрона в какой-либо момент времени должен предшествовать латентный период накопления возбуждений определенного фиксированного числа синапсов. Это число не зависит от предыдущей активности и от расположения синапсов на нейроне.

3. Единственным запаздыванием в нервной системе, имеющим значение, является синаптическая задержка.

4. Активность какого-либо тормозящего синапса абсолютно исключает возбуждение данного нейрона в рассматриваемый момент времени.

5. С течением времени структура сети не изменяется.

Большую часть формализмов я опускаю. Публикация 1956 года явно требует перевода на язык современной школьной мат.логики. Суть описываемых изысканий достаточно проста и интуитивно понятна из приведенных иллюстраций.

Первые две теоремы посвящены эквивалентности логических выражений и сетей. Для всякой сети найдется предикат и почти для каждого выражения - сеть без петель.

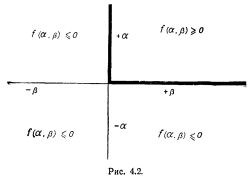

Выражения отличаются от обычных в двух отношениях. Во-первых, как отдельная операция (и как свойство других единичных операций) вводится задержка (синаптическая), позволяющая рассматривать вычисление в сети "пошагово" - от нейрона к нейрону. Понятие эквивалентности (реализуемости) т.о. становится вневременным - нам становится неважным, сколько шагов заняли два вычисления, важно, чтобы их результаты совпали.

Просто задержка. В статье порог нейрона обычно считается равным 2.

Простые логические операции с единичной задержкой.

Вторая тонкость - исключение из рассмотрения выражений являющихся истинными при отсутствии в их обозримом прошлом истинных входных значений (рецепторов, peripheral afferents). (Т.е. самовозбуждающихся сетей и сетей с бесконечной памятью).

Этому ограничению посвящена третья теорема.

Следующие четыре теоремы посвящены доказательству того, что дальнейшее "биологическое" усложнение сетей не дает новых вычислительных возможностей:

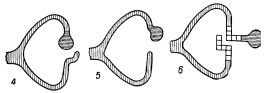

Теорема 4. Относительное и абсолютное торможения эквивалентны в широком смысле.

Т.е. относительное торможение - временное повышение порога чувствительности нейрона до его полной невозбудимости - вводить не нужно.

Теорема 5. Утомление эквивалентно абсолютному торможению.

Т.е. обратная цепочка вполне позволяет нейрону "утомиться" - самому себя затормозить.

Теорема 6. Облегчение и временная суммация могут быть заменены пространственной суммацией.

Т.е. вводить нейроны "переменных" свойств для изменения состояния сети нет никакой необходимости. Можно просто добавить нужные цепочки нейронов.

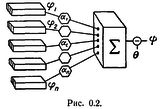

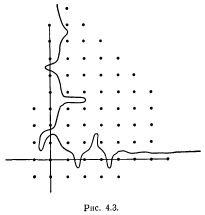

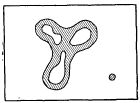

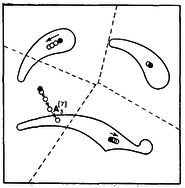

Кажется, что явления обучения, имеющие устойчивый характер при большинстве физиологических изменений в нервной активности, требуют возможности постоянного изменения структуры сети. Простейшее изменение такого рода - образование новых синапсов или эквивалентное ему понижение порога. Предположим, что некоторые . окончания аксонов не могут сначала возбудить следующий нейрон, но если в ка-кой-нибудь момент нейрон возбуждается одновременно с этими окончаниями, то они превращаются в обычные синапсы, способные в дальнейшем возбуждать нейрон. Устранение тормозящего синапса дает совершенно эквивалентный результат.

Мы имеем теперь следующую теорему:

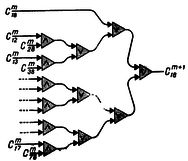

Теорема 7. Изменяемые синапсы могут быть заменены петлями.

Замена изменяемого синапса петлей.

Последнее особенно печально для современных верующих в Исусственый Интеллект - обучение не может сделать сеть "умнее" сети, правильно запрограммированной изначально.

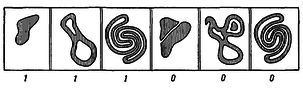

III. ТЕОРИЯ: СЕТИ С ПЕТЛЯМИ

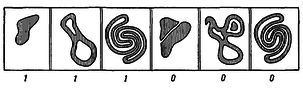

Формулы этой главы еще сложнее, но суть проста:

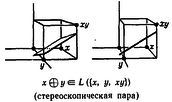

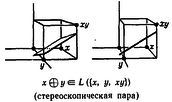

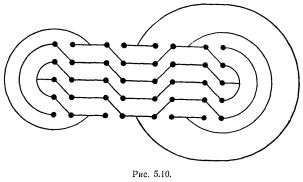

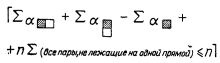

Легко показать, что, во-первых, каждая сеть, снабженная лентой, считывающим устройством, связанным с рецепторами, и подходящими эффекторами для выполнения необходимых моторных операций, может вычислять лишь такие числа, которые вычисляет машина Тьюринга; во-вторых, что каждое из последних чисел может быть вычислено такой сетью и что сети (без считывающего устройства и ленты) с петлями могут вычислять некоторые из вычислимых чисел и никакие другие, но не все из них. Это представляет интерес с точки зрения психологического оправдания тьюринговского определения вычислимости и его эквивалентов, черчевской А-опре-делимости и клинивской общерекурсивности: если какое-либо число может быть вычислено организмом, то оно вычислимо также по этим определениям, и обратно.

Проще говоря -

ТЕМА #98, АБЗАЦ #1244

ТЕМА #98, АБЗАЦ #1244 .

.IV. СЛЕДСТВИЯ

Причинность, требующая описания состояний и закона необходимой связи между ними, проявляется в различных формах во многих науках, но нигде, за исключением статистики, она не является столь необратимой, как в теории нервной активности. Задание в произвольный момент времени рецепторных возбуждений и активности (удовлетворяющей принципу "все или ничего") всех составляющих нейронов определяет состояние. Задание нервной сети определяет закон необходимой связи, с помощью которого по описанию любого состояния можно вычислить следующее за ним состояние, однако включение дизъюнктивных соотношений не позволяет полностью определить предшествующее состояние. Кроме того, восстанавливающая активность входящих в сеть петель делает связь с прошлым неопределенной. Так, наше знание мира, включая нас самих, неполно в пространственном отношении и неопределенно в отношении времени. Это незнание, касающееся неявно всех наших умственных способностей, является обратной стороной абстракции, делающей наше знание полезным. Роль умственных способностей при определении эпистемологической связи наших теорий с нашими наблюдениями и наших наблюдений с фактами совершенно ясна, ибо очевидно, что каждая идея и каждое ощущение реализуются активностью внутри нервной сети и что действительные возбуждения рецепторов не определены полностью никакой такой активностью.

Не имеется никакой теории или наблюдения, которые могли бы сохранить нечто большее, кроме их дефектного отношения к фактам, если сеть изменяется. Появляются звон в ушах, мурашки, галлюцинации, иллюзии, смешение ощущений и дизориентация. Опыт, следовательно, подтверждает, что если наши сети не определены, то неопределенными являются и наши факты, и "реальности" мы не можем приписать ничего большего, чем одно качество или "форму". С определением сети непознаваемый объект знания, "вещь в себе", перестает быть непознаваемым.

В психологии, как бы она ни определялась, описание сети дало бы все, что может быть достигнуто в этой области, даже если анализ дошел бы до конечных психических единиц или "психонов", ибо психон не может быть ничем меньшим, чем активностью отдельного нейрона. Так как эта активность по своей природе пропозициональна, то все психические события имеют преднамеренный, или "семиотический", характер. Закон "все или ничего" этой активности и соответствие ее соотношений соотношениям логики предложений обеспечивают то, что соотношения психонов суть соотношения двузначной логики предложений. Следовательно, в психологии, интроспективной, бихэвиористской или физиологической, основными являются соотношения двузначной логики.

Отсюда возникают конструктивные решения холистических проблем, включающих в себя дифференцированный континуум чувственных ощущений и нормативные, совершенствующие и разрешающие свойства восприятия и исполнения. Из необратимости причинности следует, что, даже если сеть известна, то, хотя по настоящей активности мы можем предсказать будущее, мы не можем определить ни афферентное

по центральному, ни центральное по эфферентному, ни прошлое по настоящей активности. Эти заключения подкрепляются фактами существования противоречивых свидетельств очевидцев, трудностью дифференцированного диагностирования органических больных, истерики и симуляции, и сравнением памяти и воспоминаний с записями. Более того, системы, которые реагируют на различие между афферентами регенеративной сети и некоторой активностью в этой сети так, что уменьшают это различие, обнаруживают целевое поведение. Известно, что организмы обладают многими такими системами, обслуживающими гомеостазис, желание и внимание. Таким образом, как формальный, так и конечный аспекты этой активности, которую мы обычно называем умственной, строго выводимы из современной нейрофизиологии. Психиатр может найти утешение в очевидном заключении, касающемся причинности, именно, что для прогноза история никогда не необходима. Он может извлечь немногое из того равным образом справедливого вывода, что наблюдаемое им объяснимо лишь в терминах нервной активности, бывшей до последнего времени вне его кругозора. Центральным моментом этого незнания является неоднозначность перехода от произвольного образца видимого поведения к нервным сетям, тогда как из воображаемых сетей существует фактически только одна, и она может в любой момент обнаружить непредвиденную активность. Разумеется, для психиатра большее значение имеет то обстоятельство, что в таких системах "разум" уже не бродит "более призрачно, чем призрак". Напротив, расстройство ума можно изучать, без потери общности или строгости, в научных терминах нейрофизиологии.

В нейрологии теория нервных сетей заостряет различие между сетями, необходимыми или только достаточными для заданной активности, выясняя, таким образом, соотношения между нарушенной структурой и нарушенным функционированием. В собственной области этой теории различие между эквивалентными сетями и сетями, эквивалентными в- узком смысле, указывает на подходящее использование и на важность изучения нервной деятельности во времени.

Математической биофизике эта теория доставляет некоторый способ строгой символической трактовки известных сетей и легкий метод конструирования гипотетических сетей с требуемыми свойствами.

Тут уж решайте сами, достаточно ли вам столь простых моделей, или вы считаете, что "настоящие мозги" устроены намного сложнее, а "современный искусственный интеллект" - и подавно.

Последний раз редактировалось: Gudleifr (Пн Сен 18, 2023 2:49 am), всего редактировалось 1 раз(а)

Gudleifr- Admin

- Сообщения : 3402

Дата регистрации : 2017-03-29

Re: 02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

Re: 02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

ПРЕДСТАВЛЕНИЕ СОБЫТИЙ В НЕРВНЫХ СЕТЯХ И КОНЕЧНЫХ АВТОМАТАХ

С.К.КЛИНИ

Тоже из сб. АВТОМАТЫ, 1956 ТЕМА #135, АБЗАЦ #2819

ТЕМА #135, АБЗАЦ #2819

Содержание этой статьи заимствовано из Project RAND Research Memorandum RM-704 (15 декабря 1951г., 101стр.) под тем же заглавием и того же автора. Это сочинение используется теперь с разрешения корпорации RAND. Первоначальная работа автора над этой проблемой поддерживалась корпорацией RAND в течение лета 1951г.

ВВЕДЕНИЕ

#1. СТИМУЛЫ И РЕАКЦИЯ

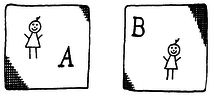

Организм или автомат получает стимулы (возбуждения) посредством своих воспринимающих органов и совершает действия посредством своих действующих органов. Утверждение, что некоторые действия являются реакцией (ответом) на известные стимулы, означает, в простейшем случае, что эти действия производятся тогда и только тогда, когда возникают эти стимулы.

В общем случае как стимулы, так и действия могут быть очень сложными.

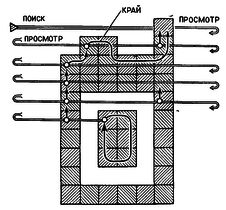

Чтобы упростить наш анализ, мы для начала оставим в стороне сложность реакции. Мы будем считать, что любой вид возбуждения (или, короче, любое событие), который вызывает действие в том смысле, что различные действия возникают в соответствии с тем, имеет место возбуждение или нет, при некотором фиксированном множестве других обстоятельств должен иметь представление состоянием организма или автомата после того, как событие произошло, и до того, как наступило действие.

Мы спрашиваем, какого рода события могут быть представлены состоянием автомата.

Для объяснения действий как реакций на стимулы останется изучить, каким образом представления событий (разновидность внутренней реакции) приводят к явным реакциям.

Основным нашим результатом будет (в #7 и 9) доказательство того, что представимыми являются все события некоторого класса, называемые "регулярными событиями", и только они.

#2. Нервные сети и поведение

Мак-Каллок и Питтс [1943] в их фундаментальной статье о логическом анализе нервной деятельности сформулировали некоторые допущения, которые мы воспроизведем в #3.

При доказательстве того, что каждое регулярное событие представимо состоянием конечного автомата, мы будем пользоваться в качестве автомата нервной сетью Мак-Каллока-Питтса. Таким образом, их нейроны будут служить одним из примеров "универсальных элементов" для конечных автоматов.

Допущения Мак-Каллока-Питтса были предложены в качестве абстракции от нейрофизиологических данных. Мы не будем интересоваться вопросом, насколько точно их допущения согласуются с этими данными. Повидимому, они приблизительно согласуются, хотя один из результатов Мак-Каллока и Питтса гласит, что такое же поведение можно объяснить некоторыми другими допущениями. Нет сомнения, что, когда нейрофизиологические данные достигнут большей точности, внимание будет перенесено на то, в каких отношениях эти допущения не согласуются с данными.

Наша теоретическая установка не зависит от точного согласования. В науке обычен метод, состоящий в том, что при наличии совокупности данных, слишком сложной для того, чтобы овладеть ею в целом, выбираются некоторая ограниченная область опыта, некоторые простые ситуации и предпринимается построение модели, хотя бы приближенно соответствующей этой области.

Следующим шагом после построения такой модели является полное познание самой модели. Не следует ожидать, что все черты модели будут одинаково хорошо соответствовать действительности, из которой путем абстракции получена эта модель. Но, после того как модель изучена, нам легче изменить или приспособить ее, заставив лучше удовлетворять нашим ограниченным данным или более широкому кругу данных или же искать модель совершенно нового рода.

Мак-Каллок и Питтс в их оригинальной работе дали теорию нервных сетей без петель (часть II их работы) и теорию произвольных нервных сетей (часть III). Настоящая статья является отчасти изложением их результатов; но так как мы находим неясной ту часть их работы, которая связана с произвольными нервными сетями, то мы будем излагать эти вопросы независимо. Хотя нас больше интересует сама модель, чем ее применения, несколько замечаний о последних помогут предупредить недоразумения.

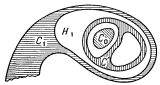

Например: как показывает рассмотрение модели, память можно объяснить на основе циркулирующих нервных импульсов. Это объяснение кажется правдоподобным для краткосрочной памяти. Для долгосрочной памяти оно неправдоподобно в связи с уставанием, а также ввиду того, что подсчет, учитывающий количество накопленного в памяти материала, приводит к слишком большому числу нейронов [Мак-Каллок, 1949], и ввиду того непосредственно экспериментального факта, что временное пресечение нервной деятельности не уничтожает памяти [Жерар, 1953].

Допущения Мак-Каллока-Питтса придают нервной сети характер цифрового автомата, в противоположность моделирующему механизму в обычном для теории вычислительных машин смысле. Некоторые регулирующие физиологические процессы являются, повидимому, моделирующими. Так же как в математике непрерывные процессы можно аппроксимировать дискретными, так и моделирующие механизмы можно аппроксимировать в их действии цифровыми. Несмотря на это, моделирующее или частично моделирующее урегулирование для некоторых целей может оказаться самым простым и самым экономным.

Одно из допущений излагаемой математической теории состоит в том, что в функционировании нейронов не бывает ошибок. Конечно, это допущение нереально как для живого нейрона, так и для соответствующих узлов механического автомата. Однако естественно начать с теории, основанной на допущении об отсутствии неправильного функционирования. Действительно, в нашей теории наступление события может быть представлено возбуждением единичного нейрона. Биологически неправдоподобно, чтобы важная информация была представлена в организме таким образом. Но при надлежащем дублировании и переплетении сетей можно надеяться обеспечить те же результаты с малой вероятностью ошибки в сетях, построенных из нейронов, подверженных ошибкам. Повторяем, что мы исследуем нервные сети Мак-Каллока-Питтса не только с целью получить упрощенную модель нервной деятельности, но и с целью иллюстрации общей теории автоматов, включая роботы, вычислительные машины и т.п. Проблема: что может и что не может делать конечный автомат - представляет, как нам кажется, самостоятельный математический интерес, и она может также содействовать лучшему пониманию задач, возникающих на практике.

С.К.КЛИНИ

Тоже из сб. АВТОМАТЫ, 1956

ТЕМА #135, АБЗАЦ #2819

ТЕМА #135, АБЗАЦ #2819

Содержание этой статьи заимствовано из Project RAND Research Memorandum RM-704 (15 декабря 1951г., 101стр.) под тем же заглавием и того же автора. Это сочинение используется теперь с разрешения корпорации RAND. Первоначальная работа автора над этой проблемой поддерживалась корпорацией RAND в течение лета 1951г.

ВВЕДЕНИЕ

#1. СТИМУЛЫ И РЕАКЦИЯ

Организм или автомат получает стимулы (возбуждения) посредством своих воспринимающих органов и совершает действия посредством своих действующих органов. Утверждение, что некоторые действия являются реакцией (ответом) на известные стимулы, означает, в простейшем случае, что эти действия производятся тогда и только тогда, когда возникают эти стимулы.

В общем случае как стимулы, так и действия могут быть очень сложными.

Чтобы упростить наш анализ, мы для начала оставим в стороне сложность реакции. Мы будем считать, что любой вид возбуждения (или, короче, любое событие), который вызывает действие в том смысле, что различные действия возникают в соответствии с тем, имеет место возбуждение или нет, при некотором фиксированном множестве других обстоятельств должен иметь представление состоянием организма или автомата после того, как событие произошло, и до того, как наступило действие.

Мы спрашиваем, какого рода события могут быть представлены состоянием автомата.

Для объяснения действий как реакций на стимулы останется изучить, каким образом представления событий (разновидность внутренней реакции) приводят к явным реакциям.

Основным нашим результатом будет (в #7 и 9) доказательство того, что представимыми являются все события некоторого класса, называемые "регулярными событиями", и только они.

#2. Нервные сети и поведение

Мак-Каллок и Питтс [1943] в их фундаментальной статье о логическом анализе нервной деятельности сформулировали некоторые допущения, которые мы воспроизведем в #3.

При доказательстве того, что каждое регулярное событие представимо состоянием конечного автомата, мы будем пользоваться в качестве автомата нервной сетью Мак-Каллока-Питтса. Таким образом, их нейроны будут служить одним из примеров "универсальных элементов" для конечных автоматов.

Допущения Мак-Каллока-Питтса были предложены в качестве абстракции от нейрофизиологических данных. Мы не будем интересоваться вопросом, насколько точно их допущения согласуются с этими данными. Повидимому, они приблизительно согласуются, хотя один из результатов Мак-Каллока и Питтса гласит, что такое же поведение можно объяснить некоторыми другими допущениями. Нет сомнения, что, когда нейрофизиологические данные достигнут большей точности, внимание будет перенесено на то, в каких отношениях эти допущения не согласуются с данными.

Наша теоретическая установка не зависит от точного согласования. В науке обычен метод, состоящий в том, что при наличии совокупности данных, слишком сложной для того, чтобы овладеть ею в целом, выбираются некоторая ограниченная область опыта, некоторые простые ситуации и предпринимается построение модели, хотя бы приближенно соответствующей этой области.

Следующим шагом после построения такой модели является полное познание самой модели. Не следует ожидать, что все черты модели будут одинаково хорошо соответствовать действительности, из которой путем абстракции получена эта модель. Но, после того как модель изучена, нам легче изменить или приспособить ее, заставив лучше удовлетворять нашим ограниченным данным или более широкому кругу данных или же искать модель совершенно нового рода.

Мак-Каллок и Питтс в их оригинальной работе дали теорию нервных сетей без петель (часть II их работы) и теорию произвольных нервных сетей (часть III). Настоящая статья является отчасти изложением их результатов; но так как мы находим неясной ту часть их работы, которая связана с произвольными нервными сетями, то мы будем излагать эти вопросы независимо. Хотя нас больше интересует сама модель, чем ее применения, несколько замечаний о последних помогут предупредить недоразумения.

Например: как показывает рассмотрение модели, память можно объяснить на основе циркулирующих нервных импульсов. Это объяснение кажется правдоподобным для краткосрочной памяти. Для долгосрочной памяти оно неправдоподобно в связи с уставанием, а также ввиду того, что подсчет, учитывающий количество накопленного в памяти материала, приводит к слишком большому числу нейронов [Мак-Каллок, 1949], и ввиду того непосредственно экспериментального факта, что временное пресечение нервной деятельности не уничтожает памяти [Жерар, 1953].

Допущения Мак-Каллока-Питтса придают нервной сети характер цифрового автомата, в противоположность моделирующему механизму в обычном для теории вычислительных машин смысле. Некоторые регулирующие физиологические процессы являются, повидимому, моделирующими. Так же как в математике непрерывные процессы можно аппроксимировать дискретными, так и моделирующие механизмы можно аппроксимировать в их действии цифровыми. Несмотря на это, моделирующее или частично моделирующее урегулирование для некоторых целей может оказаться самым простым и самым экономным.

Одно из допущений излагаемой математической теории состоит в том, что в функционировании нейронов не бывает ошибок. Конечно, это допущение нереально как для живого нейрона, так и для соответствующих узлов механического автомата. Однако естественно начать с теории, основанной на допущении об отсутствии неправильного функционирования. Действительно, в нашей теории наступление события может быть представлено возбуждением единичного нейрона. Биологически неправдоподобно, чтобы важная информация была представлена в организме таким образом. Но при надлежащем дублировании и переплетении сетей можно надеяться обеспечить те же результаты с малой вероятностью ошибки в сетях, построенных из нейронов, подверженных ошибкам. Повторяем, что мы исследуем нервные сети Мак-Каллока-Питтса не только с целью получить упрощенную модель нервной деятельности, но и с целью иллюстрации общей теории автоматов, включая роботы, вычислительные машины и т.п. Проблема: что может и что не может делать конечный автомат - представляет, как нам кажется, самостоятельный математический интерес, и она может также содействовать лучшему пониманию задач, возникающих на практике.

Последний раз редактировалось: Gudleifr (Пт Июн 30, 2023 11:49 pm), всего редактировалось 1 раз(а)

Gudleifr- Admin

- Сообщения : 3402

Дата регистрации : 2017-03-29

Re: 02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

Re: 02.06. НЕХВАТКА ЕСТЕСТВЕННОГО ИНТЕЛЛЕКТА

ЧАСТЬ I. НЕРВНЫЕ СЕТИ

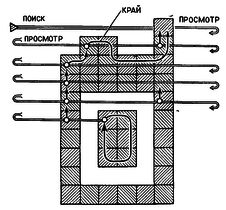

#3. НЕРВНЫЕ СЕТИ МАК-КАЛЛОКА-ПИТТСА

По допущениям Мак-Каллока и Питтса [1943], нервная клетка, или нейрон, состоит из тела (сомы), откуда нервные волокна (аксоны) ведут к одной или нескольким концевым пластинкам.

Нервная сеть является устройством из конечного числа нейронов, в котором каждая концевая пластинка любого нейрона соприкасается с телом не более чем одного нейрона (того же самого или другого), который она возбуждает; разделяющий промежуток называется синапсом. Каждая концевая пластинка является возбуждающей или тормозящей (и не может быть возбуждающей и тормозящей одновременно).

Мы будем называть нейроны, к которым не примыкают никакие концевые пластинки, входными нейронами (число их может равняться нулю); остальные нейроны мы будем называть внутренними.

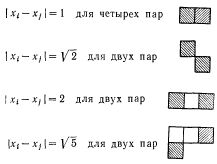

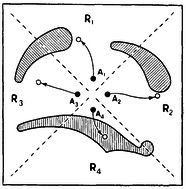

В равноотстоящие моменты времени (которые мы будем рассматривать как целые числа на временной шкале, одни и те же для всех нейронов данной сети) каждый нейрон сети является возбужденным или невозбужденным (спокойным). Для входного нейрона возбужденность или невозбужденность в любой момент t определяется условиями, внешними по отношению к сети. Можно предположить, что к каждому из них примыкает чувственно воспринимающий орган, который при надлежащих условиях в окружающей среде вызывает возбуждение нейрона в момент t. Для внутреннего нейрона условие возбужденности в момент t состоит в том, что по меньшей мере h (h называется порогом этого нейрона) возбуждающих концевых пластинок действуют, а ни одна из тормозящих не действует в момент t-1).

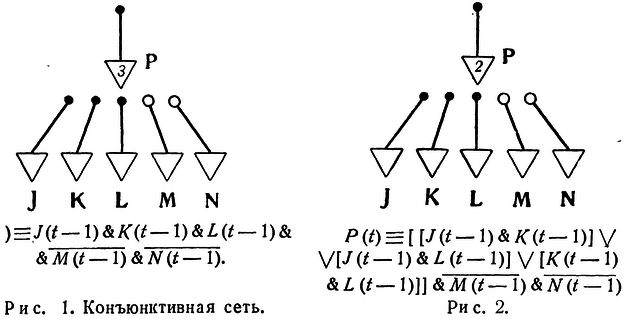

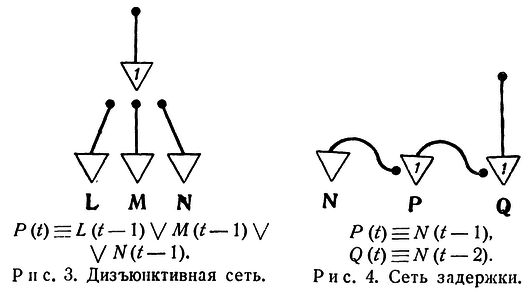

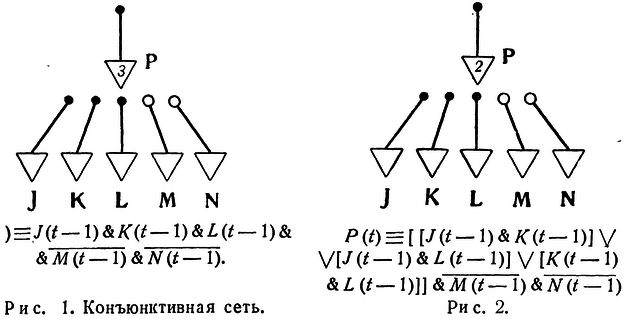

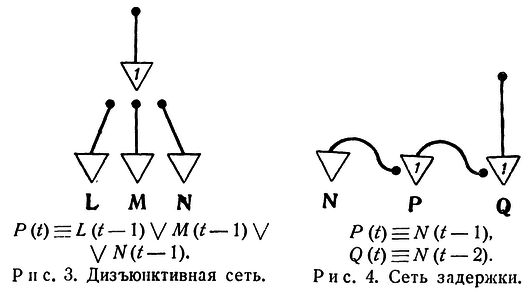

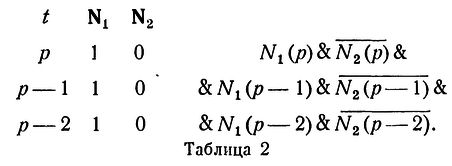

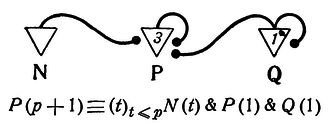

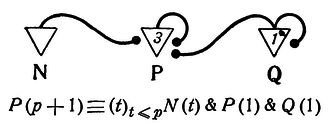

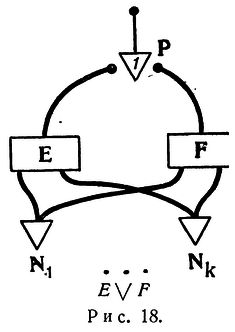

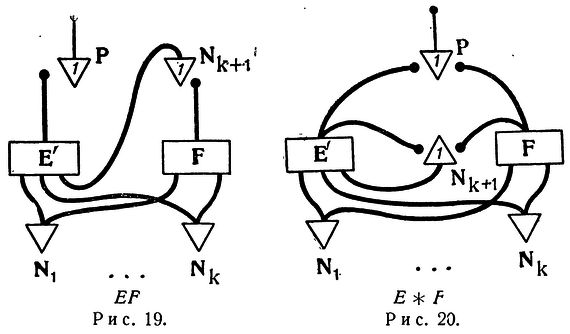

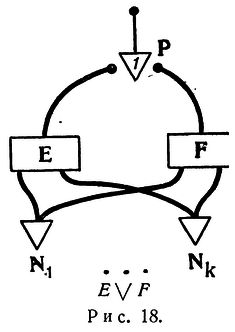

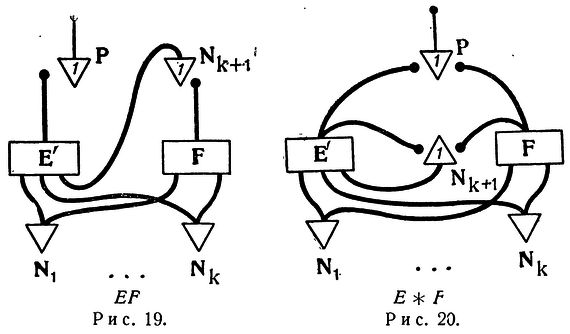

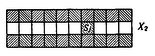

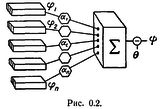

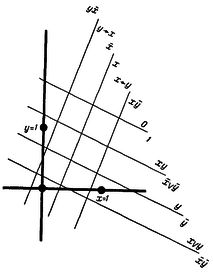

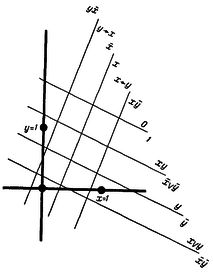

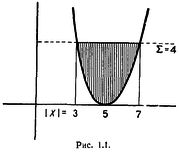

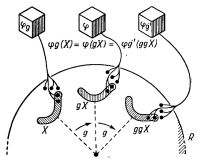

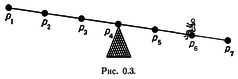

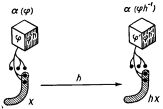

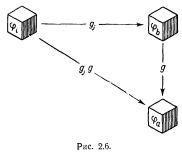

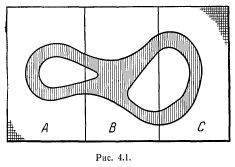

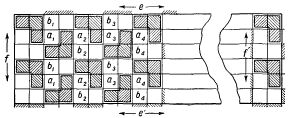

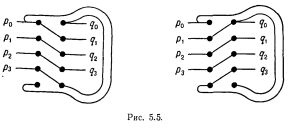

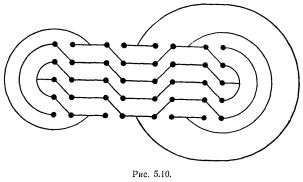

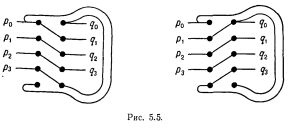

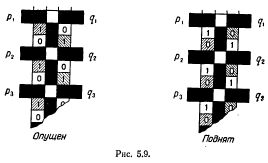

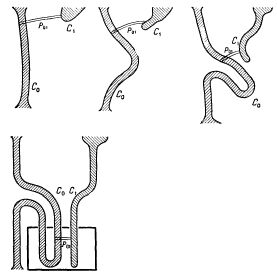

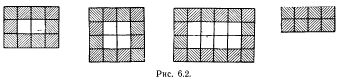

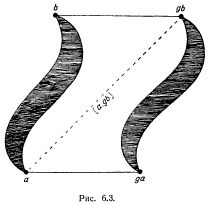

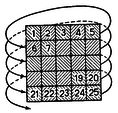

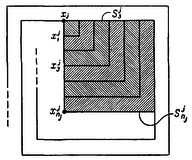

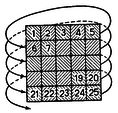

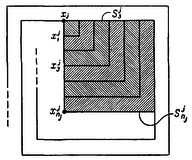

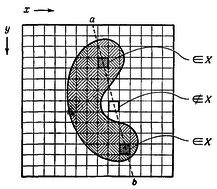

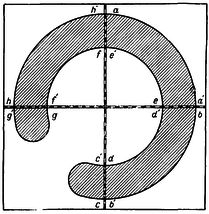

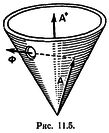

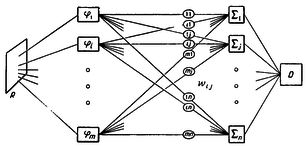

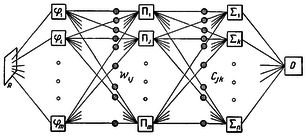

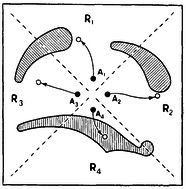

Для иллюстрации рассмотрим нервную сеть, показанную на рис.1, с входными нейронами J, К, L, М, N и внутренним нейроном Р. Возбуждающие концевые пластинки изображены жирными точками, а тормозящие - кружками. Порог Р равен 3, что указано числом, стоящим в треугольнике, представляющем тело этого нейрона. Формула, написанная под сетью, выражает в логической символике, что нейрон Р возбужден в момент t тогда и только тогда, когда все J, К, L возбуждены, но ни один из нейронов М и N не возбужден, в момент t-1. Мы пишем "P(t)" для указания, что нейрон Р возбужден в момент t; "J(t-1)" - для указания, что J возбужден в момент t-1, и т.д. Символ "=" означает "в том и только в том случае, если (или "эквивалентно"), "&" означает "и", "V" означает "или" (в неразделительном смысле), а "черта сверху" означает "не".

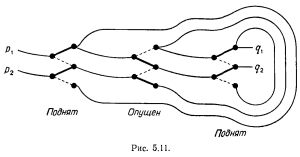

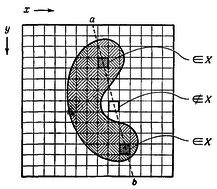

#4. ВХОД НЕРВНОЙ СЕТИ

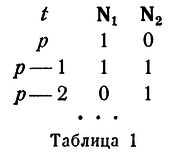

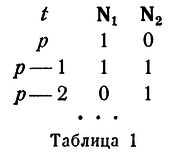

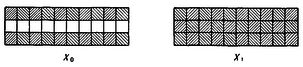

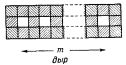

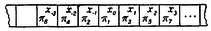

Рассмотрим нервную сеть с k входными нейронами N1, ..., Nk. До пункта 6.3 мы будем считать, что k>=1. ВХОД (или ОПЫТ) всего прошлого до настоящего момента включительно можно описать таблицей с k столбцами, соответствующими входным нейронам, и строками, соответствующими моментам, отсчитываемым в обратном порядке от данного момента р) [Обозначение р от present - настоящее.- Прим. ред.]. Пересечения строк и столбцов заполняются нулями и единицами, причем 0 означает, что данный нейрон не возбужден, а 1 - что он возбужден в данный момент времени.

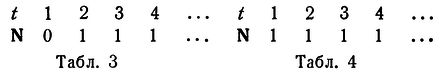

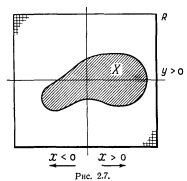

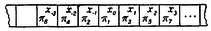

Например, при k = 2 таблица может иметь вид:

Цифра 1 в первой строке и первом столбце означает, что N1 возбужден в момент р; 0 в третьей строке и первом столбце - что N1 не возбужден в момент р-2, и т.д. Если эту таблицу продолжить вниз до бесконечности, мы получим представление опыта, мыслимого распространенным на все прошедшее время, которое мы считаем до настоящего момента бесконечным (в разделе 6 мы вернемся к рассмотрению этого вопроса).

Под СОБЫТИЕМ мы будем понимать любое свойство входа. Другими словами, любой подкласс класса всех возможных таблиц, описывающих вход всего прошлого (включая, если не оговорено противное, настоящий момент p), образует событие, которое НАСТУПАЕТ, если таблица, описывающая данный вход, принадлежит этому подклассу.

Примерами событий с двумя входными нейронами N1 и N2 являются:

(1) N1 возбужден в момент p.

(2) N2 не возбужден в момент p, a N1 возбужден в момент р-1.

(3) Один из нейронов, N1 или N2, возбужден в момент р.

(4) N1 и N2 оба возбуждены в момент р.

(5) N2 был возбужден в некоторый момент.

(6) N2 был возбужден в каждый момент, за исключением p.

В этих примерах вход, описанный табл.1, представляет наступление событий (1), (2), (3) и (5), но не (4), а для того, чтобы сказать, представляет ли он наступление события (6), мы должны знать продолжение таблицы.

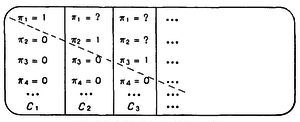

#5. ОПРЕДЕЛЕННЫЕ СОБЫТИЯ

#5.1. ОПРЕДЕЛЕНИЕ "ОПРЕДЕЛЕННЫХ СОБЫТИЙ". Мы рассмотрим сначала события, которые относятся к фиксированному периоду времени, состоящему из некоторого числа l (>=1) последовательных моментов р-l+1, ..., p, оканчивающихся настоящим моментом. Мы будем называть такие события определенными событиями ДЛИНЫ (или ДЛИТЕЛЬНОСТИ) l. Среди предыдущих примеров определенными являются события (1)-(4), но не (5) и (6).

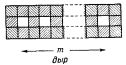

При этом в таблице такого вида, как табл.1, нам надо рассматривать только верхние l строк; например, при l=3 таблица 1 описывает событие, которое описывается также формулой

N1(p)&~N2(p) & N1(p-1)&N2(p-l) & ~N1(p-2)&N2(p-2).

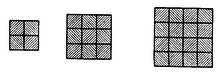

Таблица, описывающая вход с k нейронами для l моментов р-l+1, ..., p, имеет ровно kl мест. Следовательно, возможно ровно 2**(kl) таких таблиц. Следовательно, имеется ровно 2**2**(kl) определенных событий длины с k входными нейронами, так как каждое из них определяется указанием того, какие из входов, описанных 2**(kl) k*l-таблицами, должны давать наступление события.

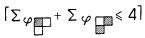

Определенное событие мы будем называть ПОЗИТИВНЫМ, если оно наступает только в том случае, когда хотя бы один из входных нейронов оказывается возбужденным хотя бы в один из моментов в продолжение периода, к которому это событие относится. Имеется ровно 2**(2**(kl)-1) позитивных определенных событий длины l с k входными нейронами, так как такие события определяются тем условием, что вход, описанный таблицей из одних нулей, не дает наступления события). [Эти выкладки показывают, что автор включает невозможное событие (т.е. событие, состоящее из пустого множества таблиц) в число позитивных, а значит, в частности, в число определенных событий.- Прим, ред.]

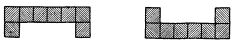

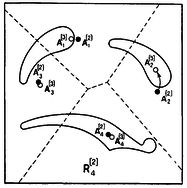

#5.2. ПРЕДСТАВИМОСТЬ ОПРЕДЕЛЕННЫХ СОБЫТИЙ. ИЛЛЮСТРАЦИЯ. Рассмотрим определенное событие, которое наступает, когда конфигурация возбуждений совпадает с табл.1 (оборванной на трех строках) или с табл.2.

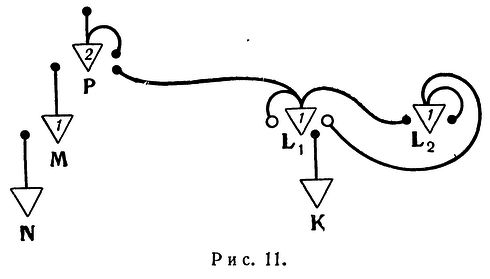

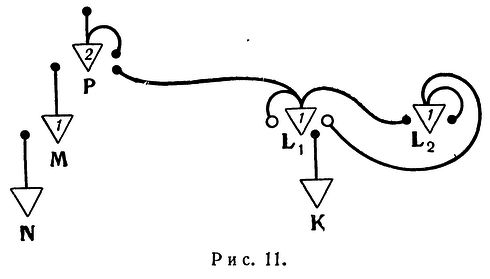

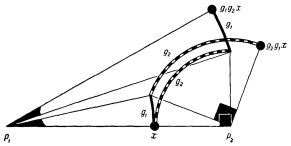

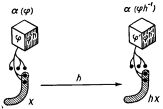

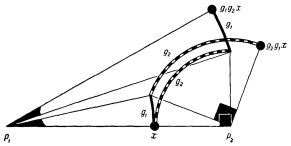

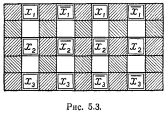

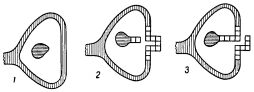

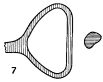

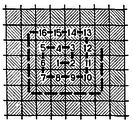

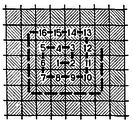

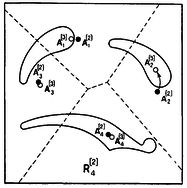

Это означает, что именно эти две (из 2**(2*3)=64) 2*3-таблицы, и только они, должны давать наступление события. Это событие описывается правой частью эквивалентности рис.5, получающейся путем дизъюнктивного сочетания конъюнкций, описывающих соответствующие таблицы в отдельности. В нервной сети рис.5 нейрон Р возбужден в момент p+2 в том и только в том случае, если наступает рассматриваемое событие, оканчивающееся в момент р, или, короче, сеть представляет это событие путем возбуждения нейрона Р с ЗАПАЗДЫВАНИЕМ 2. Нейроны N1, N'1, N''1 с указанными соединяющими их аксонами образуют "сеть задержки" (см. рис.4). Синапс нейрона M1, имеющий на себе шесть концевых пластинок, является "конъюнктивной сетью" (см. рис.1). Синапс нейрона Р является "дизъюнктивной сетью" (см. рис.3).

Метод этой иллюстрации применим к любому позитивному определенному событию, которое наступает для одной или нескольких таблиц.

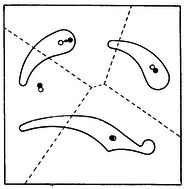

Остается случай события, которое никогда не наступает. Этот случай представлен возбуждением нейрона Р, например с запаздыванием равным 2, в сети рис.6. Нейрон М2 вставлен с целью показать, что сеть можно выбрать связной (в очевидном смысле): иначе М2 можно опустить, тогда М1 совпадет с Р.

Мы, таким образом, уже доказали, что всякое позитивное определенное событие представимо посредством возбуждения нейрона с запаздыванием 2. Однако мы дадим ниже более гибкое рассуждение, в котором этот результат окажется частью следствия 1 теоремы 1.

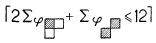

#5.3. ПРЕДСТАВИМОСТЬ ОПРЕДЕЛЕННЫХ СОБЫТИЙ: ОБЩАЯ ТЕОРИЯ. Мы рассмотрим логические выражения, построенные с юмощью & и V из выражений, символизирующих возбужденность или невозбужденность одного из k входных нейронов N1, ..., Nk в один из l моментов р-l+1, ..., р. Такое выражение мы будем называть kl-ФОРМУЛОЙ и будем называть ее ГЛУБИНОЙ наибольшее число раз, которое знаки & или V используются последовательно в ее построении. При этом допускается любой способ расстановки скобок в конъюнкциях и дизъюнкциях, содержащих более двух членов; например

[[N1(р) & ~N2(p)] & N2(p-1)] V ~N1(p)

в таком виде имеет глубину 3, но эту формулу можно переписать в виде

[N1(p) & ~N2(p) & N2(p-1)] V ~N1(p)

с глубиной 2.

Эти определения можно следующим образом уточнить с помощью математической индукции по s:

1) Для каждых i и j (i=1,...,k; j=1,...,l) Ni(p-j+1) и ~Ni(p-j+1) являются kl-ФОРМУЛАМИ

ГЛУБИНЫ 0.

2) При s>0, если G1, ..., Gn(n>=2) - kl-формулы глубины <s и хотя бы одна из них имеет глубину s-1, то G1&...&Gn и G1V...VGn являются kl-ФОРМУЛАМИ ГЛУБИНЫ s (здесь каждое Ge глубины, отличной от 0, надлежит при записывании заключать в скобки).

Так как истинность или ложность kl-формулы F определяется логически только истинностью или ложностью формул Ni(p-j+1), входящих в нее в качестве ЭЛЕМЕНТАРНЫХ КОМПОНЕНТ, то каждая F выражает определенное событие E длины l с k входными нейронами.

Мы не теряем ничего существенного из-за того, что применяем символ ~ отрицания только непосредственно к элементарным компонентам. В самом деле, с помощью многократного применения логических тождеств

~~G = G

~(G1&...&Gn)=~G1V...V~Gn

~(G1V...VGn)=~G1&...&~Gn

символы отрицания, использованные другим способом, можно сдвинуть внутрь так, что они окажутся над элементарными компонентами и глубина формулы при этом не изменится. Две другие операции, обычно применяемые в двузначном исчислении высказываний, а именно -> (ВЛЕЧЕТ) и =, могут быть выражены в терминах ~, & и V следующим образом:

G->H = ~G V Н,

(G=H) = (G->H) & (H->G).

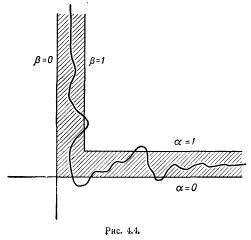

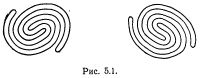

ПЕТЛЕЙ (ДЛИНЫ c) в нервной сети называется множество различных нейронов N1, ..., Nc (с>=1), таких, что Ni имеет концевую пластинку на N[i+1] для каждого i (i=1,...,c-1), a Nc имеет концевую пластинку на N1. Сети, рассмотренные нами до сих пор, в том числе конъюнктивная и дизъюнктивная сети и сеть задержки (см. рис.1, 3 и 4) и некоторые сети, составленные из них, не имеют петель.

ТЕОРЕМА 1. Пусть F - любая kl-формула глубины s и пусть Е - определенное событие длины l с k входными нейронами, выражаемое формулой F. Тогда имеется нервная сеть, структура которой соответствует F (и поэтому эта нервная сеть не имеет петель), причем эта сеть представляет E посредством возбужденности или невозбужденности (смотря по тому, позитивно или непозитивно E) некоторого нейрона P (внутреннего при s>0) в момент p+s.

Утверждение "структура нервной сети соответствует F" означает, что эта сеть составлена из конъюнктивных и дизъюнктивных сетей (а также сетей задержки), соответствующих, как будет указано в доказательстве, операциям, использованным при построении F.

ДОКАЗАТЕЛЬСТВО ИНДУКЦИЕЙ ПО s. По нашему определению kl-формулы, не обязательно все символы Ni (i=1,...,k) встречаются в F. Излагая индуктивное построение сети, соответствующей логической структуре F, мы будем принимать во внимание только те нейроны Ni, для которых Ni встречается в F. Остальные нейроны можно считать входящими фиктивно или же их можно связать с остальной цепью. При s>1 это можно сделать, например, так, как показано для N2 на рис.6.

БАЗИС: s=0. Тогда F есть Ni(p-j+1), или ~Ni(p-j+1) для некоторых i и j. Тогда Ni есть P, если j=1; если же j>1, то P есть нейрон, соединенный с Ni посредством надлежащей сети задержки (см. рис.4).

ИНДУКЦИОННЫЙ ШАГ: s>0. Тогда F есть G1&...&Gn или G1V...VGn. Для e= 1,...,n пусть Me будет Ge или ~Ge, в соответствии с тем, позитивно или нет событие, описанное посредством Ge. Тогда Ge (глубины se<s) эквивалентна Me или ~Me соответственно, и по индуктивному предположению имеется нервная сеть с нейроном Ge, возбужденность или, соответственно, невозбужденность которого в момент p+se представляет Ge. Далее мы получаем нейрон Me, возбужденность которого в момент p+s-1 представляет Me; этот нейрон Me есть сам Ge, если se=s-1, а в противном же случае Me получается из Ge при помощи надлежащей сети задержки. Теперь возможны четыре случая построения F из M1,...,Mn согласно построению F из

G1,...,Gn и эквивалентности каждой Ge одной из Me и ~Me.

СЛУЧАЙ 1. Конъюнкция, содержащая хоть один неотрицаемый сомножитель, например M1&M2&M3&~M4&~M5. В случае событие позитивно, значит, нам надлежит представить его возбуждением некоторого нейрона P в момент p+s. Конъюнктивная сеть (см. рис.1) дает нам этот нейрон.

СЛУЧАЙ 2. Конъюнкция, содержащая только отрицаемые сомножители, например ~M1&~M2&~M3. В этом случае событие непозитивно. Но его отрицание ~(~M1&~M2&~M3) позитивно. Оно эквивалентно М1VМ2VM3. Последнее представляется дизъюнктивной сетью (см. рис.3) с нейроном Р, возбужденным в момент p+s; полученная сеть представляет данное событие невозбуждением в момент p+s нейрона Р, как мы и хотели его представить.

СЛУЧАЙ 3. Дизъюнкция, содержащая по крайней мере oдин отрицаемый член, например ~M1V~M2V~M3VM4VM5. В этом случае событие непозитивно. Но его отрицание позитивно и эквивалентно M1&M2&M3&~M4&~M5. Конъюнктивная сеть представляет это событие возбуждением в момент p+s нейрона Р; данное событие представляется невозбуждением нейрона Р в момент p+s.

СЛУЧАЙ 4. Дизъюнкция, содержащая только неотрицаемые члены, например M1VM2VM3VM4VM5. Событие позитивно. Дизъюнктивная сеть представляет это событие, как и требуется, возбуждением в момент p+s нейрона Р.

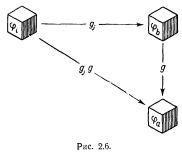

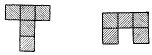

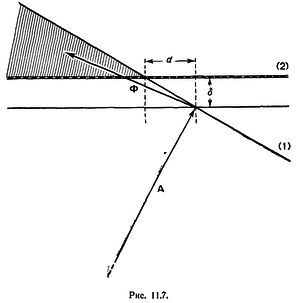

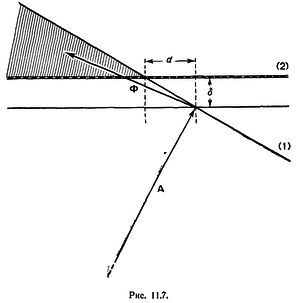

ПРИМЕРЫ. Сеть рис.5 получена применением только что изложенного метода к написанной под рис.5 формуле. Другой пример дает рис.7. Рассмотрение трех формул N1(p)VN2(p)VN3(p), N1(p)V~N2(p)V~N3(p) и ~N1(p)VN2(p)VN3(p) дает нам соответственно нейроны М1, М2 и М3, которые представляют выражаемые этими формулами события; для первой формулы, когда событие позитивно,- возбуждением (случай 4), а для второй и третьей, когда событие непозитивно,- невозбуждением (случай 3) в момент p+1. Bee событие позитивно, и полученный нейрон Р представляет его, как и следует, возбуждением в момент p+2 (случай 1).

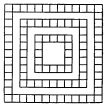

СЛЕДСТВИЕ 1. Для каждого позитивного (непозитивного) определенного события имеется нервная сеть без петель, которая представляет это событие возбуждением (невозбуждением) некоторого внутреннего нейрона в момент p+2.

Этот результат был высказан (для позитивных событий и без замечания о запаздывании) Мак-Каллоком и Питтсом [1943].

ДОКАЗАТЕЛЬСТВО. Чтобы получить это следствие из теоремы, достаточно заметить, что метод пункта 5.2 дает kl-формулу глубины <=2 для каждого определенного события длины l с k входными нейронами. (Если глубина <2, то с помощью задержки можно довести запаздывание до 2).

КОММЕНТАРИЙ. Читатель, знакомый с символической логикой, узнает в полученной таким образом [Подразумевается метод пункта 5.2.- Прим. ред.] kl-формуле СОВЕРШЕННУЮ ДИЗЪЮНКТИВНУЮ НОРМАЛЬНУЮ ФОРМУ (с.д.н.ф.) Гильберта и Аккермана [1928]. Она "совершенна" потому, что в каждом из ее членов встречается, отрицаемый или нет, любой из сомножителей N1(p),..., Nk(p-l+1) (за исключением случая, представленного на рис.6).

Формула рис.7 является СОВЕРШЕННОЙ КОНЪЮНКТИВНОЙ НОРМАЛЬНОЙ ФОРМОЙ (с.к.н.ф.). Если с.д.н.ф. имеет n<2**(kl) членов, то с.к.н.ф. имеет 2**(kl)-n сомножителей (с.к.н.ф. получается вычислением отрицания с.д.н.ф. отрицания события).

Использование с.д.н.ф. упрощает доказательство представимости (см. 5.2) и дает результатом, что запаздывание можно свести к 2, но построенная при этом сеть может оказаться излишне усложненной. Событие может допускать более простое описание при помощи дизъюнктивной или конъюнктивной нормальной формы, не являющейся совершенной (причем запаздывание все еще может быть сделано <=2). Например (при k=2, l=3), [~N2(p)&N2(p-2)]VN2(p-1) есть д.н.ф., для которой с.д.н.ф. будет иметь 40 членов (а с.к.н.ф. 24 множителя). Могут иметься более простые эквиваленты, не являющиеся дизъюнктивной или конъюнктивной нормальными формами.

Ввиду того что теорема 1 дает представляющую сеть со структурой, соответствующей формуле, задача нахождения возможно более простых сетей для представления определенных событий связана с задачей нахождения наиболее простых эквивалентов выражений исчисления высказываний, которая недавно рассматривалась Куайном [1952].

В специальных случаях удается построить сеть, имеющую более простую структуру, чем та, которая соответствует формуле; например, если в рис.2 положить p=t-1, то сеть будет представлять событие с запаздыванием 1, хотя формула имеет глубину 3 и не существует никакой эквивалентной формулы глубины 1.

Сведение запаздывания к числу, меньшему 2, в общем случае невозможно. Например (при k=3, l=1), событие N1(p)&[~N2(p)V~N3(p)] не представимо с задержкой 1. В самом деле, легко видеть, что никакая сеть, состоящая из нейрона Р, возбуждаемого только концевыми пластинками, принадлежащими непосредственно нейронам N1, N2 и N3, не может представлять это событие.

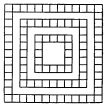

Для сведения запаздывания к 2 может оказаться необходимым очень большое число концевых пластинок, исходящих из данного тела или соприкасающихся с ним.

СЛЕДСТВИЕ 2. Для каждого позитивного (непозитивного) определенного события имеется число s и нервная сеть без петель, каждый из нейронов которой имеет не более двух концевых пластинок и возбуждается не более чем двумя концевыми пластинками и имеет порог не более 2, представляющая это событие возбуждением (невозбуждением) некоторого нейрона в момент p+s.

ДОКАЗАТЕЛЬСТВО. Если в kl-формуле пользоваться символами & и V только как бинарными операциями, то в построенной согласно теореме сети ни один нейрон не будет юзбуждаться более чем двумя концевыми пластинками. Каждый внутренний нейрон, не входящий в сеть задержки, имеет только одну концевую пластинку. Каждый входной нейрон и сеть задержки можно при необходимости заменить (с увеличением запаздывания) "деревом" нейронов, каждый из соторых имеет не более двух концевых пластинок.

До сих пор мы рассматривали представление события, оканчивающегося в момент p, посредством возбуждения или невозбуждения некоторого нейрона в некоторый момент p+s (s>=0). Более общим образом можно рассматривать представление посредством свойства состояния сети (т.е. посредством возбуждения или невозбуждения каждого из ее нейронов) в момент p+s, т.е. состояние сети должно обладать или не обладать этим свойством в момент p+s в соответствии с тем, наступает или нет событие в момент р. В следующих лемме и следствии событие не предполагается определенным, а сеть - не имеющей петель.

ЛЕММА 1. Событие, представимое в нервной сети свойством состояния в момент p+s для данного s>0, представимо и свойством состояния той же самой сети в момент р.

ДОКАЗАТЕЛЬСТВО. Все, что происходит в моменты <=p, может влиять на состояние сети в момент p+s только посредством состояния всей сети, в том числе состояния k входных и всех, скажем m, внутренних нейронов в момент р.

СЛЕДСТВИЕ 3. Событие, представимое в нервной сети свойством состояния в момент p+s для данного s>=0, представимо также возбуждением или не возбуждением (в зависимости от природы этого свойства) некоторого внутреннего нейрона подходящей сети в момент р+2.

ДОКАЗАТЕЛЬСТВО. С целью применить следствие 1 будем рассматривать все k+m нейронов как входные. По лемме 1, рассматриваемое свойство эквивалентно некоторому свойству k+m нейронов в момент p. Последнее образует определенное событие длины 1 с k+m нейронами.

#5.4. НЕРВНЫЕ СЕТИ БЕЗ ПЕТЕЛЬ

ТЕОРЕМА 2. Для любой данной нервной сети без петель и любого данного внутреннего нейрона N этой сети возбужденность (невозбужденность) этого нейрона в момент р+1 эквивалентна наступлению некоторого позитивного (непозитивного) определенного события.

Эта теорема была высказана (для позитивных событий) Мак-Каллоком и Питтсом [1943].

ДОКАЗАТЕЛЬСТВО. Возбуждение или невозбуждение нейрона N в момент р+1 определяется полностью состоянием (возбужденностью или невозбужденностью) в момент p тех нейронов N'1,...,N'r, которые имеют концевые пластинки на N. Рассмотрим те из нейронов N'1,...,N'r, которые являются внутренними, и повторим это рассуждение. Так как петель нет, то любая начинающаяся с N цепь нейронов, каждый член которой возбуждается концевой пластинкой следующего члена, должна обрываться (на входном нейроне). Пусть l+1 - наибольшая из длин этих цепей; так как N - внутренний нейрон, то l>=1. После l шагов не остается подлежащих рассмотрению внутренних нейронов. Таким образом, возбужденность или невозбужденность нейрона N в момент р+1 полностью определяется состоянием некоторых входных нейронов в некоторые моменты между р-l+1 и р включительно, т.е. возбужденность N в момент р эквивалентна определенному событию длины l. Это событие позитивно, так как для внутренних нейронов возбуждение может только распространяться, но не порождаться.

ЗАМЕЧАНИЕ. Любое определенное событие выразимо логической формулой, например совершенной дизъюнктивной нормальной формой, как в 5.2. Таким образом, a priori имеется формула, выражающая событие теоремы 2. Используя условия для возбужденности на каждом синапсе, которые можно выразить логическими символами через пороги и числа и виды концевых пластинок (ср. рис.1-3 для нескольких рассмотренных примеров), можно построить формулу с помощью как раз l шагов, как указывают Мак-Каллок и Питтс.

СЛЕДСТВИЕ 1. Любое событие, представимое в нервной сети без петель возбужденностью (невозбужденностью) некоторого данного внутреннего нейрона N в момент p+s для некоторого данного s>=1, является позитивным (непозитивным) определенным.

ДОКАЗАТЕЛЬСТВО. Согласно теореме 2, возбужденность нейрона N в момент p+s эквивалентна наступлению некоторого позитивного определенного события, оканчивающегося в момент p+s-1. Но по условию возбуждение нейрона N в момент р+s представляет некоторое событие, подразумевается оканчивающееся в момент р (см. раздел 4), поэтому вход в моменты р+1,...,p+s-1 не оказывает влияния на возбужденность или невозбужденность N в момент p+s.

СЛЕДСТВИЕ 2. Любое событие, представимое в нервной сети без петель свойством состояния в момент p+s для данного s>=0, является определенным.

ДОКАЗАТЕЛЬСТВО. В силу следствия 1 и следствия 3 из теоремы 1 (это следствие не вводит петель).

#3. НЕРВНЫЕ СЕТИ МАК-КАЛЛОКА-ПИТТСА

По допущениям Мак-Каллока и Питтса [1943], нервная клетка, или нейрон, состоит из тела (сомы), откуда нервные волокна (аксоны) ведут к одной или нескольким концевым пластинкам.

Нервная сеть является устройством из конечного числа нейронов, в котором каждая концевая пластинка любого нейрона соприкасается с телом не более чем одного нейрона (того же самого или другого), который она возбуждает; разделяющий промежуток называется синапсом. Каждая концевая пластинка является возбуждающей или тормозящей (и не может быть возбуждающей и тормозящей одновременно).

Мы будем называть нейроны, к которым не примыкают никакие концевые пластинки, входными нейронами (число их может равняться нулю); остальные нейроны мы будем называть внутренними.

В равноотстоящие моменты времени (которые мы будем рассматривать как целые числа на временной шкале, одни и те же для всех нейронов данной сети) каждый нейрон сети является возбужденным или невозбужденным (спокойным). Для входного нейрона возбужденность или невозбужденность в любой момент t определяется условиями, внешними по отношению к сети. Можно предположить, что к каждому из них примыкает чувственно воспринимающий орган, который при надлежащих условиях в окружающей среде вызывает возбуждение нейрона в момент t. Для внутреннего нейрона условие возбужденности в момент t состоит в том, что по меньшей мере h (h называется порогом этого нейрона) возбуждающих концевых пластинок действуют, а ни одна из тормозящих не действует в момент t-1).

Для иллюстрации рассмотрим нервную сеть, показанную на рис.1, с входными нейронами J, К, L, М, N и внутренним нейроном Р. Возбуждающие концевые пластинки изображены жирными точками, а тормозящие - кружками. Порог Р равен 3, что указано числом, стоящим в треугольнике, представляющем тело этого нейрона. Формула, написанная под сетью, выражает в логической символике, что нейрон Р возбужден в момент t тогда и только тогда, когда все J, К, L возбуждены, но ни один из нейронов М и N не возбужден, в момент t-1. Мы пишем "P(t)" для указания, что нейрон Р возбужден в момент t; "J(t-1)" - для указания, что J возбужден в момент t-1, и т.д. Символ "=" означает "в том и только в том случае, если (или "эквивалентно"), "&" означает "и", "V" означает "или" (в неразделительном смысле), а "черта сверху" означает "не".

#4. ВХОД НЕРВНОЙ СЕТИ

Рассмотрим нервную сеть с k входными нейронами N1, ..., Nk. До пункта 6.3 мы будем считать, что k>=1. ВХОД (или ОПЫТ) всего прошлого до настоящего момента включительно можно описать таблицей с k столбцами, соответствующими входным нейронам, и строками, соответствующими моментам, отсчитываемым в обратном порядке от данного момента р) [Обозначение р от present - настоящее.- Прим. ред.]. Пересечения строк и столбцов заполняются нулями и единицами, причем 0 означает, что данный нейрон не возбужден, а 1 - что он возбужден в данный момент времени.

Например, при k = 2 таблица может иметь вид:

Цифра 1 в первой строке и первом столбце означает, что N1 возбужден в момент р; 0 в третьей строке и первом столбце - что N1 не возбужден в момент р-2, и т.д. Если эту таблицу продолжить вниз до бесконечности, мы получим представление опыта, мыслимого распространенным на все прошедшее время, которое мы считаем до настоящего момента бесконечным (в разделе 6 мы вернемся к рассмотрению этого вопроса).

Под СОБЫТИЕМ мы будем понимать любое свойство входа. Другими словами, любой подкласс класса всех возможных таблиц, описывающих вход всего прошлого (включая, если не оговорено противное, настоящий момент p), образует событие, которое НАСТУПАЕТ, если таблица, описывающая данный вход, принадлежит этому подклассу.

Примерами событий с двумя входными нейронами N1 и N2 являются:

(1) N1 возбужден в момент p.

(2) N2 не возбужден в момент p, a N1 возбужден в момент р-1.

(3) Один из нейронов, N1 или N2, возбужден в момент р.

(4) N1 и N2 оба возбуждены в момент р.

(5) N2 был возбужден в некоторый момент.

(6) N2 был возбужден в каждый момент, за исключением p.

В этих примерах вход, описанный табл.1, представляет наступление событий (1), (2), (3) и (5), но не (4), а для того, чтобы сказать, представляет ли он наступление события (6), мы должны знать продолжение таблицы.

#5. ОПРЕДЕЛЕННЫЕ СОБЫТИЯ

#5.1. ОПРЕДЕЛЕНИЕ "ОПРЕДЕЛЕННЫХ СОБЫТИЙ". Мы рассмотрим сначала события, которые относятся к фиксированному периоду времени, состоящему из некоторого числа l (>=1) последовательных моментов р-l+1, ..., p, оканчивающихся настоящим моментом. Мы будем называть такие события определенными событиями ДЛИНЫ (или ДЛИТЕЛЬНОСТИ) l. Среди предыдущих примеров определенными являются события (1)-(4), но не (5) и (6).

При этом в таблице такого вида, как табл.1, нам надо рассматривать только верхние l строк; например, при l=3 таблица 1 описывает событие, которое описывается также формулой

N1(p)&~N2(p) & N1(p-1)&N2(p-l) & ~N1(p-2)&N2(p-2).

Таблица, описывающая вход с k нейронами для l моментов р-l+1, ..., p, имеет ровно kl мест. Следовательно, возможно ровно 2**(kl) таких таблиц. Следовательно, имеется ровно 2**2**(kl) определенных событий длины с k входными нейронами, так как каждое из них определяется указанием того, какие из входов, описанных 2**(kl) k*l-таблицами, должны давать наступление события.

Определенное событие мы будем называть ПОЗИТИВНЫМ, если оно наступает только в том случае, когда хотя бы один из входных нейронов оказывается возбужденным хотя бы в один из моментов в продолжение периода, к которому это событие относится. Имеется ровно 2**(2**(kl)-1) позитивных определенных событий длины l с k входными нейронами, так как такие события определяются тем условием, что вход, описанный таблицей из одних нулей, не дает наступления события). [Эти выкладки показывают, что автор включает невозможное событие (т.е. событие, состоящее из пустого множества таблиц) в число позитивных, а значит, в частности, в число определенных событий.- Прим, ред.]

#5.2. ПРЕДСТАВИМОСТЬ ОПРЕДЕЛЕННЫХ СОБЫТИЙ. ИЛЛЮСТРАЦИЯ. Рассмотрим определенное событие, которое наступает, когда конфигурация возбуждений совпадает с табл.1 (оборванной на трех строках) или с табл.2.

Это означает, что именно эти две (из 2**(2*3)=64) 2*3-таблицы, и только они, должны давать наступление события. Это событие описывается правой частью эквивалентности рис.5, получающейся путем дизъюнктивного сочетания конъюнкций, описывающих соответствующие таблицы в отдельности. В нервной сети рис.5 нейрон Р возбужден в момент p+2 в том и только в том случае, если наступает рассматриваемое событие, оканчивающееся в момент р, или, короче, сеть представляет это событие путем возбуждения нейрона Р с ЗАПАЗДЫВАНИЕМ 2. Нейроны N1, N'1, N''1 с указанными соединяющими их аксонами образуют "сеть задержки" (см. рис.4). Синапс нейрона M1, имеющий на себе шесть концевых пластинок, является "конъюнктивной сетью" (см. рис.1). Синапс нейрона Р является "дизъюнктивной сетью" (см. рис.3).

Метод этой иллюстрации применим к любому позитивному определенному событию, которое наступает для одной или нескольких таблиц.

Остается случай события, которое никогда не наступает. Этот случай представлен возбуждением нейрона Р, например с запаздыванием равным 2, в сети рис.6. Нейрон М2 вставлен с целью показать, что сеть можно выбрать связной (в очевидном смысле): иначе М2 можно опустить, тогда М1 совпадет с Р.

Мы, таким образом, уже доказали, что всякое позитивное определенное событие представимо посредством возбуждения нейрона с запаздыванием 2. Однако мы дадим ниже более гибкое рассуждение, в котором этот результат окажется частью следствия 1 теоремы 1.

#5.3. ПРЕДСТАВИМОСТЬ ОПРЕДЕЛЕННЫХ СОБЫТИЙ: ОБЩАЯ ТЕОРИЯ. Мы рассмотрим логические выражения, построенные с юмощью & и V из выражений, символизирующих возбужденность или невозбужденность одного из k входных нейронов N1, ..., Nk в один из l моментов р-l+1, ..., р. Такое выражение мы будем называть kl-ФОРМУЛОЙ и будем называть ее ГЛУБИНОЙ наибольшее число раз, которое знаки & или V используются последовательно в ее построении. При этом допускается любой способ расстановки скобок в конъюнкциях и дизъюнкциях, содержащих более двух членов; например

[[N1(р) & ~N2(p)] & N2(p-1)] V ~N1(p)

в таком виде имеет глубину 3, но эту формулу можно переписать в виде

[N1(p) & ~N2(p) & N2(p-1)] V ~N1(p)

с глубиной 2.

Эти определения можно следующим образом уточнить с помощью математической индукции по s:

1) Для каждых i и j (i=1,...,k; j=1,...,l) Ni(p-j+1) и ~Ni(p-j+1) являются kl-ФОРМУЛАМИ

ГЛУБИНЫ 0.

2) При s>0, если G1, ..., Gn(n>=2) - kl-формулы глубины <s и хотя бы одна из них имеет глубину s-1, то G1&...&Gn и G1V...VGn являются kl-ФОРМУЛАМИ ГЛУБИНЫ s (здесь каждое Ge глубины, отличной от 0, надлежит при записывании заключать в скобки).

Так как истинность или ложность kl-формулы F определяется логически только истинностью или ложностью формул Ni(p-j+1), входящих в нее в качестве ЭЛЕМЕНТАРНЫХ КОМПОНЕНТ, то каждая F выражает определенное событие E длины l с k входными нейронами.

Мы не теряем ничего существенного из-за того, что применяем символ ~ отрицания только непосредственно к элементарным компонентам. В самом деле, с помощью многократного применения логических тождеств

~~G = G

~(G1&...&Gn)=~G1V...V~Gn

~(G1V...VGn)=~G1&...&~Gn

символы отрицания, использованные другим способом, можно сдвинуть внутрь так, что они окажутся над элементарными компонентами и глубина формулы при этом не изменится. Две другие операции, обычно применяемые в двузначном исчислении высказываний, а именно -> (ВЛЕЧЕТ) и =, могут быть выражены в терминах ~, & и V следующим образом:

G->H = ~G V Н,

(G=H) = (G->H) & (H->G).

ПЕТЛЕЙ (ДЛИНЫ c) в нервной сети называется множество различных нейронов N1, ..., Nc (с>=1), таких, что Ni имеет концевую пластинку на N[i+1] для каждого i (i=1,...,c-1), a Nc имеет концевую пластинку на N1. Сети, рассмотренные нами до сих пор, в том числе конъюнктивная и дизъюнктивная сети и сеть задержки (см. рис.1, 3 и 4) и некоторые сети, составленные из них, не имеют петель.

ТЕОРЕМА 1. Пусть F - любая kl-формула глубины s и пусть Е - определенное событие длины l с k входными нейронами, выражаемое формулой F. Тогда имеется нервная сеть, структура которой соответствует F (и поэтому эта нервная сеть не имеет петель), причем эта сеть представляет E посредством возбужденности или невозбужденности (смотря по тому, позитивно или непозитивно E) некоторого нейрона P (внутреннего при s>0) в момент p+s.

Утверждение "структура нервной сети соответствует F" означает, что эта сеть составлена из конъюнктивных и дизъюнктивных сетей (а также сетей задержки), соответствующих, как будет указано в доказательстве, операциям, использованным при построении F.

ДОКАЗАТЕЛЬСТВО ИНДУКЦИЕЙ ПО s. По нашему определению kl-формулы, не обязательно все символы Ni (i=1,...,k) встречаются в F. Излагая индуктивное построение сети, соответствующей логической структуре F, мы будем принимать во внимание только те нейроны Ni, для которых Ni встречается в F. Остальные нейроны можно считать входящими фиктивно или же их можно связать с остальной цепью. При s>1 это можно сделать, например, так, как показано для N2 на рис.6.

БАЗИС: s=0. Тогда F есть Ni(p-j+1), или ~Ni(p-j+1) для некоторых i и j. Тогда Ni есть P, если j=1; если же j>1, то P есть нейрон, соединенный с Ni посредством надлежащей сети задержки (см. рис.4).

ИНДУКЦИОННЫЙ ШАГ: s>0. Тогда F есть G1&...&Gn или G1V...VGn. Для e= 1,...,n пусть Me будет Ge или ~Ge, в соответствии с тем, позитивно или нет событие, описанное посредством Ge. Тогда Ge (глубины se<s) эквивалентна Me или ~Me соответственно, и по индуктивному предположению имеется нервная сеть с нейроном Ge, возбужденность или, соответственно, невозбужденность которого в момент p+se представляет Ge. Далее мы получаем нейрон Me, возбужденность которого в момент p+s-1 представляет Me; этот нейрон Me есть сам Ge, если se=s-1, а в противном же случае Me получается из Ge при помощи надлежащей сети задержки. Теперь возможны четыре случая построения F из M1,...,Mn согласно построению F из

G1,...,Gn и эквивалентности каждой Ge одной из Me и ~Me.

СЛУЧАЙ 1. Конъюнкция, содержащая хоть один неотрицаемый сомножитель, например M1&M2&M3&~M4&~M5. В случае событие позитивно, значит, нам надлежит представить его возбуждением некоторого нейрона P в момент p+s. Конъюнктивная сеть (см. рис.1) дает нам этот нейрон.

СЛУЧАЙ 2. Конъюнкция, содержащая только отрицаемые сомножители, например ~M1&~M2&~M3. В этом случае событие непозитивно. Но его отрицание ~(~M1&~M2&~M3) позитивно. Оно эквивалентно М1VМ2VM3. Последнее представляется дизъюнктивной сетью (см. рис.3) с нейроном Р, возбужденным в момент p+s; полученная сеть представляет данное событие невозбуждением в момент p+s нейрона Р, как мы и хотели его представить.

СЛУЧАЙ 3. Дизъюнкция, содержащая по крайней мере oдин отрицаемый член, например ~M1V~M2V~M3VM4VM5. В этом случае событие непозитивно. Но его отрицание позитивно и эквивалентно M1&M2&M3&~M4&~M5. Конъюнктивная сеть представляет это событие возбуждением в момент p+s нейрона Р; данное событие представляется невозбуждением нейрона Р в момент p+s.

СЛУЧАЙ 4. Дизъюнкция, содержащая только неотрицаемые члены, например M1VM2VM3VM4VM5. Событие позитивно. Дизъюнктивная сеть представляет это событие, как и требуется, возбуждением в момент p+s нейрона Р.

ПРИМЕРЫ. Сеть рис.5 получена применением только что изложенного метода к написанной под рис.5 формуле. Другой пример дает рис.7. Рассмотрение трех формул N1(p)VN2(p)VN3(p), N1(p)V~N2(p)V~N3(p) и ~N1(p)VN2(p)VN3(p) дает нам соответственно нейроны М1, М2 и М3, которые представляют выражаемые этими формулами события; для первой формулы, когда событие позитивно,- возбуждением (случай 4), а для второй и третьей, когда событие непозитивно,- невозбуждением (случай 3) в момент p+1. Bee событие позитивно, и полученный нейрон Р представляет его, как и следует, возбуждением в момент p+2 (случай 1).

СЛЕДСТВИЕ 1. Для каждого позитивного (непозитивного) определенного события имеется нервная сеть без петель, которая представляет это событие возбуждением (невозбуждением) некоторого внутреннего нейрона в момент p+2.

Этот результат был высказан (для позитивных событий и без замечания о запаздывании) Мак-Каллоком и Питтсом [1943].

ДОКАЗАТЕЛЬСТВО. Чтобы получить это следствие из теоремы, достаточно заметить, что метод пункта 5.2 дает kl-формулу глубины <=2 для каждого определенного события длины l с k входными нейронами. (Если глубина <2, то с помощью задержки можно довести запаздывание до 2).

КОММЕНТАРИЙ. Читатель, знакомый с символической логикой, узнает в полученной таким образом [Подразумевается метод пункта 5.2.- Прим. ред.] kl-формуле СОВЕРШЕННУЮ ДИЗЪЮНКТИВНУЮ НОРМАЛЬНУЮ ФОРМУ (с.д.н.ф.) Гильберта и Аккермана [1928]. Она "совершенна" потому, что в каждом из ее членов встречается, отрицаемый или нет, любой из сомножителей N1(p),..., Nk(p-l+1) (за исключением случая, представленного на рис.6).