О компиляции Машин Тьюринга

Страница 1 из 1

О компиляции Машин Тьюринга

О компиляции Машин Тьюринга

"К началу 1963г. последними результатами в этом направлении были теорема Ватанабе о существовании универсальной [т.е. способной эмулировать любую другую] машины [Тьюринга] с 5-ю символами и 6-ю состояниями, теорема Минского о существовании машины с 4-мя символами и 7-ю состояниями и теорема Триттера о существовании универсальной машины с 4-мя символами и 6-ю состояниями".

/З.В.Алферова. Теория алгоритмов. 1973/

Для удобства работы на форуме мне понадобилась очень простая машина распаковки баз данных для отображения последних. И я быстренько ее слепил в первой же главе второго тома Заметок, в рамках обсуждения "текстовых игр"

ТЕМА #70, АБЗАЦ #861

ТЕМА #70, АБЗАЦ #861 . Однако случились две неприятности:

. Однако случились две неприятности:1) практические потребности быстро превратили эту утилитку в нечто совершенно не дидактическое, а местами и просто нечитаемое...

2) все было хорошо в терминах UNIX - текстовые потоки, проходящие через простые программы-фильтры, написанные на простейших языках. Но внутри одного исполняемого файла потоки превратились в винегрет совершенно разнородных структур, каждая из которых жила максимум десяток строк.

Поэтому захотелось решить эту задачу несколько более формально.

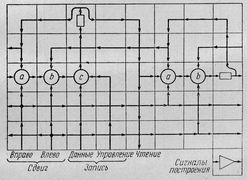

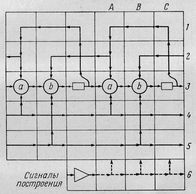

Пусть, мы имеем некоторые "Машины Тьюринга"

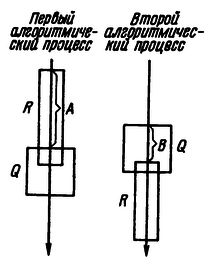

ТЕМА #109, АБЗАЦ #1662

ТЕМА #109, АБЗАЦ #1662 , связанные своими лентами в цепочку. На входе первой - байты файла [базы данных]. На выходе последней - эти же данные, но уже размещенные в памяти программы и готовые к выводу на экран. Для удобства примем направление движения информации слева направо. Выходные ленты одной машины служат входными для других. Объем "промежуточных лент" чрезмерно увеличивать не стоит, достаточно, чтобы туда влезли результат одной операции пишущей машины и входные данные машины читающей (что из них объемнее).

, связанные своими лентами в цепочку. На входе первой - байты файла [базы данных]. На выходе последней - эти же данные, но уже размещенные в памяти программы и готовые к выводу на экран. Для удобства примем направление движения информации слева направо. Выходные ленты одной машины служат входными для других. Объем "промежуточных лент" чрезмерно увеличивать не стоит, достаточно, чтобы туда влезли результат одной операции пишущей машины и входные данные машины читающей (что из них объемнее).(В теории, например, в книжке, что я цитировал вначале, обычно используют другой способ - замещение стартовым состоянием одной машины конечного состояния другой, или той же самой, или ее копии... Но это все не так весело).

Наверное, нужна и вторая связующая цепь "лент", благодаря которой машины будут настраивать друг друга. Это имеет смысл, если сигналы настройки будут идти справа налево - цепь синхронизации. Или это будут некоторые состояния и переходы некой объемлющей Машины?

***

Итак, что эти машины будут делать?

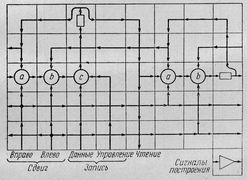

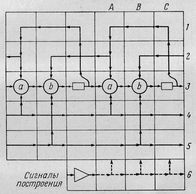

В первом приближении задачу извлечения данных из файла будут решать аж 12 машин:

1. FILE. Получатель файлового буфера. На выходе - все байты файла. Сразу по срабатыванию этой машины становятся доступны все байты файла. Можно брать по одному, выбрать нужный (это используется для различения TXT/GIF форматов) или все разом (длина файла тоже известна).

-----> 2/3/10

2. DOS. Символы из DOS 866 в WIN 1251

-----> 10

3. BLK. Разбиратель буфера на блоки. На выходе - отдельно байты заголовков и пакетов. Готовность машины определяется нахождением курсора (здесь и далее - курсора файла) в начале блока. За исключением 1-го блока, тип (и размер блока) определяется его первым байтом. Остальное - как в первой машине, за исключением только того, что доступны становятся байты не до конца файла, а до конца постоянной части блока.

-----> 4/7

4. PCK. Разбиратель пакетов на байты. На выходе - только информационные байты. Готовность - по нахождению курсора в конце постоянной части блока, имеющего пакеты. Далее - работа в цикле: первый байт - длина пакета, остальные байты - содержимое, доступное подобно машинам 1 и 3. Пакет нулевой длины означает возврат (и готовность машины 3). Отличие доступности байтов от машин 1 и 3 состоит в том, что пакеты не представляют собой законченные единицы информации, а разделены просто по размеру.

-----> 5/10

5. CODE. Вырезатель LZW-кодов из байтов. На выходе - коды вместо байтов. Полученные от машины 4 байты накапливаются по одному со сдвигом в накопителе до получения последовательностей битов нужной длины - кодов. Начальная длина определяется в машине 3. Обрабатываются два специальных кода: перезапуск и конец (возврат к машине 4 и, автоматически, к 3).

6. STR. Распаковщик LZW-кодов в строки. На выходе - байты вместо кодов. Коды по одному прогоняются через декодер, выдавая массивы байтов заранее неизвестной длины.

-----> 10

7. BLKS. Выдаватель блоков и пакетов. На выходе - только информационные байты. Заменяет машины 3 и 4, выдавая блоки и пакеты (вместе с их длинами), как единые массивы байтов.

8. B64. Упаковщик в 64base. На выходе - перекодированные байты. Заменяет тройки байтов перекодированными по таблице base64 четверками. Начальные (остаточные) значения накопителя четверок определяются предыдущими запусками этой машины (с учетом типов блоков, определенных машиной 3). Окончание работы машины 7 вызывает завершение и этой машины (и, возможно, дописывание последней четверки).

9. B64S. Генератор полей. На выходе - строки. В зависимости от типов (и их номеров по порядку) блоков, дописывает накопленные четверки в дерево, с добавлением некоего стандартного обрамления.

-----> 12

10. FILD. Искатель в строках границ полей. На выходе - слова. В зависимости от состояния машины 12, копит поступающие байты в слова, которые будут висеть на дереве по отдельности.

11. FLDS. Собиратель полей. На выходе - строки. Отмечая концы строк, формирует наборы слов, как "суперсимволы", управляющие измененением состояния машины 12.

12. TREE. Добавлятор в дерево. На выходе - узлы дерева. Это тот самый автомат разбора базы данных, который я ввел во второй главе второго тома заметок: "GARBAGE - PATH - HEADER - TEXT - PARAM".

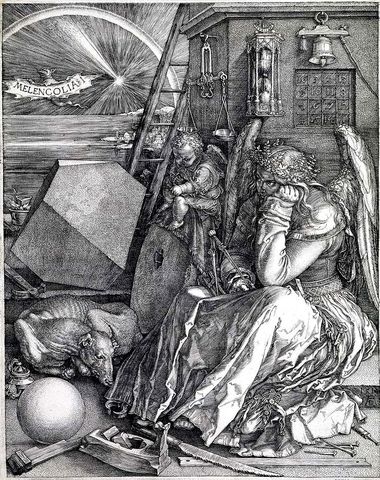

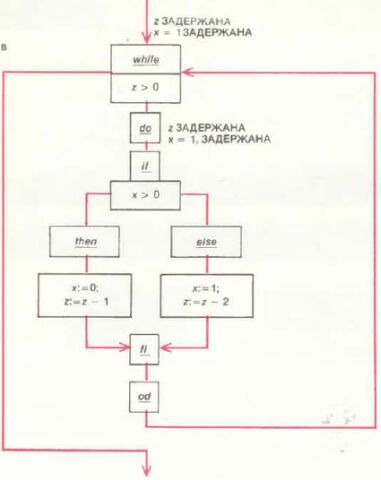

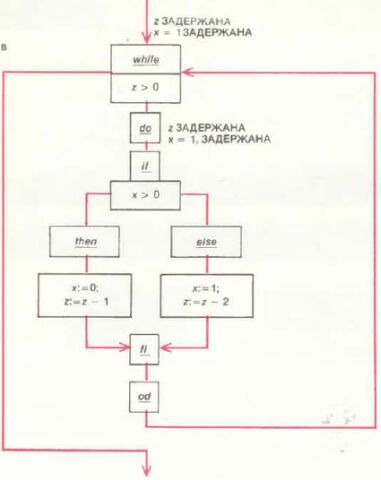

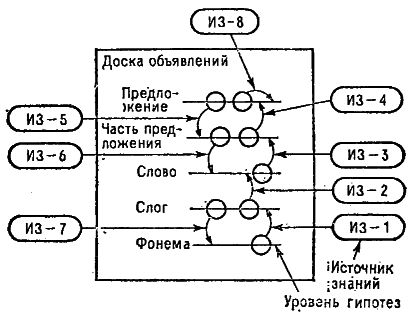

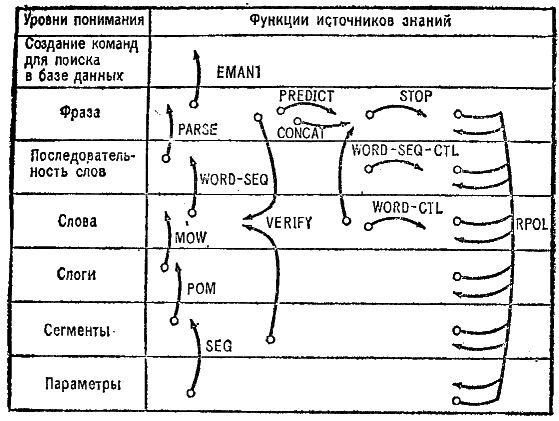

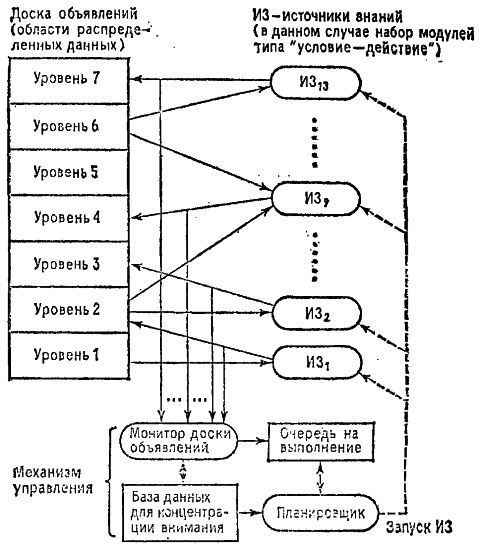

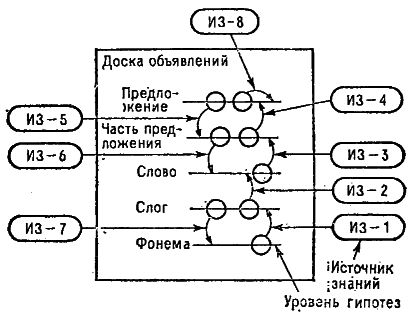

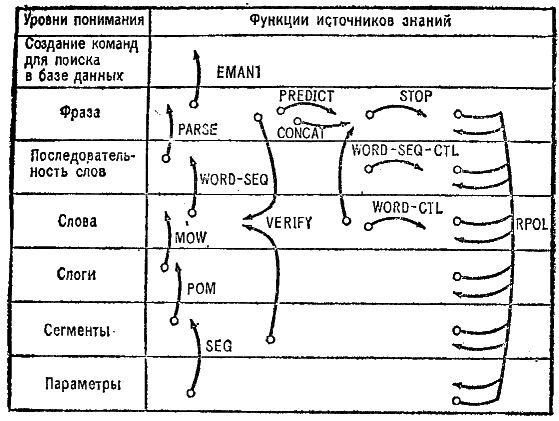

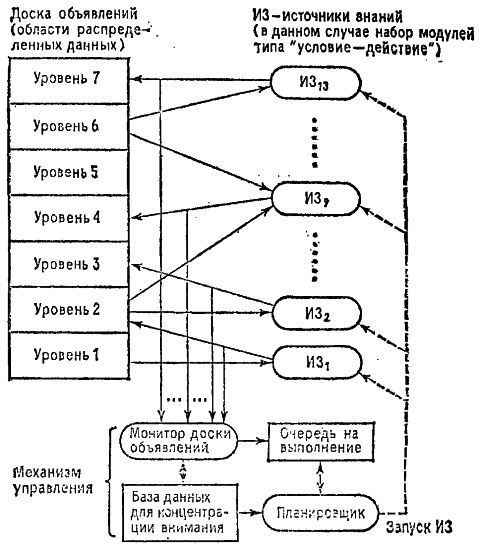

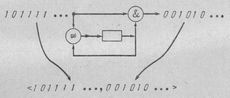

Вся "дорожка" - это файл, который мы читаем побайтно. Каждая клеточка - байт. Т.о. можно пробежать всю дорожку байт за байтом, нигде не задерживаясь. По крайней мере, такая программа будет работать. Но, когда мы доходим до картинки, мы можем ее рассмотреть и прочесть, что надо сделать. Самое хитрое, мы можем "раскрыть" картину, как новое игровое поле, и "сыграть" на нем. Причем, это новое поле может быть построено нами в процессе игры из байтов, считанных ранее. (Во "взрослых" системах такая постепенная сборка реализуется путем построения "Доски объявлений"). Но нам пока важнее не сами эти сложности, а возможность вводить их постепенно, заменяя "просто дорожку" на "живые картинки" по мере понимания задачи.

С точки зрения модели "текстовых машин" из Заметок

ТЕМА #70, АБЗАЦ #773

ТЕМА #70, АБЗАЦ #773 начальные машины (1-9 ) относятся к "разархиватору", конечные (10-11) - к "разборщику". Очевидно, далее должен следовать "отображатель".

начальные машины (1-9 ) относятся к "разархиватору", конечные (10-11) - к "разборщику". Очевидно, далее должен следовать "отображатель".С точки зрения физического переноса данных машины 2, 3, 4 и 7 практически не нуждаются в хранилищах информации, т.к. могут просто размечать полученный первой машиной файловый буфер.

На первый взгляд кажется, что можно сделать проще всего - пускать байты по одному, с левого конца цепочки, чтобы они проходили весь конвейер. Однако, это перестает быть простым, как только вспомним, что информация может накапливаться на некоторых лентах где-то посредине. Все равно, будет нужно приостанавливать запуск байтов "с самого начала" и разгребать накопившиеся. Значит, нужно будет уметь "переходить к самой правой готовой ленте" (вызов по цепи синхронизации).

Если немного подумать, то станет ясно, что пропуск байтов по одному работает ровно там, где нет надобности в новых хранилищах информации, т.е. в машинах 2, 3, 4 и 7. Это настолько просто, что можно описать таблицей.

Для этих машин - BLK-PCK-BLKS - работающих с одним и тем же входным массивом, выдаваемым машиной FILE, мы имеем следующую инструкцию по обработке байтов, которая может быть оформлена в виде одного цикла, пробегающего по всем байтам файла - от первого до последнего:

| Байты | События | Передача | Далее |

| Заголовок 0-9 | - | B64 начальный | ... |

| Заголовок 10 | Нахождение N | B64 ... | ... |

| Заголовок 11-N | - | B64 ... | Новый блок |

| Блок ";" 0 | Фиксация ";" | - | Конец |

| Блок "," 0 | Фиксация "," | B64 конечный | ... |

| Блок "," 1-8 | - | B64 ... | ... |

| Блок "," 9 | Нахождение N | B64 ... | ... |

| Блок "," 10-N | - | B64 ... | Пакет |

| Блок "," пакет 0 | Нахождение N | B64 ... | Если N=0, новый блок |

| Блок "," пакет 1-N | - | B64 ... | Новый пакет |

| Блок "!-F9" 0-1 | Фиксация "!-F9" | B64 промежуточный | ... |

| Блок "!-F9" 2-8 | - | B64 ... | Новый блок |

| Блок "!-1" 0-1 | Фиксация "!-1" | - | Пакет |

| Блок "!-1" пакет 0 | Нахождение N | - | Если N=0, новый блок |

| Блок "!-1" пакет 1-N | - | FILD ... | Новый пакет |

| Блок "!-2" 0-1 | Фиксация "!-2" | - | Пакет |

| Блок "!-2" пакет 0 | Нахождение N | - | Если N=0, новый блок |

| Блок "!-2" пакет 1-N | - | CODE | Новый пакет |

| Блок "!-3" 0-1 | Фиксация "!-3" | - | Пакет |

| Блок "!-3" пакет 0 | Нахождение N | - | Если N=0, новый блок |

| Блок "!-3" пакет 1-N | - | B64 отдельный | Новый пакет |

| Блок "!-4" 0-1 | Фиксация "!-4" | - | Пакет |

| Блок "!-4" пакет 0 | Нахождение N | - | Если N=0, новый блок |

| Блок "!-4" пакет 1-N | - | Корректировка машин | Новый пакет |

| Блок "!-*" 0-1 | Фиксация "!-что-то непонятное" | - | Пакет |

| Блок "!-*" пакет 0 | Нахождение N | - | Если N=0, новый блок |

| Блок "!-*" пакет 1-N | - | - | Новый пакет |

Но, все равно видно, что связи и по передаче управления (перебору символов), и по управляющим переменным достаточно замысловаты.

Кажется, что на "неструктурном языке" запись этой "программы" будет даже проще - в одну линию, с goto-возвратами к готовым машинам от неготовых. Легко представить, что большинство оптимизаций "проверок и синхронизаций лент" можно будет учесть правильной расстановкой этих самых gotо.

В "структурном" варианте речь, очевидно, должна идти о вложенных циклах:

while(готова лента 1) {

while(готова лента 2) {

while(готова лента 3) {

...

}}}

- чтобы возвращаться каждый раз к самой правой готовой, или переходить к следующей. Однако, вставить в такую "матрешку" еще одну машину, не порушив всю структуру, будет крайне затруднительно. Тем более, что в цепочке есть развилки.

Классики, правда, любят в таком случае говорить о "сопрограммах". Их-то реализовать проще - даже на "структурном языке". Группы операторов "между точками восстановления" нужно заменить функциями. Указатель текущего оператора заменить на переменную, содержащую адрес ф-ии. Goto - на присвоение этой переменной. Чтобы избежать слишком глубокой вложенности вызовов, нужно охватить всю программу циклом "эмуляции", вызывающим ф-ии, адресуемые переменной-указателем. (В крайнем случае, можно использовать оператор switch, выбирающий нужную ф-ию по номеру). Такой "эмулятор" изначально присутствует, например, в любой FORTH-машине.

***

Сами Машины Тьюринга я сразу начал трактовать достаточно широко. Например, я допустил их "усложнение почти произвольным образом". ("Почти" обозначает, что вводить магические операции все-таки нельзя). Например, можно было добавлять составные состояния, сложные символы, возможность обратится к любой части ленты, дополнительные действия в процессе смены состояния...

Например, если в лоб реализовать 8-ю Машину Тьюринга - B64 (преобразование троек 8-битовых символов в четверки 6-битовых "AB..+/"), то понадобится 256 строк таблицы для состояния чтения первого символа, затем 4*256 строк для чтения второго (4 состояния, определяемые недообработанными 2-мя битами первого состояния), 16*256 - для чтения третьего символа, и последние 256 для вывода остатка (всего 5632 строк).

Как-то так

(состояние; символ -> новое состояние; новый символ; сдвиг входной ленты; свиг выходной ленты):

0.0; 00 -> 1.0; "A"; ">"; ">"

...

0.0; 03 -> 1.3; "A"; ">"; ">"

0.0; 04 -> 1.0; "B"; ">"; ">"

...

0.0; FF -> 1.3; "/"; ">"; ">"

1.0; 00 -> 2.0; "A"; ">"; ">"

...

1.0; FF -> 2.F; "O"; ">"; ">"

1.1; 00 -> 2.0; "P"; ">"; ">"

...

1.3; FF -> 2.F; "/"; ">"; ">"

2.0; 00 -> 3.0; "A"; "."; ">"

...

2.F; FF -> 3.0; "/"; "."; ">"

3.0; 00 -> 0.0; "A"; ">"; ">"

...

3.0; 3F -> 0.0; "/"; ">"; ">"

3.0; 40 -> 0.0; "A"; ">"; ">"

...

3.0; FF -> 0.0; "/"; ">"; ">"

Почему "правильная" Машина Тьюринга получилась такой большой? Ислючительно из-за неудачного выбора входного алфавита. 8 бит на символ - слишком много. Обычно теоретики предпочитают работать с однобитными символами... (А, если B64 будет получать пары битов, то ей вообще ничего не надо будет делать! Просто отсчитывать по три символа и все...)

Вообще, возможность преобразований Машин Тьюринга - это классика. Например, можно уменьшить число состояний (в пределе - до двух), вводя сложные символы, и можно уменьшить число символов (опять - до двух), вводя состояния-дешифраторы.

Но удобнее пойти другим путем. Если я дополню процедуры Машины операциями над битами внутри байтов, то понадобится всего 1+4+16+1=22 строки.

0.0; X -> 1.(два младших бита X); F(остальные биты X); ">"; ">"

1.0..3; Y -> 2.(4 младших бита Y); F(мл.биты состояния и остальные биты Y); ">"; ">"

2.0..F; Z -> 3.0; F(мл.биты состояния и 2 старших бита Z); "."; ">"

3.0; Z -> 0.0; F(6 младших битов Z); ">" ; ">"

Это приводит нас к наличию "вычислительных" символов, т.е. таких, которые не будут прописываться в таблицах Машины, но будут служить значениями для вычислений. Если мы будем хранить их на обычной ленте, придется вводить и состояния Машины, нечувствительные к символам на ленте. Что-то вроде:

...

ВВОД-КОДА; "+" -> СЛОЖЕНИЕ; *; *

СЛОЖЕНИЕ; A -> ВВОД-КОДА; {АККУМУЛЯТОР + А}; *

...

Первая строка - часть распознавателя команд, обычная тьюринговская. Во второй же символ "A" означает любое число, над которым производится операция, результат которой записывается на ленту.

Другой вариант добавления процедур к Машине Тьюринга я применял в старой версии машины 12 - TREE. Сама Машина занималась там только переключениями с одного состояния в другое в зависимости от того, какому регулярному выражению соответствует очередная строка, а процедура записи на ленту была заменена ссылкой на функцию, делающую с этой строкой что-то полезное

ТЕМА #70, АБЗАЦ #762

ТЕМА #70, АБЗАЦ #762 .

.Еще один вариант хранения значений на ленте - прицепить к каждой клетке ленты дополнительное хранилище для чисел. И/или прописывать в клетках таблицы дополнительный параметр - вычислительную операцию. Кстати, можно предвидеть, что в цепочке машин, некоторые символы на правых лентах будут лишь ссылками на символы левых лент, например, машины 2, 3, 4 и 7 могут иметь на своих "рабочих" лентах лишь ссылки на массив выходной ленты FILE.

***

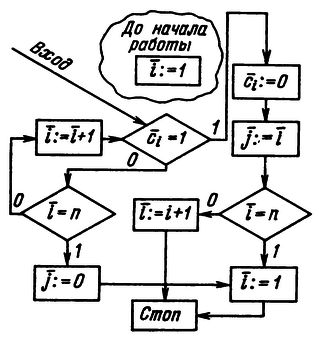

Программа, реализующая один шаг Машины Тьюринга, выглядит как-то так:

ВЫБРАТЬ СТРОКУ, СООТВЕТСТВУЮЩУЮ ТЕКУЩЕМУ СОСТОЯНИЮ И СЧИТАННОМУ СИМВОЛУ;

ЗАПИСАТЬ НА ЛЕНТУ УКАЗАННЫЙ В СТРОКЕ СИМВОЛ;

ПЕРЕЙТИ К НОВЫМ ДАННЫМ НА ЛЕНТЕ;

ИЗМЕНИТЬ СОСТОЯНИЕ НА УКАЗАННОЕ.

Уже здесь можно углядеть помеху нашей попытке ввести сложные символы: получается, что сложный символ нужно читать дважды: первый раз - для нахождения строки таблицы (общим для всех состояний способом) и второй - для вычисления новых значений (уже, возможно, способом, зависящим от состояния.

В "наиболее общей" Машине Тьюринга будет только одна общая операция - нахождения нужной строки таблицы. Остальные операции - записи, протяжки ленты и нахождения состояния должны быть указателями на операции, возможно, уникальные для отдельных состояний. Как, например, битовые вычисления в машине B64.

НАХОЖДЕНИЕ(СОСТОЯНИЕ, СИМВОЛ);

ЗАПИСЬ(СОСТОЯНИЕ, СИМВОЛ, СТРОКА ТАБЛИЦЫ);

ПРОТЯЖКА(СОСТОЯНИЕ, СИМВОЛ, СТРОКА ТАБЛИЦЫ);

СОСТОЯНИЕ = НОВОЕ(СОСТОЯНИЕ, СИМВОЛ, СТРОКА ТАБЛИЦЫ).

И, даже, возможно немного изменить операцию нахождения строки:

ПРОЦЕДУРА НАХОЖДЕНИЯ СЛЕДУЮЩЕЙ = УТОЧНЕНИЕ(СОСТОЯНИЕ, СИМВОЛ, СТРОКА ТАБЛИЦЫ);

Однако, основным свойством наиболее общих программных систем является их полная практическая бесполезность.

Каков же наиболее удобный набор машинных операций, чтобы свести их табличное описание к минимуму? Сколько в таблице будет констант, а сколько функций?

(Для машин с отдельными входными и выходными лентами):

ДЛЯ r(Q) И r(A) ВЫПОЛНИТЬ w(A) w(I) w(O) w(Q),

где Q - состояние, A - символ на ленте, I/O - перемещение по входной/выходной ленте, r() - ф-ия анализа, w() - ф-ия записи/перехода

Т.к. r(A) может отменить успех r(Q) ценой некоторой возможной потери эффективности:

ДЛЯ Q И r(A) ВЫПОЛНИТЬ w(A) w(I) w(O) w(Q)

Т.к. w(A) может (в крайнем случае) просто изменить Q:

ДЛЯ Q И r(A) ВЫПОЛНИТЬ w(A) w(I) w(O) Q

r(A) и w(I) объединять нельзя, т.к. значение на входной ленте используется в w(A). Избавиться от w(I) и w(O) тоже нельзя ввиду сложности устройства клеток лент. Их можно только объединить с w(A):

ДЛЯ Q И r(A) ВЫПОЛНИТЬ w(AIO) Q

Сливать r(A) и w(AIO) не стоит - потеряется наглядность таблицы. Итого - две ф-ии: анализа символа и записи нового.

***

Нет никакого резона писать эмулятор системы Машин Тьюринга потребного размера и переводить всю задачу на ее язык. Просто потому, что обычный язык программирования уже имеет на борту намного более удобные операторы и выражения. Переходя обратно к Машине Тьюринга, мы сами себе будем усложнять жизнь.

Чем программа на "упрощенном алголе" лучше Машины Тьюринга:

1) можно сразу обращаться к нужной переменной, а не проматывать ленту до нужной позиции (или переходить к подмножеству состояний, соответствующему значению переменной);

2) не нужно на каждом шаге проводить полный цикл операций по работе с таблицей Машины;

3) не нужно переводить арифметические операции в элементарные.

Но,

чем лучше Машина Тьюринга (окромя формализмов):

1) можно абстрагироваться от источника информации, лента может изображать и поток ввода-вывода, и блок памяти, и аппаратные управляющие сигналы;

2) можно писать программу не на языке программирования, а в виде заполнения данными таблицы. Можно даже дать пользователю возможность вводить заранее не предусмотренные программой команды - как положено при разработке любых интерпретаторов (например FORTH)

ТЕМА #43, АБЗАЦ #427

ТЕМА #43, АБЗАЦ #427 .

.Третий минус сильно умаляет второй плюс. Какая выгода от таблиц, если они будут необозримы и трудночитаемы? Поэтому чисто арифметические куски кода все-таки проще оформлять подпрограммами на "алголе".

И, да, тот же "алгол" тоже имеет в себе два практически независимых языка - операторов (смены состояний) и выражений (вычисления значений) - с совершенно разным синтаксисом. Чем Машина Тьюринга хуже?

***

Пусть один шаг машины будет выглядеть так:

ВЫБРАТЬ СТРОКУ;

ЗАПИСАТЬ СИМВОЛ;

ПЕРЕЙТИ К НОВЫМ ДАННЫМ;

ИЗМЕНИТЬ СОСТОЯНИЕ.

Но, т.к. у нас целый коллектив машин, то в начало этой последовательности надо добавить операции:

ВЫПОЛНИТЬ ИНИЦИАЛИЗАЦИЮ;

ПРОВЕРИТЬ ГОТОВНОСТЬ ДАННЫХ;

- а в конец:

ВЫПОЛНИТЬ ФИНАЛИЗАЦИЮ;

ВЫЗВАТЬ ДРУГУЮ МАШИНУ.

Громкими словами - ИНИЦИАЛИЗАЦИЕЙ и ФИНАЛИЗАЦИЕЙ - я обозначил процедуры, ограничивающие жизнь машины - от ее запуска в одном из стартовых состояний, до достижения конечного состояния. Например, машина B64 должна где-то помнить, читает ли она продолжение блока символов или начинает новый, а при окончании блока - добавлять завершающие символы "=" до получения полной четверки символов.

Здесь важно не переусложнить. Например, можно, как в языках программирования высокого уровня сделать ВЫЗОВ ДРУГОЙ МАШИНЫ частью вызова функции вывода значения (т.е. честной подпрограммой).

И, наоборот, реализовать ИНИЦИАЛИЗАЦИИ и ФИНАЛИЗАЦИИ переходом в соответствующие СОСТОЯНИЯ.

***

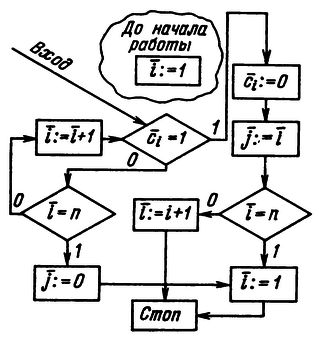

Согласились мы или нет оформлять отдельные процедуры своей программы (а, может, даже, и целые процессы) в виде Машинок Тьюринга, изначальный вопрос взаимодействия этих машин, так и повис в воздухе.

Уже здесь, даже не вникая в детали синхронизации машин, очевидно, что полный набор операций и учет всех ситуаций избыточен. Многие машины цепочки устроены намного проще. Например, большинство входных лент нашей цепочки будут просматриваться только один раз, без возврата к уже прочитанным символам. Большинство правых машин будут автоматически готовы к работе после срабатывания левых, а большинство левых - после возврата им управления после срабатывания правых...

Есть ли какая-то теория, позволяющая упростить вычисления, пользуясь знанием об ограниченности множеств данных? Есть. См. статью Ершова.

***

С точки зрения структурного программирования, инвариантом рабочего цикла нашей цепочки машин является:

1. Существует некоторая точка T, левее которой все машины уже перешли в конечное состояние. Когда T дойдет до правого конца, работа будет закончена.

2. Существует точка S, между T и правым концом, обозначающая самую правую готовую к работе машину.

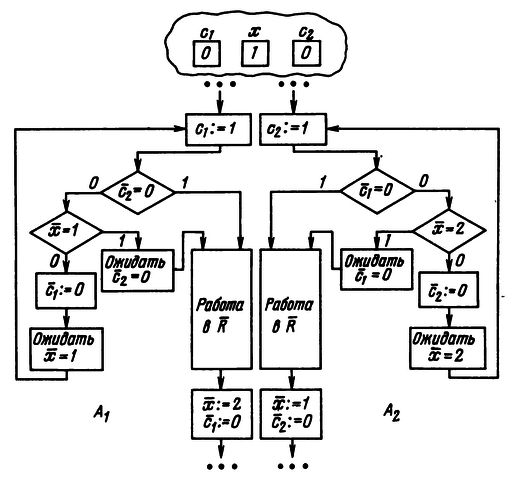

Описывая ситуации, на которые машина должна реагировать, можно ввести для каждой тройку условий. si - данные для i-й машины готовы, ti - машина достигла конечного состояния, pi - машина сработала. Под срабатыванием понимаем достижением состояния, требующего проверки возможного изменения S:

- S перемещается вправо, si остается истинным;

- S перемещается вправо, si становится ложным;

- S остается на месте;

- S смещается влево, до ближайшей готовой.

***

Возможность упрощения опять следует искать во взаимной зависимости - теперь si, pi и ti - соседних машин. Например, pi для некоторых машин может автоматически вызывать сдвиг S вправо, или делать si ложным. Тогда нам не придется перебирать всю цепочку в поисках S, проверяя при этом все условия готовности.

***

Что означает соединение машин лентами? Очевидно, что ф-ии r(A) и w(AIO) должны как-то справляться с предикатами si, pi и ti. "Достаточная" запись вызывать запуск следующей машины, неготовность ко вводу - переход влево... Говорить заранее об "общих принципах" тут смысла не имеет.

Языки программирования дают нам множество вариантов:

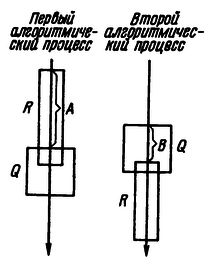

- вырожденная ситуация, когда одному шагу левой машины соответствует один шаг правой и их можно просто соединить последовательно (друг за другом в тексте программы);

- левая машина может вызывать правую по мере готовности (см. выше вложенные операторы while);

- правая машина может вызывать левую, когда ей нужна новая порция данных;

- на каждом шаге "объемлющая машина" проверяет машины/ленты в поисках самой правой готовой, и передает туда управление.

Все это можно сделать при помощи управляющих операторов, подпрограмм, сопрограмм, системных вызовов и т.п.

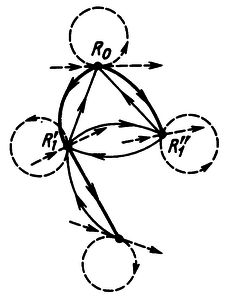

Кроме упомянутого соединения машин промежуточными лентами, легко представить себе включение одной машину в другую для сложной обработки одной из ситуаций (например, расчета нового состояния или нового символа); или параллельный запуск нескольких машин для разделения независимых друг от друга вычислений.

Еще можно измыслить (для машин, соединенных промежуточными лентами):

1) объединение двух соседних машин в одну; это возможно только в тех случаях, когда промежуточная лента очень мала или когда обе машины имеют дело практически с одной входной лентой. Компромиссное решение - превратить промежуточную ленту во внутреннюю ленту памяти новой машины;

2) вставку в цепочку новой машины для обеспечения нового функционала; достаточно очевидно "на картинке", но, как я писал выше, именно простая и наглядная реализация вставки подобного кода в программу и явилась проблемой этих рассуждений;

3) разбиение одной машины на две для упрощения структуры ленты; если, конечно, можно разделить состояния машины на два слабо связанные множества;

4) удаление избыточных операций; видимо, в итоге опять сведется к объединению всех машин в одну. С выбрасыванием всех промежуточных лент. По сравнению с поддержкой межмашинного взаимодействия монолитная программа будет по-машинному проще, хотя и совершенно недоступной для понимания человеком...

***

Вспомним машину B64. В этот раз, как имеющую большое разнообразие входных данных. Кроме того, эта машина имеет сложный формат вывода и набор переменных для отображения текущего состояния накопителя машины. См. выше таблицу.

Для описания ее работы проще всего придумать некоторый "язык", на котором можно этой машиной управлять.

Тогда набор команд на кодирование GIF-заголовка должен был бы выглядеть как-то так:

НАКОПИТЕЛЬ СБРОСИТЬ

ВЫВЕСТИ "\GIF\имя_файла.GIF"

ВЫВЕСТИ "ТЕКСТ"

БАЙТЫ адрес размер

ВЫВЕСТИ ПРОБЕЛ

ВЕРНУТЬСЯ

Соответственно, для блока "!-F9":

ВЫВЕСТИ "\GIF\имя_файла.GIF\EXP"

ВЫВЕСТИ "ТЕКСТ"

БАЙТЫ адрес 8

ВЫВЕСТИ ПРОБЕЛ

ВЕРНУТЬСЯ

Для ",":

НАКОПИТЕЛЬ СОХРАНИТЬ

ВЫВЕСТИ "\GIF\имя_файла.GIF\GIF\номер"

ВЫВЕСТИ "ТЕКСТ"

БАЙТЫ адрес размер

ВЕРНУТЬСЯ

...

БАЙТЫ адрес размер

ВЕРНУТЬСЯ

...

БАЙТЫ адрес 1

ЗАВЕРШИТЬ

НАКОПИТЕЛЬ ВОССТАНОВИТЬ

ВЫВЕСТИ ПРОБЕЛ

ВЕРНУТЬСЯ

Чуть проще для "!-3":

НАКОПИТЕЛЬ СОХРАНИТЬ СБРОСИТЬ

ВЫВЕСТИ "\GIF\имя_файла.GIF\IMG\номер"

ВЫВЕСТИ "ТЕКСТ"

ВЕРНУТЬСЯ

...

БАЙТЫ адрес размер

ВЕРНУТЬСЯ

...

ЗАВЕРШИТЬ

НАКОПИТЕЛЬ ВОССТАНОВИТЬ

ВЫВЕСТИ ПРОБЕЛ

ВЕРНУТЬСЯ

Возможно, здесь будет дешевле будет не передавать программу шаг за шагом, а просто строить B64 на лету?

***

Достройка машины на лету может пригодиться и в 6-й машине STR, переводящей LZW-коды в строки байтов. Можно видеть, что ее ядром является постоянно растущий словарь строк. Единственная процедура работы со строкой - вывод ее. Новая строка добавляется приписыванием новой буквы в конец одной из строк словаря (предпоследняя строка кода).

В рамках традиционного программирования словарь создается как древообразная структура пар (буква, ссылка на пару-родителя). А рекурсия без труда справляется с процедурой вывода - выводит (рекурсивно) начало, а потом - букву. К сожалению, Машина Тьюринга работает наоборот: сначала выводит символ, а затем - передает управление.

Т.к. одна и та же строка может иметь много наследников, и все предки любой строки остаются в словаре, другие способы хранения, кроме указанного дерева, неприемлимы. Также необходимым становится и промежуточное хранилище - либо для стека возвратов рекурсии, либо для разворота строки задом наперед.

Словарь растет, и Машина Тьюринга может для реализации этого достраиваться "на лету". Мы, ведь помним, что Машина Тьюринга может быть целиком записана на ленте и скормлена другой машине. (Можно ли "достраивая машину" получить "неожиданное поведение", выходящее за рамки обычной Машины? Конечно, нет. Формально они все эквивалентны).

Но стоит ли этот алгоритм реализовать честной Машиной Тьюринга? Видимо, достаточным будет чтобы он таковой только прикидывался, получая и выдавая ленты.

Последний раз редактировалось: Gudleifr (Ср Окт 25, 2023 12:27 am), всего редактировалось 17 раз(а)

Gudleifr- Admin

- Сообщения : 3246

Дата регистрации : 2017-03-29

Re: О компиляции Машин Тьюринга

Re: О компиляции Машин Тьюринга

Для отдохновения души, почитаем этих самых классиков:

Д.КНУТ. ИСКУССТВО ПРОГРАММИРОВАНИЯ. ТОМ I

1.4.2. СОПРОГРАММЫ

Подпрограммы являются частным случаем более общих программных компонент, называемых "сопрограммами". Если отношения между главной программой и подпрограммой отличаются несимметричностью, то отношения между сопрограммами вполне симметричны, причем КАЖДОЙ из сопрограмм позволено ВЫЗЫВАТЬ ДРУГУЮ.

Чтобы понять концепцию сопрограмм, взглянем еще раз на подпрограммы, но с некоторой другой позиции. Точка зрения, принятая в предыдущем пункте, состояла в том, что подпрограмма является лишь расширением аппаратуры вычислительной машины, которое диктуется желанием сократить количество команд в программе. Может быть, это и так, но допустима и другая точка зрения. Мы можем рассматривать главную программу и подпрограмму как бригаду программ, в которой каждый член бригады обязан выполнять некоторое задание. Главная программа в процессе выполнения своего задания возбуждает подпрограмму; подпрограмма выполняет свою функцию и затем возбуждает главную программу. Мы могли бы напрячь воображение и поверить в то, что с точки зрения подпрограммы выход из нее есть не что иное, как вызов главной программы; главная программа продолжает выполнять свои обязанности, а затем "выходит" в подпрограмму. Теперь работает подпрограмма, и затем она снова вызывает главную программу.

Эти несколько отвлеченные рассуждения становятся вполне реальными, если речь заходит о сопрограммах, когда невозможно отличить, какая из них является подпрограммой другой. Предположим, что у нас есть две сопрограммы A и B; программируя A, мы можем рассматривать B как подпрограмму, но при программировании B мы можем считать, что A является нашей подпрограммой. Таким образом, в сопрограмме A команда "JMP B" используется для того, чтобы возбудить сопрограмму В. В свою очередь, для того чтобы возбудить сопрограмму A, в сопрограмме В используется команда "JMP A". Все это напоминает действия спортсменов в эстафетном беге. Как только сопрограмма активируется, она продолжает выполняться с того самого места, где она была приостановлена в последний раз.

В машине MIX такая связь между сопрограммами реализуется включением в программу следующих четырех команд:

A STJ BX

AX JMP A1

B STJ AX

BX JMP B1 (1)

Для передачи управления в сопрограмму затрачивается четыре машинных такта. Первоначально AX и BX настраиваются на переход в стартовые точки каждой сопрограммы, A1 и B1. Предположим, что первой выполняется команда из ячейки A1 в сопрограмме A. И когда, скажем в ячейке A2, встречается "JMP B", команда в ячейке B сохраняет rJ в AX. Следовательно, в AX окажется "JMP A2+1". Команда, находящаяся в BX, отправит нас в B1, и после этого начнет выполняться сопрограмма B, а в ней в некоторый момент, скажем в ячейке B2, встретится команда "JMP A". Мы сохраним rJ в BX и передадим управление в ячейку A2+1 и тем самым продолжим выполнение сопрограммы A до тех пор, пока вновь не встретится переход в B, в результате которого J сохранится в AX, а управление будет передано в B2+1 и т.д.

Существенное различие между двумя видами связи: программа - подпрограмма и сопрограмма - сопрограмма (и это можно увидеть, изучая приведенный выше пример), состоит в том, что подпрограмма всегда запускается СНАЧАЛА, т.е. с фиксированного места, в то время как главная программа или сопрограмма всегда продолжается С ТОГО МЕСТА, где ее работа была прекращена в последний раз.

На практике сопрограммы являются самым естественным средством при программировании алгоритмов ввода и вывода. Предположим, например, что сопрограмма A должна читать карты и выполнять некоторые преобразования вводимой информации, переводящие ее в последовательность элементов. Другая сопрограмма, которую мы назовем B, выполняет дальнейшую обработку этих элементов и печатает результаты; B будет периодически требовать последовательные входные элементы, получаемые в A. Таким образом, сопрограмма B передает управление A всякий раз, когда ей нужен следующий входной элемент, а сопрограмма A передает управление B всякий раз, когда входной элемент подготовлен. (Читатель может сказать: "Значит, B - основная программа, а A - просто ПОДПРОГРАММА, выполняющая ввод", Однако если процесс, выполняемый A, очень сложный, то это не совсем верно; мы можем даже представить себе A в качестве основной программы, а B - как подпрограмму, выполняющую вывод. При этом приведенное выше описание никоим образом не изменится). Полезность идеи сопрограмм становится очевидной, если мы находимся между этими двумя крайними случаями, т.е. тогда, когда как A, так и B сложны и каждая из них обращается к другой во многих местах. Довольно трудно найти короткие, простые примеры, которые иллюстрируют важность этой идеи; НАИБОЛЕЕ ПОЛЕЗНЫЕ ПРИМЕНЕНИЯ СОПРОГРАММ, КАК ПРАВИЛО, ОЧЕНЬ ДЛИННЫ [выделение мое.- G.].

Чтобы изучить сопрограммы в действии, рассмотрим "надуманный" пример. Предположим, что мы хотим написать программу, которая переводит один код в другой. Входной (транслируемый) код представляет последовательность алфавитно-цифровых литер, оканчивающуюся точкой, например:

A2B5E3426FG0ZYW3210PQ89R. (2)

Такая последовательность перфорируется на картах; пустые колонки (пробелы), встречающиеся на картах, игнорируются. Эту входную информацию следует понимать таким образом (слева направо): если следующая литера - цифра (т.е., 0, 1, ..., 9), скажем n, то это есть указание об n + 1 повторениях следующей литеры независимо от того, является следующая литера цифрой или нет. Нецифровая литера обозначает только себя. Выходом нашей программы должна быть последовательность, полученная указанным образом и разделенная на группы по три литеры в каждой (причем в последней группе может быть меньше чем три литеры). Например, (2) необходимо преобразовать в такую форму:

ABB BEE EEE E44 444 66F GZY W22 220 0PQ 999 999 999 R. (3)

Обратите внимание, что 3426F не означает 3427 повторений буквы F; в результате появляется 4 четверки, 3 шестерки и затем буква F. Наша программа должна отперфорировать результат на картах, по шестнадцать групп на каждой карте.

Для выполнения такого перевода мы напишем две сопрограммы и подпрограмму. Подпрограмма, названная NEXTCHAR, находит следующую литеру, не являющуюся пробелом, во входной последовательчосги и помещает ее в регистр A:

01 * ПОДПРОГРАММА ВВОДА ЛИТЕРЫ

02 READER EQU 16 Номер читающего устройства.

03 INPUT ORIG *+16 Место для входных карт.

04 NEXTCHAR STJ 9F Вход в подпрограмму.

05 - JXNZ 3F Первоначально rX = 0.

06 1H J6N 2F Первоначально rI6 = 0.

07 - IN INPUT(READER) Прочитать следующую карту.

08 - JBUS *(READER) Ждать завершения.

09 - ENN6 16 rI6 указывает на первое слово.

10 2H LDX INPUT+16,6 Взять следующее слово.

11 - INC6 1 Продвинуть стрелку.

12 3H ENTA 0

13 - SLAX 1 Следующая литера ->rA.

14 9H JANZ Пропуск пробелов.

15 - JMP NEXTCHAR+1 []

Эта подпрограмма имеет следующие характеристики:

- Вызов: JMP NEXTCHAR

- Состояние при входе: rI6 указывает на следующее слово, или rI6 = 0, если необходимо прочесть следующую карту; rX = литеры, которые еще будут обрабатываться.

- Состояние при выходе: rA = следующая входная литера (не пробел); rX, rI6 подготовлены для следующего входа в NEXTCHAR.

Наша первая сопрограмма, с названием IN, получает символы из входной последовательности и создает соответствующее количество дубликатов:

16 * ПЕРВАЯ СОПРОГРАММА

17 2H INCA 30 Литера - не цифра.

18 - JMP OUT Передать ее в сопрограмму.

19 IN1 JMP NEXTCHAR Взять литеру.

20 - DECA 30

21 - JAN 2B Буква?

22 - CMPA =10=

23 - JGE 2B Специальная литера?

24 - STA *+1(0:2) Цифра n.

25 - ENT5 * rI5<-n.

26 - JMP NEXTCHAR Взять следующую литеру.

27 - JMP OUT Передать ее в сопрограмму.

28 - DEC5 1 Уменьшить n на 1.

29 - J5NN *-2 Повторить, если это необходимо.

30 - JMP IN1 Начать новый цикл. []

(Напомним, что для MIX цифры 0-9 имеют коды 30-39). Эта сопрограмма имеет следующие характеристики:

- Вызов: JMP IN

- Состояние при выходе (при переходе к OUT): rA = очередная входная литера с учетом размножения; rI4 не изменяет свое значение с момента входа.

- Состояние при входе (после возврата): rA, rX, rI5, rI6 не должны изменять своих значений с момента последнего выхода.

Другая сопрограмма, с названием OUT, размещает код по три литеры и перфорирует карты:

31 * ВТОРАЯ СОПРОГРАММА

32 _ ALF _ Константа для занесения пробелов.

33 OUTPUT ORIG *+16 Буферная область для ответов.

34 PUNCH EQU 17 Номер устройства (перфоратора).

35 OUT1 ENT4 -16 Начать новую карту.

36 - ENT1 OUTPUT

37 - MOVE -1,1(16) Занести пробелы в область вывода.

38 1H JMP IN Взять следующую литеру.

39 - STA OUTPUT+16,4(1:1) Занести в выходную карту.

40 - СМРА PERIOD Это "."?

41 - JE 9F

42 - JMP IN Если нет, то взять следующую литеру.

43 - STA OUTPUT+16,4(2:2) Занести ее.

44 - СМРА PERIOD Это "."?

45 - JE 9F

46 - JMP IN Если нет, то взять следующую литеру.

47 - STA OUTPUT+16,4(3:3) Занести ее.

48 - СМРА PERIOD Это "."?

49 - JE 9F

50 - INC4 1 Перейти к следующему слову.

51 - J4N 1B Конец карты?

52 9H OUT OUTPUT(PUNCH) Если да, то перфорация.

53 - JBUS *(PUNCH) Ждать завершения.

54 - JNE OUT1 Возвратиться и продолжить, если не была принята ".".

55 - HLT

56 PERIOD ALF . []

Эта сопрограмма имеет следующие характеристики:

- Вызов: JMP OUT

- Состояние при выходе (при переходе к IN): rA, rX, rI5, rI6 сохраняют те значения, которые были при входе.

- Состояние при входе (при возврате): rA = (следующая входная литера с учетом размножения); значение r4 сохранилось с момента последнего выхода.

Чтобы завершить программу, мы должны обеспечить связь между сопрограммами [см. (1)] и соответствующие начальные установки. Начальные установки в сопрограммах требуют некоторой изобретательности, хотя и не создают заметных затруднений.

57 * НАЧАЛЬНАЯ УСТАНОВКА И СВЯЗЬ

58 START ENT6 0 Подготовить rI6 для NEXTCHAR.

59 - ENTX 0 Подготовить rX для NEXTCHAR.

60 - JMP OUT1 Начать с OUT.

61 OUT STJ INX Связь сопрограмм.

62 OUTX JMP OUT1

63 IN STJ OUTX

64 INX JMP INI

65 - END START []

Теперь программа написана полностью. Читателю следует тщательно изучить ее, обращая особое внимание на то, как можно написать каждую из сопрограмм независимо, в предположении, что другая сопрограмма является ее подпрограммой.

В программе, приведенной выше, состояния входа и выхода для IN и OUT полностью согласованы. Общий случай может оказаться менее удачным, и тогда для связи сопрограмм потребуется также загрузка и запоминание соответствующих регистров. Например, если сопрограмма OUT изменяет содержимое регистра А, то группа команд для связи сопрограмм примет следующий вид:

OUT STJ INX

- STA HOLD A Запомнить А при выходе из IN.

OUTX JMP OUT1

IN STJ OUTX

- LDA HOLDA Восстановить А при выходе из OUT.

INX JMP IN1

Существует важное родство между сопрограммами и МНОГОПРОХОДНЫМИ АЛГОРИТМАМИ. Например, процесс перевода, который мы только что описали, можно было бы выполнить за два отдельных прохода. Во-первых, мы могли бы сделать в точности то, что делает сопрограмма IN, применяя ее ко всей входной информации и записывая каждую литеру с соответствующим числом дубликатов на магнитную ленту. После того как эта обработка закончится, мы могли бы перемотать ленту в начало и затем сделать в точности то, что делает сопрограмма OUT, принимая литеры с ленты группами по три. Это называют "двухпроходной" обработкой. (Интуитивно под словом "проход" мы подразумеваем полный просмотр входной информации. Это не строгое определение; во многих алгоритмах совсем не ясно количество выполненных проходов. Однако интуитивная концепция "прохода" полезна, несмотря на ее расплывчатость).

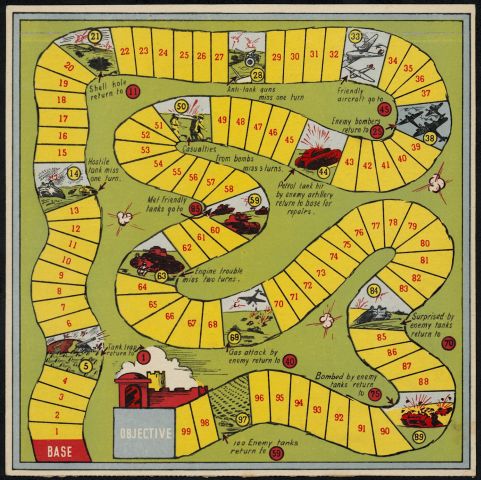

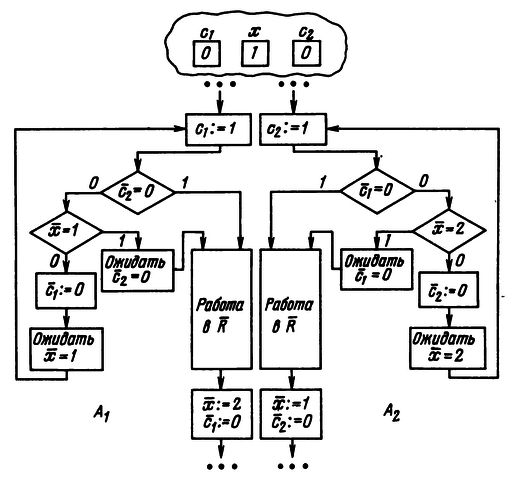

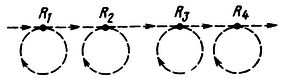

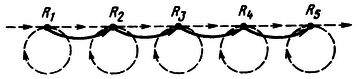

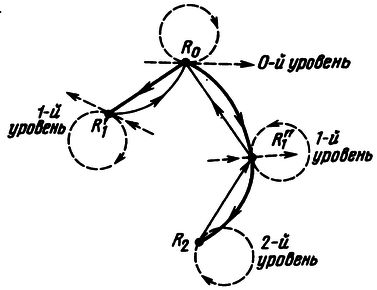

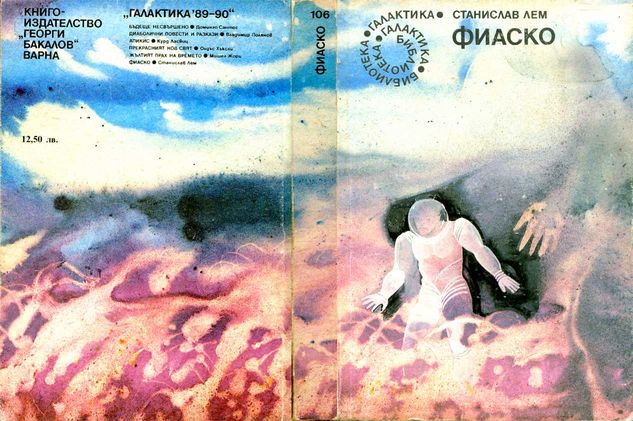

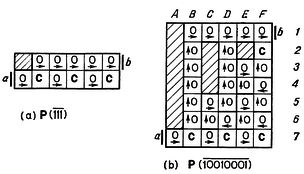

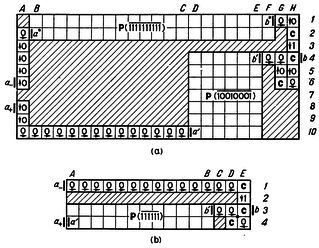

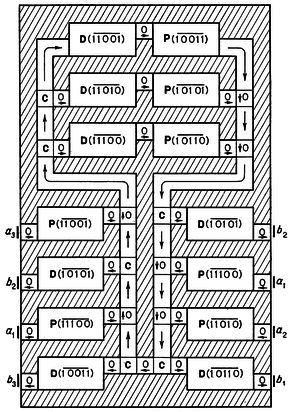

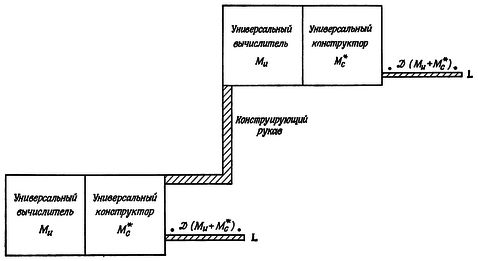

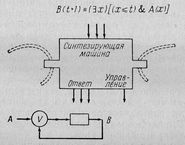

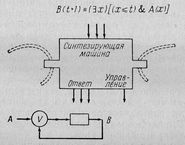

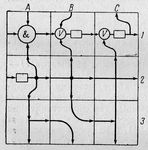

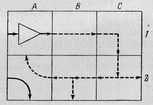

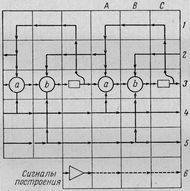

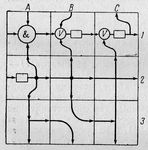

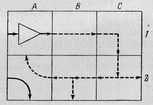

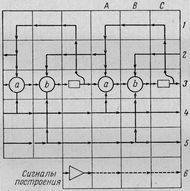

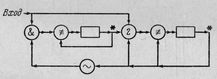

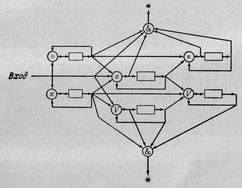

Рис.22. Проходы: (а) четырехпроходный алгоритм, (b) однопроходный алгоритм.

На рис.22(а) показана четырехпроходная обработка. Очень часто мы обнаруживаем, что тот же самый процесс может быть выполнен всего в один проход, как показано на рис.22(b), если мы заменим четырьмя сопрограммами A, B, C, D соответствующие проходы A, B, C, D. Сопрограмма A будет переходить к B, тогда как проход записывал бы элемент выходной информации на ленту 1; сопрограмма B будет переходить к A, тогда как проход читал бы элемент входной информации с ленты 1, и B будет переходить к C, тогда как проход B писал бы элемент выходной информации на ленту 2; и т.д.

И наоборот, процесс, реализованный с помощью n сопрограмм, часто можно трансформировать в n-проходный процесс. Поскольку существует такое соответствие, полезно сравнить многопроходные алгоритмы с однопроходными алгоритмами.

a) ПСИХОЛОГИЧЕСКОЕ РАЗЛИЧИЕ. Для решения одной и той же проблемы многопроходный алгоритм, как правило, легче создать и понять, чем однопроходный алгоритм. Процесс, разбитый на ряд небольших этапов, которые выполняются один за другим, легче понять, чем сложный процесс, в котором все происходит одновременно.

Кроме того, если речь идет о большой задаче и если разработкой программы для машины занимается большая группа людей, то многопроходный алгоритм естественным образом обеспечивает разделение работы.

Эти преимущества многопроходного алгоритма присущи также и сопрограммам, поскольку каждую из сопрограмм можно написать независимо от другой, а связь сводит явно многопроходный алгоритм к однопроходному процессу.

b) РАЗЛИЧИЕ ВО ВРЕМЕНИ. Время, необходимое на упаковку, запись, чтение и распаковку промежуточных данных между проходами (например, информации на лентах, см. рис.22), отсутствует в однопроходном алгоритме. Поэтому однопроходные алгоритмы быстрее.

c) РАЗЛИЧИЕ В ОБЪЕМЕ ПАМЯТИ. Однопроходный алгоритм требует места в оперативной памяти одновременно для всех программ, тогда как многопроходный алгоритм требует в каждый момент места только под одну программу. Это может повлиять на скорость даже в большей степени, чем то, о чем говорилось в пункте (b). Например, многие машины имеют ограниченный размер "быстрой памяти" и значительно большую медленную память; если каждый проход может уместиться в быстрой памяти, то результат будет получен значительно быстрее, чем в том случае, если мы используем сопрограммы в одном проходе (поскольку использование сопрограмм, по-видимому, приведет к тому, что большая часть программы окажется в медленной памяти).

Иногда существует необходимость разработать алгоритмы сразу для нескольких конфигураций машины, причем некоторые из них имеют объем памяти больший, чем другие. В этом случае можно было бы написать программу в виде сопрограмм и позволить памяти определять количество проходов: загружать вместе столько сопрограмм, сколько возможно, и компенсировать отсутствующие связи подпрограммами ввода или вывода.

Хотя это родство между сопрограммами и проходами важно, мы должны иметь в виду, что не во всех случаях, когда применяются сопрограммы, возможно расщепление на многопроходные алгоритмы. Например, если сопрограмма B получает входную информацию из A и передает в A информацию, определяющую дальнейшие действия, то преобразование A в проход, за которым следует проход B, становится невозможным.

И конечно, не все многопроходные алгоритмы можно преобразовать в сопрограммы. Некоторым алгоритмам внутренне присуща многопроходность; например, второй проход может требовать кумулятивную информацию от первого прохода (например, суммарное количество появлений некоторого слова во входной информации). Есть старая шутка, которую стоит напомнить в связи с этим.

Старушка, едущая в автобусе: "Мальчик, не скажешь ли, где мне выйти, чтобы попасть на улицу Пасадена?"

Мальчик: "Следите за мной и выходите за две остановки до меня".

(Шутка и состоит в том, что мальчик предлагает двухпроходный алгоритм).

Итак, о многопроходных алгоритмах сказано достаточно. Далее, во многих местах по всей этой книге мы встретимся с примерами сопрограмм, в частности, как с частью схемы буферизации. Сопрограммы играют также важную роль в моделировании дискретных систем...

***

Т.е. оправдать применение сопрограмм может только их сложность. А наша программа изначально проста. Как быть?

Д.КНУТ. ИСКУССТВО ПРОГРАММИРОВАНИЯ. ТОМ I

1.4.2. СОПРОГРАММЫ

Подпрограммы являются частным случаем более общих программных компонент, называемых "сопрограммами". Если отношения между главной программой и подпрограммой отличаются несимметричностью, то отношения между сопрограммами вполне симметричны, причем КАЖДОЙ из сопрограмм позволено ВЫЗЫВАТЬ ДРУГУЮ.

Чтобы понять концепцию сопрограмм, взглянем еще раз на подпрограммы, но с некоторой другой позиции. Точка зрения, принятая в предыдущем пункте, состояла в том, что подпрограмма является лишь расширением аппаратуры вычислительной машины, которое диктуется желанием сократить количество команд в программе. Может быть, это и так, но допустима и другая точка зрения. Мы можем рассматривать главную программу и подпрограмму как бригаду программ, в которой каждый член бригады обязан выполнять некоторое задание. Главная программа в процессе выполнения своего задания возбуждает подпрограмму; подпрограмма выполняет свою функцию и затем возбуждает главную программу. Мы могли бы напрячь воображение и поверить в то, что с точки зрения подпрограммы выход из нее есть не что иное, как вызов главной программы; главная программа продолжает выполнять свои обязанности, а затем "выходит" в подпрограмму. Теперь работает подпрограмма, и затем она снова вызывает главную программу.

Эти несколько отвлеченные рассуждения становятся вполне реальными, если речь заходит о сопрограммах, когда невозможно отличить, какая из них является подпрограммой другой. Предположим, что у нас есть две сопрограммы A и B; программируя A, мы можем рассматривать B как подпрограмму, но при программировании B мы можем считать, что A является нашей подпрограммой. Таким образом, в сопрограмме A команда "JMP B" используется для того, чтобы возбудить сопрограмму В. В свою очередь, для того чтобы возбудить сопрограмму A, в сопрограмме В используется команда "JMP A". Все это напоминает действия спортсменов в эстафетном беге. Как только сопрограмма активируется, она продолжает выполняться с того самого места, где она была приостановлена в последний раз.

В машине MIX такая связь между сопрограммами реализуется включением в программу следующих четырех команд:

A STJ BX

AX JMP A1

B STJ AX

BX JMP B1 (1)

Для передачи управления в сопрограмму затрачивается четыре машинных такта. Первоначально AX и BX настраиваются на переход в стартовые точки каждой сопрограммы, A1 и B1. Предположим, что первой выполняется команда из ячейки A1 в сопрограмме A. И когда, скажем в ячейке A2, встречается "JMP B", команда в ячейке B сохраняет rJ в AX. Следовательно, в AX окажется "JMP A2+1". Команда, находящаяся в BX, отправит нас в B1, и после этого начнет выполняться сопрограмма B, а в ней в некоторый момент, скажем в ячейке B2, встретится команда "JMP A". Мы сохраним rJ в BX и передадим управление в ячейку A2+1 и тем самым продолжим выполнение сопрограммы A до тех пор, пока вновь не встретится переход в B, в результате которого J сохранится в AX, а управление будет передано в B2+1 и т.д.

Существенное различие между двумя видами связи: программа - подпрограмма и сопрограмма - сопрограмма (и это можно увидеть, изучая приведенный выше пример), состоит в том, что подпрограмма всегда запускается СНАЧАЛА, т.е. с фиксированного места, в то время как главная программа или сопрограмма всегда продолжается С ТОГО МЕСТА, где ее работа была прекращена в последний раз.

На практике сопрограммы являются самым естественным средством при программировании алгоритмов ввода и вывода. Предположим, например, что сопрограмма A должна читать карты и выполнять некоторые преобразования вводимой информации, переводящие ее в последовательность элементов. Другая сопрограмма, которую мы назовем B, выполняет дальнейшую обработку этих элементов и печатает результаты; B будет периодически требовать последовательные входные элементы, получаемые в A. Таким образом, сопрограмма B передает управление A всякий раз, когда ей нужен следующий входной элемент, а сопрограмма A передает управление B всякий раз, когда входной элемент подготовлен. (Читатель может сказать: "Значит, B - основная программа, а A - просто ПОДПРОГРАММА, выполняющая ввод", Однако если процесс, выполняемый A, очень сложный, то это не совсем верно; мы можем даже представить себе A в качестве основной программы, а B - как подпрограмму, выполняющую вывод. При этом приведенное выше описание никоим образом не изменится). Полезность идеи сопрограмм становится очевидной, если мы находимся между этими двумя крайними случаями, т.е. тогда, когда как A, так и B сложны и каждая из них обращается к другой во многих местах. Довольно трудно найти короткие, простые примеры, которые иллюстрируют важность этой идеи; НАИБОЛЕЕ ПОЛЕЗНЫЕ ПРИМЕНЕНИЯ СОПРОГРАММ, КАК ПРАВИЛО, ОЧЕНЬ ДЛИННЫ [выделение мое.- G.].

Чтобы изучить сопрограммы в действии, рассмотрим "надуманный" пример. Предположим, что мы хотим написать программу, которая переводит один код в другой. Входной (транслируемый) код представляет последовательность алфавитно-цифровых литер, оканчивающуюся точкой, например:

A2B5E3426FG0ZYW3210PQ89R. (2)

Такая последовательность перфорируется на картах; пустые колонки (пробелы), встречающиеся на картах, игнорируются. Эту входную информацию следует понимать таким образом (слева направо): если следующая литера - цифра (т.е., 0, 1, ..., 9), скажем n, то это есть указание об n + 1 повторениях следующей литеры независимо от того, является следующая литера цифрой или нет. Нецифровая литера обозначает только себя. Выходом нашей программы должна быть последовательность, полученная указанным образом и разделенная на группы по три литеры в каждой (причем в последней группе может быть меньше чем три литеры). Например, (2) необходимо преобразовать в такую форму:

ABB BEE EEE E44 444 66F GZY W22 220 0PQ 999 999 999 R. (3)

Обратите внимание, что 3426F не означает 3427 повторений буквы F; в результате появляется 4 четверки, 3 шестерки и затем буква F. Наша программа должна отперфорировать результат на картах, по шестнадцать групп на каждой карте.

Для выполнения такого перевода мы напишем две сопрограммы и подпрограмму. Подпрограмма, названная NEXTCHAR, находит следующую литеру, не являющуюся пробелом, во входной последовательчосги и помещает ее в регистр A:

01 * ПОДПРОГРАММА ВВОДА ЛИТЕРЫ

02 READER EQU 16 Номер читающего устройства.

03 INPUT ORIG *+16 Место для входных карт.

04 NEXTCHAR STJ 9F Вход в подпрограмму.

05 - JXNZ 3F Первоначально rX = 0.

06 1H J6N 2F Первоначально rI6 = 0.

07 - IN INPUT(READER) Прочитать следующую карту.

08 - JBUS *(READER) Ждать завершения.

09 - ENN6 16 rI6 указывает на первое слово.

10 2H LDX INPUT+16,6 Взять следующее слово.

11 - INC6 1 Продвинуть стрелку.

12 3H ENTA 0

13 - SLAX 1 Следующая литера ->rA.

14 9H JANZ Пропуск пробелов.

15 - JMP NEXTCHAR+1 []

Эта подпрограмма имеет следующие характеристики:

- Вызов: JMP NEXTCHAR

- Состояние при входе: rI6 указывает на следующее слово, или rI6 = 0, если необходимо прочесть следующую карту; rX = литеры, которые еще будут обрабатываться.

- Состояние при выходе: rA = следующая входная литера (не пробел); rX, rI6 подготовлены для следующего входа в NEXTCHAR.

Наша первая сопрограмма, с названием IN, получает символы из входной последовательности и создает соответствующее количество дубликатов:

16 * ПЕРВАЯ СОПРОГРАММА

17 2H INCA 30 Литера - не цифра.

18 - JMP OUT Передать ее в сопрограмму.

19 IN1 JMP NEXTCHAR Взять литеру.

20 - DECA 30

21 - JAN 2B Буква?

22 - CMPA =10=

23 - JGE 2B Специальная литера?

24 - STA *+1(0:2) Цифра n.

25 - ENT5 * rI5<-n.

26 - JMP NEXTCHAR Взять следующую литеру.

27 - JMP OUT Передать ее в сопрограмму.

28 - DEC5 1 Уменьшить n на 1.

29 - J5NN *-2 Повторить, если это необходимо.

30 - JMP IN1 Начать новый цикл. []

(Напомним, что для MIX цифры 0-9 имеют коды 30-39). Эта сопрограмма имеет следующие характеристики:

- Вызов: JMP IN

- Состояние при выходе (при переходе к OUT): rA = очередная входная литера с учетом размножения; rI4 не изменяет свое значение с момента входа.

- Состояние при входе (после возврата): rA, rX, rI5, rI6 не должны изменять своих значений с момента последнего выхода.

Другая сопрограмма, с названием OUT, размещает код по три литеры и перфорирует карты:

31 * ВТОРАЯ СОПРОГРАММА

32 _ ALF _ Константа для занесения пробелов.

33 OUTPUT ORIG *+16 Буферная область для ответов.

34 PUNCH EQU 17 Номер устройства (перфоратора).

35 OUT1 ENT4 -16 Начать новую карту.

36 - ENT1 OUTPUT

37 - MOVE -1,1(16) Занести пробелы в область вывода.

38 1H JMP IN Взять следующую литеру.

39 - STA OUTPUT+16,4(1:1) Занести в выходную карту.

40 - СМРА PERIOD Это "."?

41 - JE 9F

42 - JMP IN Если нет, то взять следующую литеру.

43 - STA OUTPUT+16,4(2:2) Занести ее.

44 - СМРА PERIOD Это "."?

45 - JE 9F

46 - JMP IN Если нет, то взять следующую литеру.

47 - STA OUTPUT+16,4(3:3) Занести ее.

48 - СМРА PERIOD Это "."?

49 - JE 9F

50 - INC4 1 Перейти к следующему слову.

51 - J4N 1B Конец карты?

52 9H OUT OUTPUT(PUNCH) Если да, то перфорация.

53 - JBUS *(PUNCH) Ждать завершения.

54 - JNE OUT1 Возвратиться и продолжить, если не была принята ".".

55 - HLT

56 PERIOD ALF . []

Эта сопрограмма имеет следующие характеристики:

- Вызов: JMP OUT

- Состояние при выходе (при переходе к IN): rA, rX, rI5, rI6 сохраняют те значения, которые были при входе.

- Состояние при входе (при возврате): rA = (следующая входная литера с учетом размножения); значение r4 сохранилось с момента последнего выхода.

Чтобы завершить программу, мы должны обеспечить связь между сопрограммами [см. (1)] и соответствующие начальные установки. Начальные установки в сопрограммах требуют некоторой изобретательности, хотя и не создают заметных затруднений.

57 * НАЧАЛЬНАЯ УСТАНОВКА И СВЯЗЬ

58 START ENT6 0 Подготовить rI6 для NEXTCHAR.

59 - ENTX 0 Подготовить rX для NEXTCHAR.

60 - JMP OUT1 Начать с OUT.

61 OUT STJ INX Связь сопрограмм.

62 OUTX JMP OUT1

63 IN STJ OUTX

64 INX JMP INI

65 - END START []

Теперь программа написана полностью. Читателю следует тщательно изучить ее, обращая особое внимание на то, как можно написать каждую из сопрограмм независимо, в предположении, что другая сопрограмма является ее подпрограммой.

В программе, приведенной выше, состояния входа и выхода для IN и OUT полностью согласованы. Общий случай может оказаться менее удачным, и тогда для связи сопрограмм потребуется также загрузка и запоминание соответствующих регистров. Например, если сопрограмма OUT изменяет содержимое регистра А, то группа команд для связи сопрограмм примет следующий вид:

OUT STJ INX

- STA HOLD A Запомнить А при выходе из IN.

OUTX JMP OUT1

IN STJ OUTX

- LDA HOLDA Восстановить А при выходе из OUT.

INX JMP IN1

Существует важное родство между сопрограммами и МНОГОПРОХОДНЫМИ АЛГОРИТМАМИ. Например, процесс перевода, который мы только что описали, можно было бы выполнить за два отдельных прохода. Во-первых, мы могли бы сделать в точности то, что делает сопрограмма IN, применяя ее ко всей входной информации и записывая каждую литеру с соответствующим числом дубликатов на магнитную ленту. После того как эта обработка закончится, мы могли бы перемотать ленту в начало и затем сделать в точности то, что делает сопрограмма OUT, принимая литеры с ленты группами по три. Это называют "двухпроходной" обработкой. (Интуитивно под словом "проход" мы подразумеваем полный просмотр входной информации. Это не строгое определение; во многих алгоритмах совсем не ясно количество выполненных проходов. Однако интуитивная концепция "прохода" полезна, несмотря на ее расплывчатость).

Рис.22. Проходы: (а) четырехпроходный алгоритм, (b) однопроходный алгоритм.

На рис.22(а) показана четырехпроходная обработка. Очень часто мы обнаруживаем, что тот же самый процесс может быть выполнен всего в один проход, как показано на рис.22(b), если мы заменим четырьмя сопрограммами A, B, C, D соответствующие проходы A, B, C, D. Сопрограмма A будет переходить к B, тогда как проход записывал бы элемент выходной информации на ленту 1; сопрограмма B будет переходить к A, тогда как проход читал бы элемент входной информации с ленты 1, и B будет переходить к C, тогда как проход B писал бы элемент выходной информации на ленту 2; и т.д.

И наоборот, процесс, реализованный с помощью n сопрограмм, часто можно трансформировать в n-проходный процесс. Поскольку существует такое соответствие, полезно сравнить многопроходные алгоритмы с однопроходными алгоритмами.

a) ПСИХОЛОГИЧЕСКОЕ РАЗЛИЧИЕ. Для решения одной и той же проблемы многопроходный алгоритм, как правило, легче создать и понять, чем однопроходный алгоритм. Процесс, разбитый на ряд небольших этапов, которые выполняются один за другим, легче понять, чем сложный процесс, в котором все происходит одновременно.

Кроме того, если речь идет о большой задаче и если разработкой программы для машины занимается большая группа людей, то многопроходный алгоритм естественным образом обеспечивает разделение работы.

Эти преимущества многопроходного алгоритма присущи также и сопрограммам, поскольку каждую из сопрограмм можно написать независимо от другой, а связь сводит явно многопроходный алгоритм к однопроходному процессу.

b) РАЗЛИЧИЕ ВО ВРЕМЕНИ. Время, необходимое на упаковку, запись, чтение и распаковку промежуточных данных между проходами (например, информации на лентах, см. рис.22), отсутствует в однопроходном алгоритме. Поэтому однопроходные алгоритмы быстрее.

c) РАЗЛИЧИЕ В ОБЪЕМЕ ПАМЯТИ. Однопроходный алгоритм требует места в оперативной памяти одновременно для всех программ, тогда как многопроходный алгоритм требует в каждый момент места только под одну программу. Это может повлиять на скорость даже в большей степени, чем то, о чем говорилось в пункте (b). Например, многие машины имеют ограниченный размер "быстрой памяти" и значительно большую медленную память; если каждый проход может уместиться в быстрой памяти, то результат будет получен значительно быстрее, чем в том случае, если мы используем сопрограммы в одном проходе (поскольку использование сопрограмм, по-видимому, приведет к тому, что большая часть программы окажется в медленной памяти).

Иногда существует необходимость разработать алгоритмы сразу для нескольких конфигураций машины, причем некоторые из них имеют объем памяти больший, чем другие. В этом случае можно было бы написать программу в виде сопрограмм и позволить памяти определять количество проходов: загружать вместе столько сопрограмм, сколько возможно, и компенсировать отсутствующие связи подпрограммами ввода или вывода.

Хотя это родство между сопрограммами и проходами важно, мы должны иметь в виду, что не во всех случаях, когда применяются сопрограммы, возможно расщепление на многопроходные алгоритмы. Например, если сопрограмма B получает входную информацию из A и передает в A информацию, определяющую дальнейшие действия, то преобразование A в проход, за которым следует проход B, становится невозможным.

И конечно, не все многопроходные алгоритмы можно преобразовать в сопрограммы. Некоторым алгоритмам внутренне присуща многопроходность; например, второй проход может требовать кумулятивную информацию от первого прохода (например, суммарное количество появлений некоторого слова во входной информации). Есть старая шутка, которую стоит напомнить в связи с этим.

Старушка, едущая в автобусе: "Мальчик, не скажешь ли, где мне выйти, чтобы попасть на улицу Пасадена?"

Мальчик: "Следите за мной и выходите за две остановки до меня".

(Шутка и состоит в том, что мальчик предлагает двухпроходный алгоритм).

Итак, о многопроходных алгоритмах сказано достаточно. Далее, во многих местах по всей этой книге мы встретимся с примерами сопрограмм, в частности, как с частью схемы буферизации. Сопрограммы играют также важную роль в моделировании дискретных систем...

***

Т.е. оправдать применение сопрограмм может только их сложность. А наша программа изначально проста. Как быть?

Последний раз редактировалось: Gudleifr (Вт Апр 26, 2022 12:22 am), всего редактировалось 1 раз(а)

Gudleifr- Admin

- Сообщения : 3246

Дата регистрации : 2017-03-29

Re: О компиляции Машин Тьюринга

Re: О компиляции Машин Тьюринга

Стартстопный телеграфный аппарат. Такой стоял вместо терминала на одной из ЭВМ, с которой я работал. Двухленточный агрегат: умел и работать с перфолентой, и выдавать родную телеграфную ленту: "ВРАНГЕЛЬ ОПРАКИНУТ МОРЕ ТЧК ПЛЕНЫХ НЕТ ТЧК".

Из Сборника АВТОМАТЫ (1956).

УНИВЕРСАЛЬНАЯ МАШИНА ТЬЮРИНГА С ДВУМЯ ВНУТРЕННИМИ СОСТОЯНИЯМИ

КЛОД Э.ШЕННОН

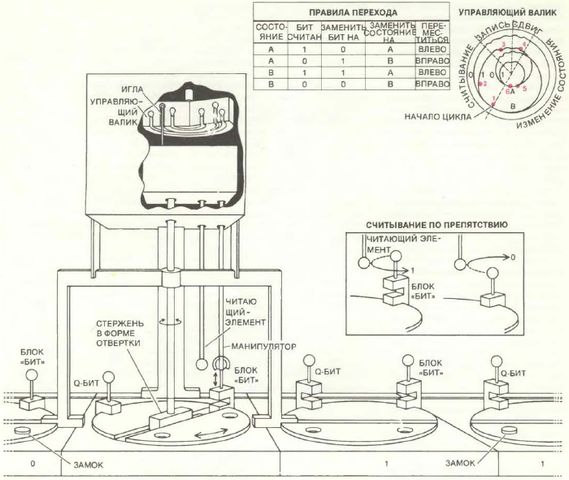

ВВЕДЕНИЕ

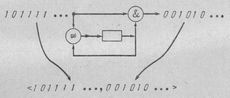

В известной статье [Turing A.М., On Computable Numbers, with an Application to the Entscheidungsproblem, Proc. London Math. Soc., (2) 42, 230-265 (1936)] А.М.Тьюринг определил класс вычислительных машин, называемых ныне машинами Тьюринга. Можно представлять себе, что машина Тьюринга состоит из трех частей: управляющего элемента, считывающей и записывающей головки и бесконечной ленты. Лента разделена на последовательность квадратов, каждый из которых может хранить любой символ из конечного алфавита. Считывающая головка в каждый данный момент воспринимает один квадрат ленты. Она может прочесть записанный там символ и под действием управляющего элемента записать новый символ, а также передвинуться на один квадрат вправо или влево. Управляющий элемент представляет собой устройство с конечным числом внутренних "состояний". В каждый данный момент ближайшая операция машины определяется текущим состоянием управляющего элемента и символом, воспринимаемым считывающей головкой. Эта операция состоит из трех частей: 1) записи нового символа в воспринимаемом квадрате (новый символ, конечно, может совпадать с только что прочитанным); 2) перехода управляющего элемента в новое состояние (которое может совпадать с предыдущим состоянием); 3) движения считывающей головки на один квадрат вправо или влево [Иногда предполагают, что считывающая головка может также оставаться на месте.- Прим. ред.].

При подготовке машины к работе на некоторый конечный кусок ленты наносится начальная последовательность символов, а остальная часть ленты оставляется пустой (т.е. заполненной некоторым "пустым" символом). Считывающая головка помещается в некотором начальном квадрате, и машина приступает к вычислениям согласно правилам своей работы. В первоначальной формулировке Тьюринга квадраты через один предназначались для записи окончательного ответа и для промежуточных вычислений. Эта и другие подробности первоначального определения были изменены в позднейших изложениях теории.

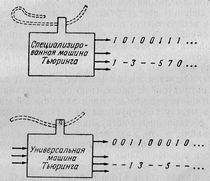

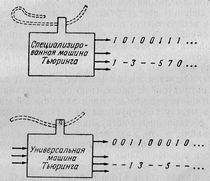

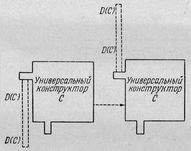

Тьюринг показал, что возможно построить универсальную машину, способную работать, как любая частная машина Тьюринга, если ее снабдить описанием этой частной машины. Описание наносится на ленту универсальной машины по определенному коду, подобно начальной последовательности частной машины. Тогда универсальная машина воспроизводит работу частной.

Наша главная цель - показать, что можно построить универсальную машину Тьюринга, использующую одну ленту и имеющую лишь два внутренних состояния. Будет показано также, что с одним внутренним состоянием этого сделать нельзя. В заключение этой статьи дается построение универсальной машины Тьюринга с двумя только символами на ленте.

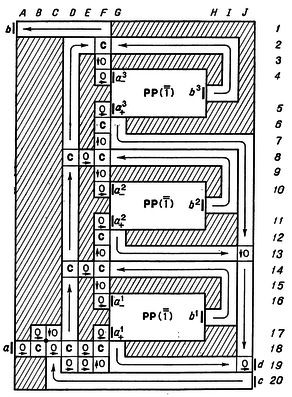

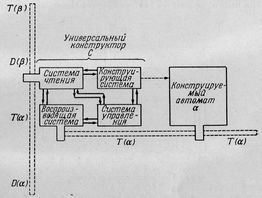

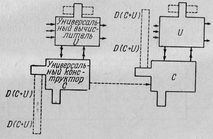

УНИВЕРСАЛЬНАЯ МАШИНА ТЬЮРИНГА С ДВУМЯ СОСТОЯНИЯМИ

В общих чертах метод построения таков. Для произвольной машины Тьюринга A с алфавитом из m букв (символов, записываемых на ленте, включая пустой квадрат) и с n внутренними состояниями мы построим машину B с двумя внутренними состояниями и алфавитом не более чем из 4mn+m символов. Машина B будет работать, по существу, так же, как и машина A. Во всех квадратах, кроме воспринимаемого считывающей головкой и одного смежного с ним, на ленте машины B записано то же, что и на ленте машины A в соответствующие моменты работы двух машин. Если в качестве A выбрать универсальную машину Тьюринга, то и B будет универсальной машиной Тьюринга.

Машина B моделирует поведение машины A, но хранит информацию о внутреннем состоянии машины A с помощью символов, записанных в квадрате под считывающей головкой и в квадрате, который считывающая головка машины A собирается посетить. Основная задача - своевременно освежать эту информацию и держать ее под считывающей головкой. Если последняя передвигается, то информацию о состоянии надо перенести в новый квадрат, используя всего два внутренних состояния машины B. Пусть, например, следующим состоянием машины A должно быть состояние 17 (согласно какой-нибудь системе счисления). Чтобы перенести его символ, считывающая головка "качается" вперед-назад между старым и новым квадратом 17 раз (точнее 18 раз в новый квадрат и 17 назад в старый). В течение этого процесса символ, стоящий в новом квадрате, пробегает своего рода последовательность счета, которая оканчивается символом, соответствующим состоянию 17 и в то же время сохраняющим информацию о предыдущем символе в этом квадрате. Процесс качания возвращает также старый квадрат к одному из элементарных символов (находящихся во взаимно однозначном соответствии с символами, используемыми машиной A), а именно к тому элементарному символу, который должен быть записан в этом квадрате после окончания этой операции.

Формально машина B строится так. Пусть символы алфавита машины A суть A1, A2, ..., Am, и пусть ее состояния суть S1, S2, ..., Sn. В машине B мы поставим в соответствие алфавиту машины A m элементарных символов B1, B2, ..., Вm. Затем мы определим 4mn новых символов, соответствующих парам из состояния и символа машины A, снабженным двумя новыми двузначными индексами. Эти символы обозначим через B[i,j,x,y] где i = 1, 2, ..., m (соответственно символам), j = 1, 2, ..., n (соответственно состояниям), x = + или - (в зависимости от того, передает или получает информацию квадрат ленты во время качания) и y = R или L (в зависимости от того, вправо или влево от воспринимаемого квадрата должна передвинуться считывающая головка при качании).

Два состояния машины B назовем альфа и бета. Эти состояния используются двояко. Во-первых, при первом шаге качания они переносят в ближайший подлежащий посещению квадрат информацию о том, вправо (альфа) или влево (бета) от нового квадрата лежит старый квадрат. Эта информация нужна в новом квадрате, чтобы управляющий элемент передвинул считывающую головку назад в нужном направлении. После первого шага информация об этом сохраняется в новом квадрате с помощью записанного там символа (последний индекс y). Во-вторых, состояния альфа и бета используются, чтобы сообщить из старого квадрата в новый о конце качания. После первого шага качания состояние бета переносится в новый квадрат вплоть до конца качания, когда переносится альфа. Это означает конец операции, и новый квадрат начинает затем действовать как передатчик и управляет следующим шагом вычисления.

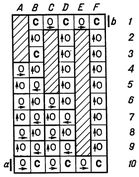

Описывая машину B, указывают, что она выполняет при чтении произвольного символа в произвольном состоянии. Выполняет же она три акта: записывает новый символ, переходит в новое состояние и передвигает считывающую головку вправо или влево. Таблица работы машины B такова:

символ; состояние -> символ; состояние; направление

Bi; альфа -> B[i,1,-,R]; альфа; R (i = 1, 2, ..., m) (1)

Bi; бета -> B[i,1,-,L]; альфа; L (i = 1, 2, ..., m) (2)

B[i,j,-,x]; бета -> B[i,(j+1),-,x]; альфа; x (i = 1, 2, ..., m) (j = 1, 2, ..., n-1) (x = R, L) (3)

B[i,j,+,x]; альфа или бета -> B[i,(j-1),+,x]; бета; x (i = 1, 2, ..., m) (j = 1, 2, ..., n) (x = R, L) (4)

B[i,1,+,x]; альфа или бета -> Bi; алфа; x (i = 1, 2, ..., m) (x = R, L) (5)

Эти операции пока что никак не зависят от таблицы работы машины A (кроме числа используемых символов). Операции же следующего и последнего типа формулируются в терминах таблицы работы моделируемой машины. Предположим, что машина A имеет формулу операций

Ai; Sj -> Ak; Sl; R/L. (6)

Тогда, по определению, машина B имеет формулу

B[i,j,-,x]; альфа -> B[k,l,+,R/L]; бета/альфа; R/L, (7)

причем, если в формуле (6) употреблена верхняя буква (R), то верхние буквы употребляются также и в формуле (7) и обратно.

Чтобы увидеть, как работает эта система, мы проследим цикл, состоящий из одной операции машины A и соответствующей серии операций машины B.

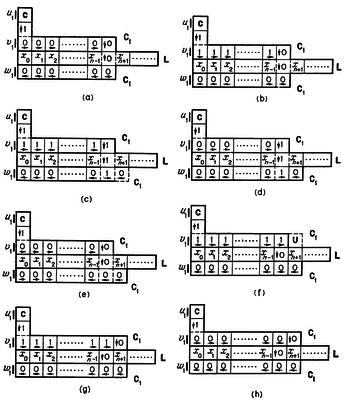

Пусть машина A читает символ A3 и находится в состоянии S7, и пусть ее таблицей работы предусмотрена запись символа A8, переход в состояние S4 и движение вправо. Машина B читает (по индуктивному предположению) символ B[3,7,-,x] (значение х (R или L) зависит от предыдущих операций и безразлично для дальнейшего). Машина B будет находиться в состоянии альфа. Ввиду формулы (7) машина B запишет В[8,4,+,r], перейдет в состояние бета и передвинется вправо. Предположим, что квадрат справа в машине A содержит А13; соответствующий квадрат в машине B содержит В13. Приходя в этот квадрат в состоянии бета, машина B в силу формулы (2) записывает B[13,1,-,L], переходит в состояние альфа и движется назад, влево. Это служит началом переноса информации о состоянии с помощью процесса качания. Приходя в квадрат слева, машина B читает B[8,4,+,R] и в силу формулы (4) записывает B[8,3,+,R], переходит в состояние бета и передвигается опять вправо. Затем в силу формулы (3) она записывает B[13,2,-,L], переходит в состояние альфа и возвращается налево. Весь ход процесса приведен, в табл.1.

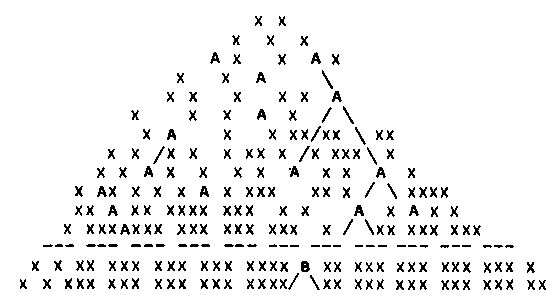

Таблица 1.

Указанные операции завершают перенос информации о состоянии в квадрат справа и выполнение команды, отданной квадратом слева. В квадрате слева записан теперь символ B8 (соответствующий символу A8 в машине A), а в квадрате справа - символ B[13,4,-,L]; считывающая головка находится на этом квадрате, имея внутреннее состояние альфа. Это возвращает нас к ситуации, аналогичной той, которая имела место в начале рассмотренного цикла. Рассуждая по индукции, мы видим, что машина B моделирует поведение машины A.

Чтобы заставить машину B работать аналогично машине А, мы заполняем начальную ленту машины B соответственно начальной ленте машины A (с заменой Ai на Bi, за исключением квадрата, занимаемого считывающей головкой в начальный момент. Если Sj - начальное состояние машины A и Ai - начальный символ в этом квадрате, то в соответствующем квадрате ленты машины B записываем B[i,j,-,R (или L)] и приводим B в состояние альфа.

НЕВОЗМОЖНОСТЬ УНИВЕРСАЛЬНОЙ МАШИНЫ ТЬЮРИНГА С ОДНИМ СОСТОЯНИЕМ

Теперь мы покажем, что нельзя построить универсальную машину Тьюринга, использующую одну ленту и одно только внутреннее состояние.

Допустим, что такая машина существует. Если записать подходящее "описательное число" конечной длины на куске ленты (оставив прочую часть ленты пустой) и поместить считывающую головку в подходящий квадрат, то машина будет вычислять любое вычислимое число и, в частности, вычислимые иррациональные числа, например sqr(2) (квадратный корень из двух). Мы покажем, что это невозможно.

Согласно первоначальному замыслу Тьюринга, при вычислении sqr(2) последовательные знаки sqr(2) (скажем, в двоичном представлении) записываются машиной на определенной последовательности квадратов ленты (например, на четных квадратах, тогда как нечетные предназначаются для промежуточных вычислений). Приводимое ниже доказательство исходит из вычисления sqr(2) в таком виде, хотя будет ясно, что, изменив доказательство, можно принять во внимание и другие разумные интерпретации "вычисления sqr(2)".

Ввиду иррациональности sqr(2) его двоичные знаки не станут периодическими ни с какого места. Поэтому если мы покажем, для машины с одним состоянием, что или (1) во всех ее квадратах, кроме конечного числа, будет в конце концов записан один и тот же символ, или (2) во всех квадратах, кроме конечного числа, символы будут без конца сменяться, то тем самым будет получен желаемый результат.

Сначала возьмем ленту, пустую и бесконечную в обе стороны от описательного числа для sqr(2). Если считывающая головка приходит на пустой квадрат, то она должна или остановиться здесь на все время, или же передвинуться вправо либо влево. Так как имеется лишь одно состояние, то ее поведение не зависит от предшествовавшего вычисления. В первом случае считывающая головка никогда не отойдет дальше чем на один квадрат от описательного числа и вся лента, кроме конечного отрезка, будет постоянно пуста. Если же головка передвигается влево с некоторого пустого квадрата, то или левая бесконечная часть пустой ленты не участвует в вычислении и поэтому не требует рассмотрения, или, если она участвует в вычислении, считывающая головка с этого времени беспрерывно движется влево, записывая во всех квадратах, ранее пустых, один и тот же символ. Следовательно, лента становится одинаковой всюду слева от некоторого конечного отрезка и пустой справа от него и не может давать записи числа sqr(2). Аналогичное положение возникает при движении головки вправо от первоначально пустого квадрата. Поэтому двусторонне бесконечная лента ничуть не лучше односторонней, и мы можем из соображений симметрии предположить, что лента односторонне бесконечна вправо от описательного числа.

Теперь рассмотрим следующую операцию. Поместим считывающую головку в первом квадрате бесконечной пустой полосы [Справа от описательного числа.- Прим. ред.]. Машина будет вычислять некоторое время, и, быть может, считывающая головка переместится назад из этой полосы по направлению к описательному числу. Тогда возвратим ее снова в первый квадрат первоначально пустой полосы. Если головка опять переместится к описательному числу, то опять поместим ее в этом первом квадрате и т.д. Число раз, которое головку можно поместить таким образом над этим первым квадратом, будет называться числом отражений машины и обозначаться через R. Оно равно или целому числу 1, 2, 3, ..., или бесконечность.

Теперь поместим считывающую головку в квадрат описательного числа, являющийся начальным для предполагаемого вычисления sqr(2). Спустя некоторое время считывающая головка, возможно, выйдет из части ленты, где записано описательное число. Возвратим ее в последний квадрат описательного числа. Спустя некоторое время она, возможно, опять выйдет. Продолжим этот процесс до тех пор, пока это возможно. Число выходов головки равно или целому числу 0, 1, 2, 3, ..., или бесконечность. Это число S мы назовем числом отражений для данного описания sqr(2).

Если S конечно и R (может быть бесконечность) >= S, то спустя конечное время считывающая головка застрянет в части ленты, где первоначально находилось описательное число. Изменится лишь конечная часть пустой ленты, и машина не вычислит sqr(2).

Если как R, так и S бесконечны, то считывающая головка будет возвращаться неограниченное число раз в часть ленты с описательным числом. Экскурсии в первоначально пустую часть или ограничены по длине, или нет. Если они ограничены, то изменится лишь конечная часть пустой ленты, как и в предыдущем случае. Если же нет, то вся лента, кроме конечной части, будет обрабатываться считывающей головкой неограниченное число раз. Так как имеется только одно состояние и алфавит символов конечен, то символ, записываемый в квадрате, который посещается неограниченное число раз, должен или стать постоянным (одним и тем же для всех таких квадратов), или изменяться циклически бесконечное число раз. В первом случае вся первоначально пустая лента становится одинаковой и не может изображать sqr(2). Во втором случае она непрерывно изменяется и не может изображать никакого результата вычисления.

[Рассуждения автора здесь не вполне ясны, и, кроме того, он использует условие конечности алфавита символов не по существу. Можно дать другое доказательство, без предположения, что число символов конечно.

Пусть вся лента, кроме конечной ее части, обрабатывается головкой неограниченное число раз. A priori возможны два случая: либо во всяком квадрате, кроме конечного их числа, символы сменяются неограниченное число раз (и тогда, очевидно, запись на ленте не может представлять результат вычисления sqr(2)), либо это не так. Во втором случае сколь угодно далеко найдется квадрат q, обладающий тем свойством, что, начиная с некоторого момента, символ в q не изменяется (обозначим этот символ через C); тогда q можно выбрать так, чтобы слева от q имелся некоторый квадрат q*, в который головка возвращается неограниченное число раз.

Пусть головке предписано сдвинуться вправо по прочтении символа C. Тогда головка, попав на квадрат q, после того как в нем постоянно записывается символ C, не сможет, начиная с этого момента, попасть в q*. Аналогично, если по прочтении символа C головка должна сдвинуться влево, то она не сможет, начиная с некоторого момента, посетить квадраты, лежащие правее q.

Это говорит о том, что второй из двух a priori возможных случаев не может иметь места. Итак, возможен лишь первый случай, при котором машина не вычислит sqr(2).

Так как в остальных частях доказательства Шеннон нигде не опирается на условие конечности алфавита символов, то можно считать его теорему справедливой также для "машин", работающих с бесконечным числом символов (и одним состоянием).- Прим. ред.]

Если R < S, то считывающая головка в конце концов уйдет в первоначально пустую часть ленты и там останется. Можно показать, что в этом случае символы в первоначально пустой части становятся, за исключением конечного их числа, одинаковыми. В самом деле, либо головка передвигается вправо из первого пустого квадрата во второй пустой квадрат по меньшей мере R+1 раз, либо нет. В последнем случае спустя конечное время считывающая головка застревает в бывшем первом пустом квадрате, и вся лента, кроме конечной части, остается пустой. Если же головка уходит вправо R+1 раз, то она не вернется в первый квадрат, первоначально пустой, ибо R есть число отражений для пустой ленты. В этом первом квадрате будет записан результат 2R+1 действий над пустым квадратом (при R+1 приходах головки слева и R приходах справа). Во втором первоначально пустом квадрате в конце концов будет записан тот же самый постоянный символ, потому что ко второму квадрату применимо такое же рассуждение, как и к первому. Во всех случаях машина работает на той же самой ленте (бесконечном ряде пустых квадратов) и приходит одно и то же число раз справа (R) и, соответственно, слева (R+1). Тем самым все возможные случаи исчерпаны и доказательство завершено.

МОДЕЛИРОВАНИЕ МАШИНЫ ТЬЮРИНГА С ПОМОЩЬЮ ТОЛЬКО ДВУХ СИМВОЛОВ НА ЛЕНТЕ